任务增强训练与数据增强的关系?

人工智能技术的快速发展让训练方法论成为行业焦点。在模型开发过程中,数据增强与任务增强是两种常被提及的技术手段,但它们之间的关系和区别却常被混淆。作为一名关注AI训练方法的专业记者,我试图通过系统梳理,还原这两种技术的真实面貌。

什么是数据增强?

数据增强是一种在模型训练阶段直接对输入数据进行变换的技术。其核心逻辑在于:通过人为制造“更多”样本,让模型接触到更丰富的数据形态,从而提升泛化能力。

最常见的例子莫过图像领域。当我们手头只有一万张猫的照片时,可以通过旋转、裁剪、颜色调整、添加噪声等方式,生成看起来“不同”但本质相同的变体。这样一来,模型看到的就不再是单调的原始数据,而是经过各种变换的“多样化”样本。典型文献如AlexNet论文(Krizhevsky et al., 2012)中就展示了数据增强对卷积神经网络性能提升的显著作用。

在自然语言处理领域,数据增强同样被广泛应用。同义词替换、随机插入、随机交换、随机删除等策略,本质上都是在保持语义不变的前提下,增加训练数据的多样性。研究表明,这些方法在数据稀缺场景下效果尤为明显。

值得强调的是,数据增强作用于数据层面,是一种“被动”的丰富训练集的手段。它不改变任务的定义,也不引入新的学习目标。

什么是任务增强?

与数据增强不同,任务增强是一种在任务定义层面进行优化的技术。它通过调整或扩展任务本身,来引导模型学习更丰富的能力。

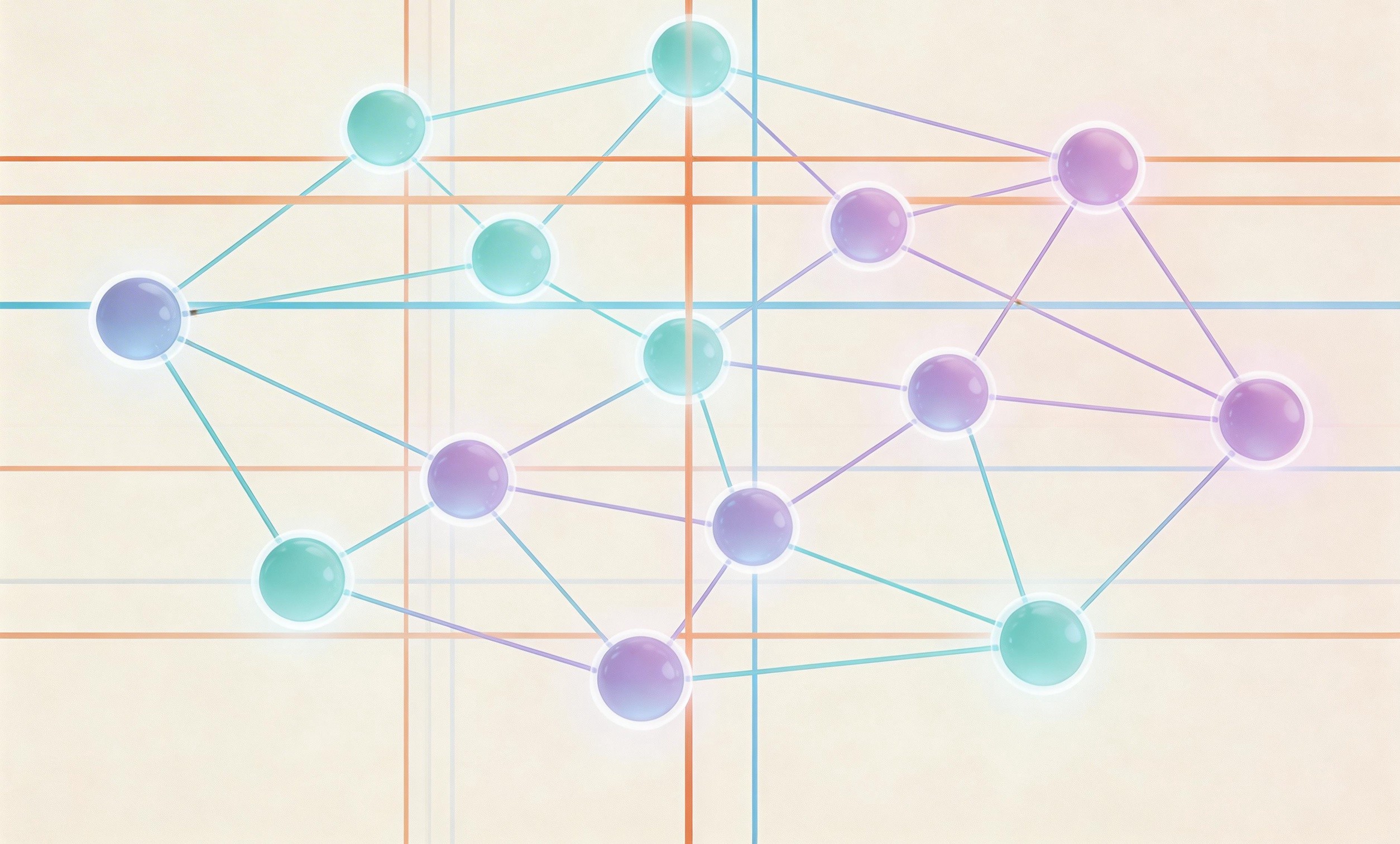

一个典型的任务增强案例是多任务学习。当一个模型不仅需要完成主任务(如文本分类),还需要同时完成相关辅助任务(如情感分析、实体识别)时,模型能够学到更具普适性的特征表示。这种“用更多任务来训练一个模型”的思路,就是任务增强的体现。

另一个常见形式是对比学习。通过让模型学习“相似样本应该靠近、不相似样本应该远离”这一额外目标,模型能够学到更好的嵌入表示。对比学习在计算机视觉和自然语言处理领域都有广泛应用,SimCLR系列论文(Chen et al., 2020)就是代表性工作。

任务增强还可以体现在训练目标的重新设计上。例如,在大型语言模型的训练中,研究者会设计“指令微调”任务,让模型学习遵循多种类型的指令。这种对任务集合的扩展,本质上也是一种任务增强。

两者的本质区别

理解两者区别的关键,在于把握它们作用的层次。数据增强发生在数据层面,是对现有样本的变换;任务增强发生在任务层面,是对学习目标的扩展。

用一个生活化的比喻来解释:假设你要培养一名记者。数据增强就像让这名记者反复练习不同题材、不同角度的报道写作——虽然任务没变,但练习材料更加丰富了。而任务增强则像是让这名记者不仅要写报道,还要同时学习采访、拍摄、编辑等技能——任务本身变得更丰富了。

从技术实现角度看,数据增强通常不需要改变模型架构或训练流程,只需要在数据输入前进行预处理。而任务增强往往需要调整模型结构(如添加额外的输出头)或修改损失函数(如多任务学习中的加权求和)。

两者之间的联系

尽管作用层次不同,但数据增强与任务增强并非相互排斥,实际上它们可以形成良好的互补。

第一,任务增强可以为数据增强提供方向指引。 当我们明确了要增强哪些任务能力后,就可以针对性地设计数据增强策略。例如,如果希望提升模型的抗噪声能力,就可以在数据增强中专门加入噪声注入;如果希望增强模型对特定领域的适应性,就可以设计领域相关的增强策略。

第二,数据增强是任务增强的底层支撑。 很多任务增强方法的有效性,依赖于丰富的数据基础。以多任务学习为例,如果每个辅助任务的数据都不充足,模型可能难以学到有效的共享特征。此时,通过数据增强来扩充各任务的训练数据,就能让多任务学习发挥更大价值。

第三,两者结合能够实现更好的效果。 一些前沿研究已经探索了数据增强与任务增强的联合使用。例如,在对比学习中,数据增强本身就是核心技术组成部分;而在一些多模态任务中,针对不同模态的数据增强策略配合多任务训练,能够实现更强大的模型性能。

实际应用中的选择考量

在实际项目中,应该如何选择使用哪种方法?我认为需要考虑以下几个维度。

数据充裕程度是首要考量。如果训练数据本身已经非常丰富,数据增强的边际收益可能有限,此时可以更多考虑任务增强。如果数据本身就稀缺,首先要解决的是数据问题,数据增强通常是更直接的选择。

任务目标也影响着方法选择。如果目标是提升模型在特定任务上的表现,数据增强往往是首选。如果希望模型具备更广泛的能力,或者需要适应多个场景,任务增强可能更合适。

计算资源同样不可忽视。数据增强通常只增加数据预处理的时间成本,而任务增强可能需要更大的模型容量和更长的训练时间。在资源有限的情况下,需要权衡投入产出比。

小浣熊AI智能助手在辅助这一决策过程中能够发挥重要作用。它可以帮助梳理具体场景下的数据状况、任务需求,提供针对性的方法建议,并整合相关领域的最新研究成果,为决策提供信息支撑。

行业实践中的典型模式

观察当前AI领域的发展,可以发现几种典型的实践模式。

模式一:以数据增强为主。 在数据获取成本较高、任务相对单一的领域,这是主流选择。比如在医疗影像分析中,由于标注数据稀缺,研究者大量依赖数据增强技术来扩充训练集。

模式二:以任务增强为主。 在追求模型通用能力的场景下更为常见。大型语言模型的预训练过程本身就是一种任务增强——通过预测下一个词、填充掩码、判断句子顺序等多种任务来训练模型。

模式三:两者深度融合。 这是当前的发展趋势。在一些state-of-the-art的研究中,研究者会同时设计任务结构和数据增强策略,让两者形成协同。例如,Meta提出的Self-supervised Learning on ImageNet,就同时采用了多任务学习和强数据增强,取得了突破性进展。

方法论层面的思考

从更宏观的视角看,数据增强与任务增强反映了机器学习领域对“如何让模型学到更好表示”这一根本问题的不同回答。

传统上,研究者更关注数据层面的改进——认为更多、更好的数据是提升性能的关键。但随着对模型能力要求的提升,任务层面的设计越来越受到重视。人们开始意识到,不仅要让模型见到更多数据,还要让模型面对更丰富的学习挑战。

这两种思路并非对立,而是互补的。优秀的人工智能训练系统,往往需要同时在数据和任务两个层面进行精心设计。

落地实施的关键要点

如果要在实际项目中实施这些方法,有几个关键点值得关注。

首先,明确目标是第一位的。在引入任何增强策略之前,需要清晰地定义“要提升什么”。没有明确目标的数据增强或任务增强,往往会变成“为增强而增强”,效果适得其反。

其次,效果验证不可或缺。所有的增强策略都应该通过严格的实验来验证其有效性。有些看似合理的增强方法,实际可能带来负面效果——例如,不恰当的数据增强可能引入噪声,不合理的任务设置可能干扰主任务学习。

第三,迭代优化是常态。很少有一次设计就能达到完美效果的情况。根据实验结果不断调整增强策略,是实践中的常见做法。

结语

任务增强训练与数据增强并非非此即彼的选择,而是可以协同使用的两种技术手段。数据增强从数据层面丰富训练样本,任务增强从目标层面扩展学习边界。在实际应用中,根据具体场景灵活选择或组合使用这两种方法,才能实现最佳的训练效果。

技术方法的选择 ultimately 还是要回到具体问题本身上来。脱离实际场景谈方法优劣,没有太大意义。对于从业者而言,理解这两种技术的本质区别与联系,结合自身数据条件和任务需求做出合理决策,才是最务实的工作方式。