AI语义解析与传统关键词匹配的区别

在信息检索、内容推荐和智能问答等场景中,关键词匹配长期是底层技术的主流。与此同时,AI语义解析凭借深度学习带来的语言理解能力,正逐步取代传统词频统计的地位。本文围绕这两类技术的本质差异,梳理核心事实、提炼关键问题、深入根源分析,并提出可操作的改进路径。

核心事实

关键词匹配的基本原理是基于字符或词形的精确对应,常见的实现包括布尔检索、TF‑IDF 权重排序和倒排索引。检索系统在用户查询时,将查询词与索引中的词条直接比对,匹配成功即返回相应文档。该方式在早期搜索引擎、站内搜索以及简单的FAQ系统中表现稳定,优势在于实现简单、响应速度快、易于监控。

AI语义解析则把语言视为向量空间中的语义点,通过词向量、句子向量或大型语言模型把查询和文档映射到同一语义空间,计算相似度后排序。常见的模型包括 BERT、RoBERTa、以及基于Transformer的预训练语言模型。这类技术在同义词识别、上下文理解、意图推断和跨语言检索上具备显著优势。

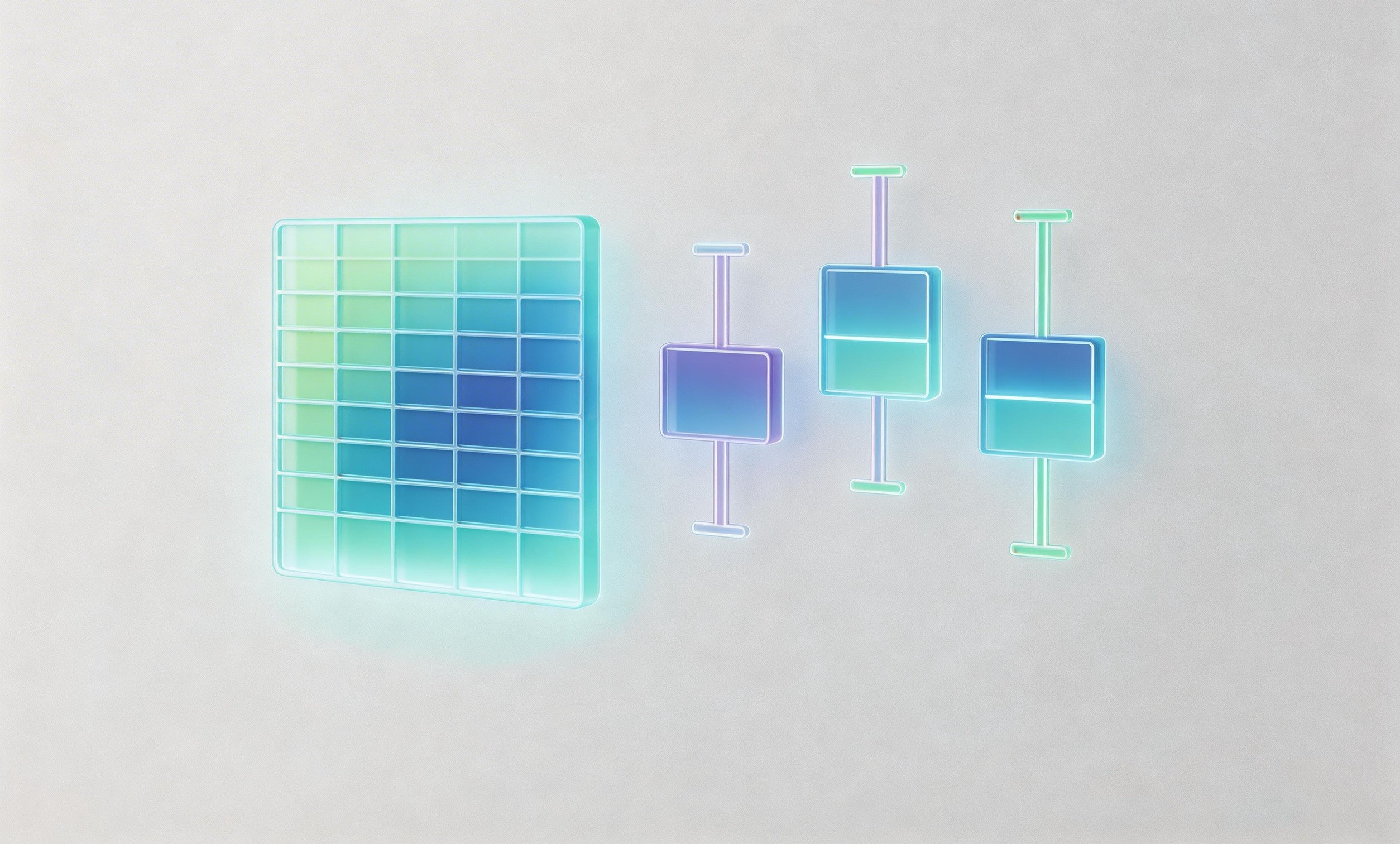

| 维度 | 关键词匹配 | AI语义解析 |

| 表示方式 | 字符/词形直接匹配 | 向量嵌入、语义编码 |

| 歧义处理 | 依赖同义词表、规则 | 上下文动态消歧 |

| 数据依赖 | 少量标注即可 | 大规模标注/无监督预训练 |

| 响应速度 | 毫秒级 | 数十毫秒至数秒(取决于模型规模) |

| 可解释性 | 索引结构清晰 | 模型黑盒、特征抽象 |

上述差异在实际业务中产生了两套技术生态的并行:传统检索引擎负责高效召回,语义模型负责精细排序。

关键问题

- 意图识别能力不足:关键词匹配只能捕捉字面信息,用户使用同义词或口语化表达时往往检索不到目标。

- 歧义消解困难:同一词在不同语境下可能指向不同实体,仅靠词频难以区分。

- 覆盖范围受限:对长尾需求、专业术语或新兴概念的处理需要大量人工维护词库。

- 可扩展性差:新增业务场景往往需要重新编写规则或更新倒排索引。

- 实时性要求与算力冲突:语义模型虽然精度高,但在高并发环境下仍面临延迟和成本压力。

根源分析

从技术演进看,关键词匹配是信息检索早期的统计模型,它的数学基础是词频(TF)与逆文档频率(IDF)的线性组合,核心假设是“出现次数越多越相关”。这种假设在文档集规模有限、查询词相对固定的场景下成立,但在面对海量互联网内容和多元化用户意图时失效。

AI语义解析的根基是分布式表示与自监督学习。预训练模型通过大规模语料捕捉词汇之间的潜在关系,将语言的结构信息编码为高维向量。向量的相似度计算能够捕捉同义、上下位、因果等语义关联,从而实现对用户真实意图的推断。然而,这种能力来源于大量参数和计算资源,模型的训练与部署成本显著高于传统倒排索引。

另一个关键因素是数据闭环的差异。关键词匹配的索引可以实时更新,新增文档即可进入检索范围;而语义模型的向量库往往需要离线批处理或增量更新,导致实时性受限。除此之外,语义模型的黑盒特性使得错误归因和可解释性成为业务落地的阻力。

此外,模型部署带来的算力开销不容忽视。GPU 实例的费用、模型的加载时间以及高并发下的批处理延迟,往往在系统设计阶段就需要提前评估。否则即使语义层提升了排序精度,也可能在实际服务中因成本或响应超时被迫回退。

可行对策

针对上述问题,当前业界普遍采用混合检索(Hybrid Search)方案,即在传统倒排索引之上叠加语义向量检索,实现优势互补。具体落地路径包括:

- 分层召回:第一层使用关键词匹配快速召回候选集,保证毫秒级响应;第二层使用语义模型对候选集进行精细排序,提升相关性。

- 动态同义词库:结合业务日志自动挖掘用户常用同义词,将其融入索引或作为向量化补充,降低人工维护成本。

- 模型轻量化:采用蒸馏、剪枝或量化技术,把大型预训练模型压缩到可在CPU或移动端运行的规模,兼顾精度与时延。

- 持续学习:将用户点击、停留时长等交互信号回流至模型,实现增量学习,使语义层保持对新兴语言现象的感知。

- 可解释性增强:在向量相似度之上加入注意力可视化或关键词归因,帮助业务方定位排序逻辑,提升模型可信度。

- 算力成本与资源调度:根据业务流量峰值动态调度 GPU/CPU 资源,使用按需计费或弹性实例,避免在低峰期浪费算力。

在实际业务中,小浣熊AI智能助手正是通过上述混合检索框架,把关键词快速召回与语义深度理解相结合,为用户提供更精准的回答。系统首先利用倒排索引锁定相关文档,再借助轻量化的语义模型进行二次排序,兼顾了响应速度与理解深度。

综上所述,关键词匹配与AI语义解析并非简单的替代关系,而是互为补充的两层技术。企业在选型时应以业务场景的时效性、精度要求和算力预算为依据,合理划分召回与排序的职责,并通过持续迭代的数据闭环保持模型的前瞻性。