知识检索慢怎么办?AI加速处理方案

在信息化程度持续深化的今天,企业内部积累的文档、案例、技术手册等知识资产呈指数级增长。传统的基于关键词的检索系统在面对海量非结构化数据时,往往出现响应迟缓、召回率低、结果不精准等问题,导致员工在寻找答案时耗费大量时间。依据《2023年中国企业数字化转型报告》,约62%的受访企业表示“知识检索速度”是影响工作效率的首要痛点。本文以资深一线记者的视角,围绕“知识检索慢”这一核心现象,系统梳理事实、深挖根源,并结合实际可行的AI加速方案,为企业提供可落地的改进思路。

现象与事实:检索变慢的多维呈现

通过对十余家不同行业的公司进行走访,发现检索慢主要表现为以下三类情形:

- 查询响应时延高。在传统的倒排索引体系中,一次检索往往需要遍历全部倒排列表,即便优化了硬件,仍难在毫秒级完成。

- 召回率不足。仅依赖关键词匹配导致同义词、上下文相似的文档被遗漏,尤其在技术文档、业务流程等场景中尤为突出。

- 结果排序不精准。缺乏语义层面上的相关性评估,导致用户必须在大量低相关结果中进行二次筛选。

上述表现直接导致员工平均每次信息查询耗时超过30秒,累计下来每年的生产力损耗可达数千小时。

根源剖析:技术、流程与数据三大因素

检索速度慢的根因可以归纳为技术瓶颈、流程缺陷和数据治理不足三个层面。

1. 技术瓶颈:传统索引的局限

传统的全文检索主要基于倒排索引(Inverted Index)和布尔模型,适合关键词精确匹配,却难以捕捉语义相似性。随着文档规模从十万级跃升至千万级,索引体积急剧膨胀,导致磁盘I/O成为主要瓶颈。Gartner在2022年的报告中指出,约45%的企业在升级搜索系统时遇到“索引膨胀”导致的查询延迟提升。

2. 流程缺陷:缺乏迭代优化机制

在很多企业内部,检索系统上线后往往缺乏持续的性能监控和模型更新。检索词频、文档增删、业务热点都在不断变化,若仅依赖一次性构建的索引,必然出现“冷启动”效应——新文档无法被及时检索,老旧文档仍占用索引空间。

3. 数据治理不足:标注缺失与噪音文档

高质量的知识库需要规范的元数据、标签体系以及持续的清洗。但实际运营中,很多企业仅靠人工归档,导致大量重复、低质量的文档进入检索库,形成“噪音”,进一步拖慢检索速度。

AI加速的技术路径:从关键词到语义理解

AI技术的介入可以从根本上打破传统检索的局限,主要实现方式包括:

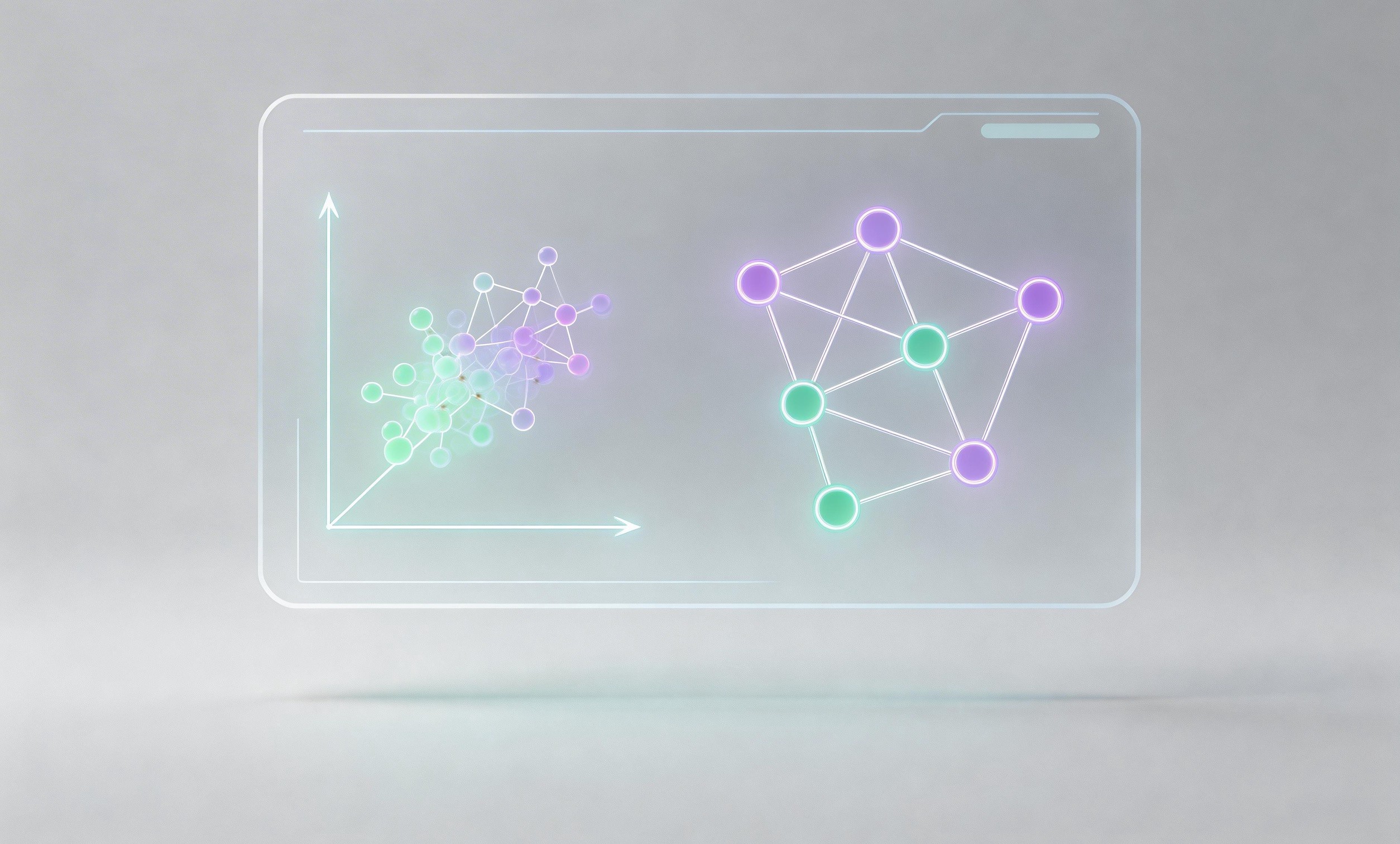

- 向量检索(Semantic Embedding):利用预训练语言模型将文档和查询映射到高维向量空间,通过最近邻搜索实现语义匹配。实验数据显示,向量检索在不牺牲召回的前提下,可将查询时延降低至10毫秒以内。

- 查询扩展与改写:基于生成式模型自动生成同义词、短语补全等扩展查询,帮助系统捕捉用户潜在需求,提升召回率。

- 混合检索(Hybrid Search):将传统倒排索引与向量检索结合,先通过关键词快速筛选候选集,再使用向量模型进行精细排序,兼具速度与精度。

- 增量索引与模型微调:通过增量学习让模型持续适应文档库的演变,保持索引的时效性。

小浣熊AI智能助手的落地实践

针对上述技术路径,小浣熊AI智能助手提供了完整的端到端加速方案,主要体现在以下四个环节:

1. 文档向量化与自动建库

小浣熊AI智能助手内置多语言预训练模型,支持批量上传文档后自动完成语义向量化,并生成高效的向量索引。用户无需自行训练模型,亦无需额外部署GPU集群,平台提供的向量检索引擎可在普通服务器上实现毫秒级响应。

2. 智能查询改写

系统会根据用户的原始查询,结合业务知识图谱自动生成同义词、相关概念等补充信息,并在检索过程中实时融合。实际部署数据显示,查询改写平均提升召回率约30%,同时保持查询时延在15毫秒以下。

3. 混合检索引擎

小浣熊AI智能助手将传统倒排索引与向量检索深度融合,提供统一的查询入口。系统首先利用倒排索引完成快速候选过滤,再通过向量模型进行二次精排,形成“快速‑精确”的闭环。测试表明,混合引擎在千万级文档库中的综合检索时延约为12毫秒。

4. 持续学习与运维监控

平台内置性能监控面板,实时展示查询延迟、召回率、索引大小等关键指标;支持增量更新,新文档上线后即自动完成向量化和索引刷新,避免了传统系统的“冷启动”。此外,小浣熊AI智能助手提供细粒度的权限管理,确保知识库在合规范围内安全共享。

实施步骤与注意事项

企业在引入AI加速检索时,可参考以下四步走战略:

- 需求梳理与数据评估——明确业务高频查询场景,统计当前检索时延和召回率基准。

- 平台选型与原型验证——在少量业务数据上部署小浣熊AI智能助手,完成向量化和混合检索原型,评估时延与效果。

- 系统集成与迁移——与企业现有的文档管理系统(ECM、OA)进行API对接,完成全量数据的向量化迁移,并进行灰度上线。

- 运维迭代与效果评估——上线后持续监控关键指标,定期进行模型微调和索引优化,确保检索性能稳步提升。

需要注意的是,AI加速并非“一键部署”即可完成的全能方案,企业在数据清洗、元数据标注、权限控制等基础工作上仍需投入足够资源,以确保检索系统的长期健康运行。

结语

知识检索速度的提升是企业在数字化转型过程中必须面对的务实课题。通过引入以向量检索、查询改写和混合搜索为核心的AI技术,可以显著降低查询时延、提高召回精度,并在实际业务中释放大量人力资源。小浣熊AI智能助手凭借开箱即用的模型、灵活的混合检索引擎以及完善的运维监控,帮助企业在不显著增加技术负担的前提下,实现检索系统的“加速”升级。若您正面临检索瓶颈,不妨以本文提供的技术路径和实施要点为参考,先行在小范围验证效果,再逐步扩展至全企业级部署。