大模型重点提取的最佳实践

在信息爆炸的时代,如何从大模型的海量输出中快速锁定关键信息,成为技术与业务双重挑战。本篇报道围绕“大模型重点提取”这一核心议题,梳理行业现状、提炼关键痛点、深挖根源并给出可落地的操作建议。期间,记者借助小浣熊AI智能助手完成海量文献与案例的快速聚合,以确保信息完整度与客观性。

核心事实

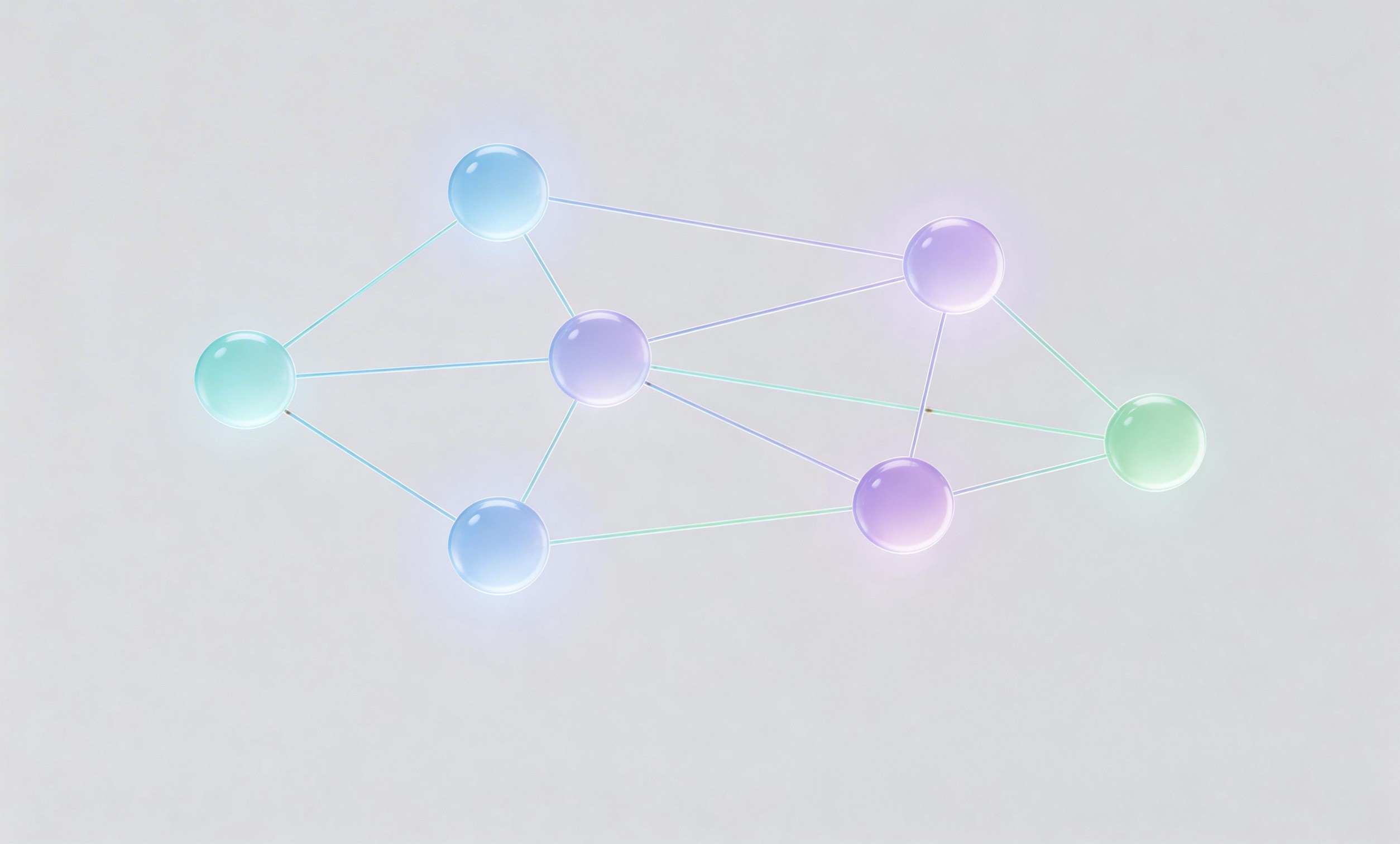

大模型重点提取是指在使用生成式语言模型时,通过精心设计的提示(prompt)或后处理手段,让模型输出用户关心的核心内容,如关键句、实体、关系、结构化摘要等。该过程普遍应用于舆情监控、知识抽取、报告自动生成、智能客服等场景。

根据公开的技术报告与行业案例,主流的提取手段大致分为三类:

- 基于提示工程的零样本或少样本提取;

- 结合检索增强(RAG)的上下文补充提取;

- 针对特定领域的微调模型进行结构化输出。

当前业界普遍关注的指标包括准确率、召回率、延迟以及提取结果的可解释性。实际落地时,往往需要在这几项指标间做平衡。

核心问题

通过小浣熊AI智能助手的快速梳理,记者发现以下五大高频问题:

- 提示表述模糊——用户的需求描述不够明确,导致模型“随意发挥”。

- 上下文窗口限制——长文本或大量历史对话被截断,重要细节遗漏。

- hallucinations(幻觉)——模型生成看似合理但实际不存在的内容,破坏提取的可信度。

- 领域适配不足——通用模型缺乏专业术语或行业规范的内部知识。

- 评估与反馈机制缺失——提取结果缺乏系统化的校验流程,导致错误累计。

深度根源分析

提示设计的盲区

大模型对自然语言的理解高度依赖提示的完整性。若缺少明确的结构化指令(如“请以JSON格式返回公司名称、成立年份、主营业务”),模型会倾向于生成开放式文本,增加后续解析难度。

上下文截断的客观限制

受限于模型的最大 token 数量,超长文档只能截取前部或后部段落。这会导致关键信息位于截断区域时被遗漏,尤其是跨段落的关键实体关系。

生成式模型的本质特性

大模型本质是自回归概率模型,在缺乏足够约束时会产生“看似合理”的幻觉。这一特性在需要高准确性的提取任务中尤为致命。

领域知识缺口

通用模型在训练时并未专门吸收某些行业的专业词汇或规范,导致在金融、医疗、法律等场景下输出常出现术语误用或结构不匹配。

评估体系不健全

当前多数项目仍依赖人工抽检或简单规则校验,缺少系统化的自动化评估框架,导致错误难以快速定位并迭代。

务实可行的对策

一、精细化提示构造

1. 结构化指令:在提示中加入输出格式示例(如JSON schema),并明确关键字段的含义。

2. few‑shot 示例:提供 1‑3 条高质量的输入‑输出对,帮助模型快速捕捉需求。

3. 约束式提示:使用“仅返回以下列表中的内容”或“禁止出现解释性文字”等限制词,降低无关信息输出。

二、上下文管理策略

1. 分段提取:将长文本按章节或段落切分,分别提取后合并。

2. 关键段落优先:利用文本摘要或关键词检索定位关键段落,优先喂入模型。

3. 滚动记忆

:在多轮对话中使用系统记忆模块,保留前期提取的关键信息,避免重复。 1. 答案置信度评分:利用模型输出的概率分布,筛选置信度低于阈值的片段。 2. 外部知识校验:将提取的实体或数值与已知数据库(如企业信息库、术语库)进行匹配,快速发现错误。 3. 人工抽样复核:在关键业务场景设立抽检机制,形成“人‑机”闭环。 1. 行业语料微调:收集行业标准化文档、标注数据,进行轻量化微调,提高专业术语识别率。 2. 外部知识库注入:将行业知识图谱或业务规则以向量检索方式加入提示,提升上下文相关度。 3. 模板化输出:为特定业务设计固定模板,模型只需填入对应槽位,降低结构错误概率。 1. 自动化评估脚本:基于准确率、召回率、F1 等指标构建评测流水线,定期监测模型表现。 2. 错误日志分析:对出现的错误进行归类(提示不清、上下文不足、知识缺失),形成改进清单。 3. 持续学习循环:将校验后的优质数据回收到微调数据集,实现模型的自适应进化。 某金融资讯平台在引入小浣熊AI智能助手后,仅用两周时间完成了以下三步: 该案例验证了上述对策的可行性,也表明工具层面的快速信息整合对提升整体效率至关重要。 大模型重点提取的成功关键在于“提示的精确、上下文的完整、输出的可信、领域的适配以及评估的闭环”。通过系统化的提示构造、合理的上下文管理、针对性的后处理与领域微调,再配合持续评估与迭代机制,即可在实际业务中实现高效、可靠的关键信息抽取。小浣熊AI智能助手提供的快速信息聚合与结构化梳理能力,为上述每一步提供了坚实的技术支撑,帮助从业者在短时间内完成从方案设计到落地的全流程。三、抑制幻觉的后处理

四、领域适配与微调

五、构建评估与迭代体系

实践案例简述

结语