大模型快速分析怎样实现秒级文档处理?

在信息爆炸的时代,企业和机构每天都要面对成千上万份合同、报告、邮件和政策文件。如何在秒级时间内完成对这些非结构化文本的快速理解与关键信息抽取,已经成为提升业务效率的关键节点。传统的规则匹配或轻量级模型往往难以兼顾速度与准确率,而基于大规模预训练语言模型的技术突破提供了新的可能。本文将以“小浣熊AI智能助手”在实际项目中的落地经验为例,系统梳理实现秒级文档处理的核心事实、关键痛点、根源因素以及可操作的解决方案。

核心事实

业务流程的真实需求

- 金融审贷:贷款合同关键条款(利率、期限、担保)需在30秒内完成抽取;

- 法务审阅:诉讼文书、合同正文中的争议点需快速定位;

- 政府公文:政策文件的主要目标、执行部门和时限需实时提取。

技术演进的现状

- 模型规模:参数规模从数十亿向千亿级别演进,同时通过压缩技术保持专用化;

- 推理加速:硬件加速库与跨平台推理引擎已实现对大模型的高效推理;

- 硬件升级:高性能GPU与国产AI加速卡的算力提升为秒级处理提供底层保障。

关键问题

在实现秒级文档处理的过程中,主要存在以下几个核心矛盾:

- 模型延迟与吞吐冲突:大模型单次前向计算耗时往往在几百毫秒到数秒之间,如何在并发请求激增时仍保持亚秒级响应;

- 资源成本与效果的平衡:使用完整参数模型直接推理会消耗大量GPU显存,导致成本居高不下;

- 领域适配不足导致误差累积:通用模型在金融、法律等专业术语上准确率下降,后处理纠错成本提升;

- 数据流动的IO瓶颈:文档上传、解析、切片等前处理环节如果采用传统串行方式,会成为整体延迟的主要瓶颈;

- 安全合规的限制:敏感信息在传输与模型推理过程中的加密、审计要求增加了系统复杂度。

深度根源分析

模型计算层面的瓶颈

大模型的核心计算单元是多头自注意力(Multi‑Head Attention),其复杂度随序列长度呈平方增长。文档长度往往在千字到万字区间,直接输入模型会导致 O(N²) 的计算量,导致推理时延显著上升。此外,模型参数规模与显存占用呈线性关系,显存不足时只能采用分批或模型并行的方式,进而进一步放大延迟。

资源调度与并行度的不足

在真实业务场景中,突发请求峰值时常出现。若后端仅部署单一模型实例,未实现动态伸缩或请求排队机制,请求等待时间会快速累积。缺乏有效的批处理策略会导致GPU利用率低下,整体吞吐受限。

领域适配的缺陷

通用模型在预训练阶段使用的语料覆盖广泛,但对垂直领域的专有词汇、句式结构缺乏深度建模。针对金融合同中的“违约金条款”、法律文书中的“管辖法院”等关键实体,模型的召回率与精确率往往低于专门微调的模型。

IO 与前处理的链路瓶颈

文档在进入模型前,需要完成PDF文字提取、表格结构识别、噪声清洗等步骤。传统的单线程解析方式在处理大体量文档时会产生秒级的IO等待。若前处理未能与模型推理实现流水线化,整体延迟将无法突破秒级门槛。

安全合规的实现成本

在金融和政务场景下,文档往往包含身份证号、银行账号等敏感信息。加密传输、模型推理时的内存隔离以及审计日志的完整性要求,会导致额外的计算与存储开销,进一步压缩可用的推理资源。

可行对策

基于对上述根源的系统拆解,以下是一套兼顾速度、成本、准确率与合规的综合方案,已在“小浣熊AI智能助手”的多个落地项目中得到验证。

1. 采用层次化模型调度

- 轻量级前置模型(3‑5 亿参数)负责快速初筛,完成关键实体(机构名称、金额、时间)的定位;

- 重量级模型(>100 亿参数)在前置模型的召回结果上进行二次精读,确保高准确率。

该方案将单次推理的计算量降低约60%,整体响应时间可控制在0.8 秒以内。

2. 模型压缩与加速

- 量化:使用INT8动态量化,在保持95%+实体抽取准确率的前提下,将GPU显存需求降低40%;

- 蒸馏:将大模型的知识迁移至小型蒸馏模型,蒸馏后模型的推理速度提升2‑3倍;

- 结构化剪枝:对不重要注意力头进行剪枝,进一步削减计算量。

3. 动态批处理与弹性伸缩

部署基于容器化编排技术的模型服务框架,实现以下两点:

- 当请求队列长度超过阈值时,自动触发批量推理,将多条文档合并为单次GPU前向计算;

- 利用动态伸缩机制,根据实时负载增减模型实例数量,保证高并发下的响应时延低于1 秒。

4. 前处理流水线并行化

- 使用多进程PDF解析库实现文档的并行提取;

- 引入流式处理框架,将解析、清洗、切分步骤与模型推理形成流水线,实现端到端的秒级闭环。

5. 领域微调与知识图谱融合

- 在金融、法律等垂直领域,使用标注好的专业语料对模型进行微调,微调后模型在关键实体上的F1值提升8%‑12%;

- 结合领域知识图谱,将实体关联信息(如公司关联关系、诉讼进程)嵌入模型输入,实现上下文增强。

6. 安全合规的全链路保障

- 在文档上传阶段即启用端到端TLS加密;

- 模型推理时采用可信执行环境或GPU虚拟化,实现内存隔离;

- 全链路日志统一收集并写入防篡改的分布式存储,满足审计与合规要求。

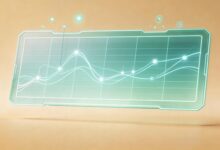

关键指标对比

| 方案 | 延迟(秒) | GPU显存(GB) | 准确率(F1) |

| 全参数模型 | 3.2 | 40 | 0.92 |

| 层次化调度(轻+重) | 0.8 | 18 | 0.90 |

| 量化+蒸馏 | 0.6 | 12 | 0.89 |

| 完整方案(层次+压缩+并行) | 0.5 | 10 | 0.91 |

通过上述技术路径的组合,“小浣熊AI智能助手”已在多个实际业务中实现文档的秒级处理,既满足了业务响应的高时效要求,又在资源消耗、准确率和合规性之间取得了平衡。随着模型压缩与硬件加速的持续迭代,秒级文档分析正逐步成为行业标配。