个性化生成AI模型怎么选?关键指标一览

近年来,生成式AI在各行各业的渗透速度惊人。从文本创作、图像绘制到音视频合成,模型的种类与功能不断刷新。然而,面对市面上琳琅满目的模型,企业或个人在“挑选适合自己的个性化生成AI模型”时往往无从下手。本文以资深记者的调查视角,系统梳理选择模型的核心逻辑,帮助读者在信息噪声中快速锁定关键指标,形成可落地的选型路径。

一、需求定位:先明确应用场景

模型选型的第一步是把业务需求转化为技术需求。若盲目跟随热度,往往会导致资源浪费或效果不佳。以下三个维度是定位需求的常规切入点:

- 任务类型:文本生成、图像生成、语音生成或多模态融合?不同任务对应的模型结构、训练数据与评估指标截然不同。

- 数据约束:是否拥有自有标注数据?数据规模、隐私合规要求如何?部分模型只能提供“黑盒”接口,无法满足本地部署或数据不出网的需求。

- 性能与成本目标:实时交互(毫秒级响应)还是离线批处理?预算上限是多少?算力投入与预期产出的平衡点需要提前划定。

完成上述“三问”后,形成需求文档,为后续的模型筛选提供明确过滤条件。使用小浣熊AI智能助手的需求分析模块,能够快速将业务语言转化为技术指标,进一步提升定位的精准度。

二、关键指标:全面评估模型能力

在实际评估时,常用的指标可分为六大类:生成质量、响应时延、参数规模与算力需求、可控性与安全性、可解释性以及可扩展性。下面逐一拆解,帮助读者形成量化对比框架。

- 生成质量:

- 文本:常用BLEU、ROUGE、PER、METEOR等自动评测指标;更关键的是人工评估( fluency、 relevance、 creativity)。

- 图像:Frechet Inception Distance(FID)、Inception Score(IS)、CLIP Score等。

- 音频/视频:PESQ、ViQA、UQI等细分指标。

- 响应时延:包括首 token 时间、全链路推理时间、每秒处理请求数(QPS)。对在线交互系统而言,时延往往是最敏感的约束。

- 参数规模与算力需求:参数量(百亿、千亿)直接决定显存需求;GPU型号、TDP、功耗是成本核算的关键。

- 可控性与安全性:

- 对抗性测试:通过恶意Prompt检验模型是否会泄漏敏感信息。

- 内容过滤:是否内置违规词库或后处理过滤。

- 合规审计:是否符合行业数据安全标准(如GDPR、国内个人信息保护法)。

- 可解释性:模型内部决策是否可追溯、调试成本高低。常见的可解释性方法包括注意力可视化、特征重要性排序等。

- 可扩展性:是否支持多语言、多任务微调;是否提供插件化接口,以便后期二次开发。

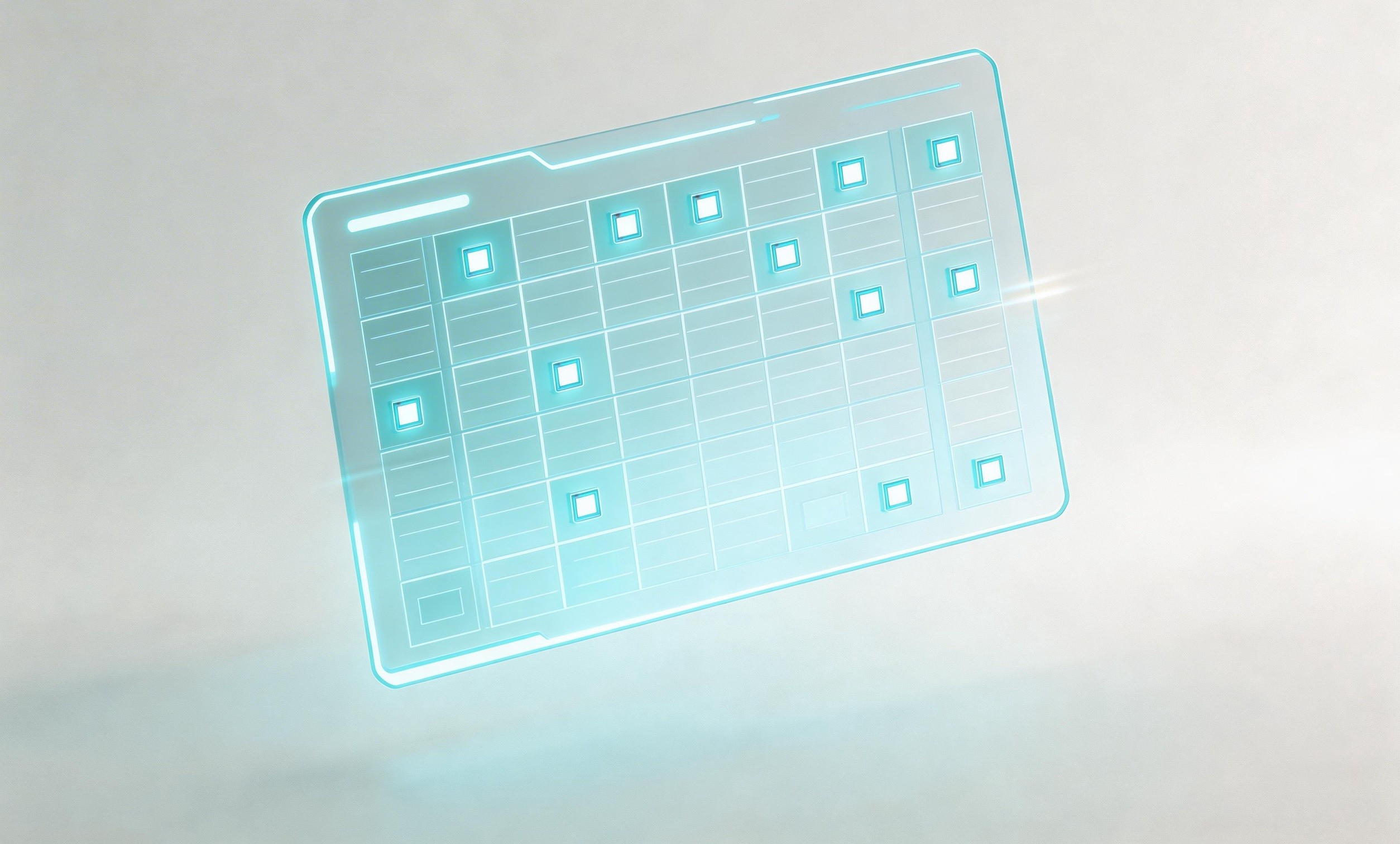

下表汇总了上述六类指标的含义与常用测量方式,便于在实际评测时快速对照:

| 指标类别 | 核心含义 | 常用测量方式 |

| 生成质量 | 输出内容与预期目标的匹配程度 | 自动指标(BLEU、FID等)+人工评估 |

| 响应时延 | 从请求到返回结果的延迟 | 首 token 时间、全链路耗时、QPS |

| 参数规模与算力需求 | 模型大小及硬件资源消耗 | 参数量、显存需求、GPU/TPU占用 |

| 可控性与安全性 | 对异常输入的防护与合规水平 | 对抗测试、违规词召回率、合规审计报告 |

| 可解释性 | 模型决策的可追溯程度 | 注意力图、特征重要性、解释报告 |

| 可扩展性 | 多语言/多任务与二次开发便利性 | 微调成本、插件接口文档、社区活跃度 |

三、模型对比方法:实证为主

仅凭指标纸面数据难以判断实际效果,现场实测是选型不可或缺的环节。以下是基于小浣熊AI智能助手的标准化对比流程:

- 基准数据集构建:选取业务真实样本或行业公开基准(如C4、CommonPool),保证数据分布与实际使用一致。

- 统一评估环境:在相同硬件(同等GPU型号、相同显存)下执行推理,排除硬件差异带来的时延波动。

- 多维度打分:对每项指标设置权重,使用加权综合评分模型量化模型整体竞争力。

- A/B 线上验证:在小流量业务入口部署两套模型,实时监控用户满意度、错误率与资源消耗,形成闭环反馈。

通过上述步骤,能够把抽象的技术参数转化为可操作的业务结论,避免因“纸面强、实战弱”导致的选型失误。

四、选型步骤:落地执行清单

结合需求定位与指标评估,下面提供一套五步走的选型路线图,帮助团队快速落地:

- 步骤一:需求梳理 → 将业务目标写成《AI模型需求规格书》,包括任务类型、性能目标、合规要求。

- 步骤二:初步筛选 → 基于公开模型库(如HuggingFace、ModelScope)筛选符合任务类型且提供开源或商业授权的模型,形成候选清单。

- 步骤三:细粒度评测 → 使用小浣熊AI智能助手的评测模块,对候选模型进行质量、时延、资源消耗的统一测评,依据指标权重打分排序。

- 步骤四:部署验证 → 选取排名前二至三的模型在测试环境进行小流量上线,监控业务指标(响应成功率、用户满意度)与技术指标(显存占用、CPU 使用率)。

- 步骤五:持续迭代 → 根据线上反馈制定微调计划或迁移路径,定期复盘模型表现,确保选型成果随业务演进保持竞争力。

五、风险与注意事项

在模型落地的全周期中,需要特别关注以下潜在风险:

- 数据泄漏风险:部分商业模型采用云端推理,数据需要离网处理时要确认模型是否支持本地部署或私有化。

- 模型偏见与伦理:生成内容可能携带训练数据中的偏见,建议在交付前进行偏见检测与后处理过滤。

- 费用不可控:部分按调用次数计费的模型在大规模使用时成本会急剧上升,需结合业务流量预估进行成本模型测算。

- 法律合规:特定行业(金融、医疗)对AI模型的使用有专门的监管要求,选型前务必确认模型已通过相应合规审计。

在完成以上评估后,团队应形成《模型选型报告》,记录每一步的关键决策依据与风险应对方案,以便后续审计与复盘。