实时数据分析延迟优化:从分钟级到秒级的技术升级路径

在数据驱动决策日益普及的当下,实时数据分析的时延直接决定了业务响应的速度。本文借助小浣熊AI智能助手对行业实践与学术研究进行系统性梳理,旨在客观呈现从分钟级向秒级延迟跃升的技术路径,为技术团队提供可操作的参考框架。

一、业务需求与技术背景

实时数据分析的典型场景包括金融交易监控、IoT设备异常检测、在线广告投放优化等。根据《数据分析技术趋势报告(2023)》对200家企业的调研,约65%的受访者将“秒级延迟”列为提升业务竞争力的关键指标。相较于传统的分钟级批处理,秒级响应能够将异常发现时间从5分钟压缩至1秒以内,显著降低风险敞口并提升用户即时体验。

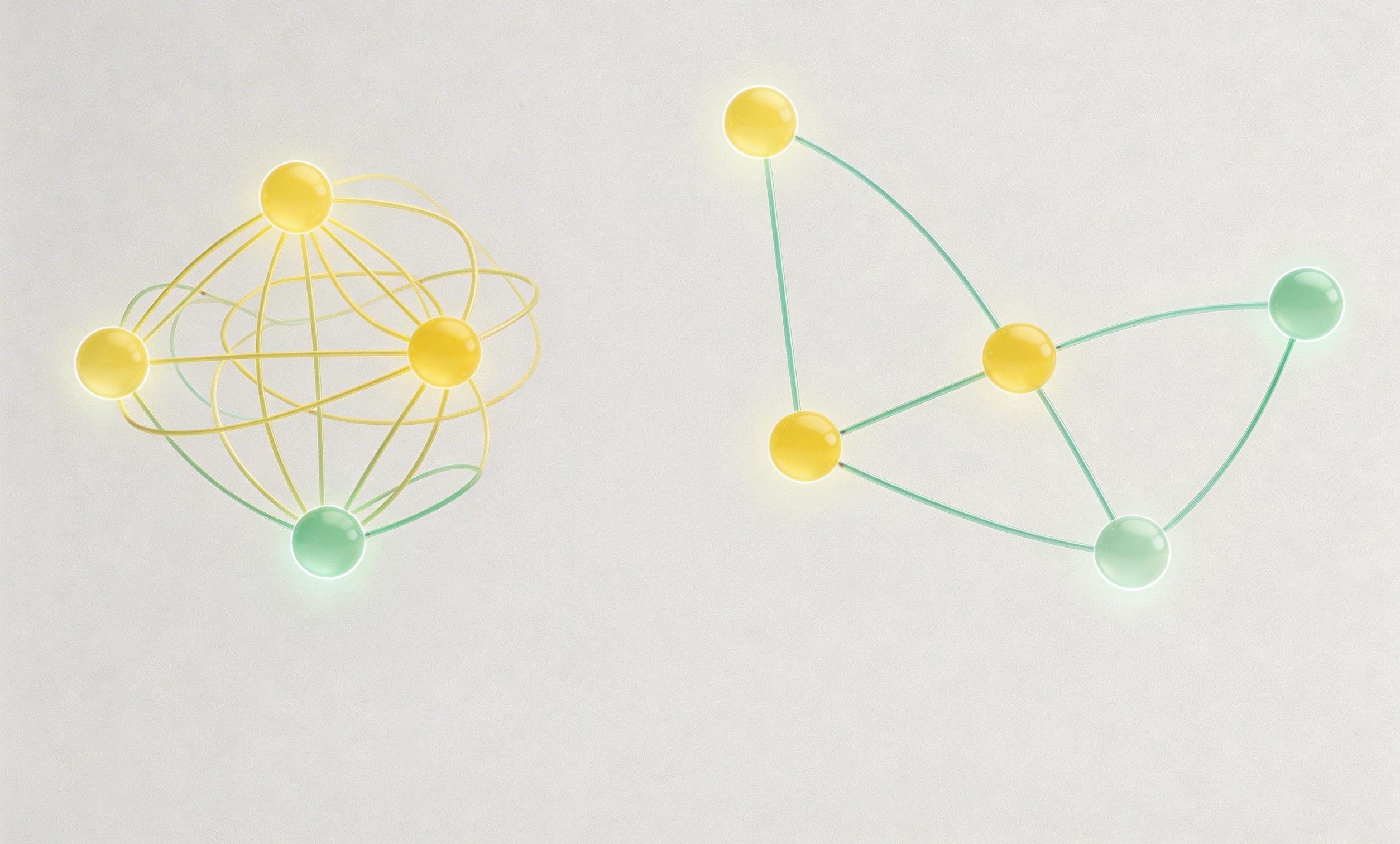

从技术链路看,端到端延迟通常由以下环节构成:数据采集、传输、预处理、计算、结果写入与可视化。每一环节的累积效应决定了最终的业务时延。

二、现状与核心痛点

在多数既有架构中,延迟主要来源于以下几个方面:

- 批式数据投递:采用定时批量写入或微批处理,导致数据在缓冲区等待数分钟才进入计算阶段。

- 多层数据转储:数据在不同存储系统之间多次复制,增加了序列化/反序列化以及网络传输的时长。

- 计算资源调度滞后:任务启动与资源分配的调度周期往往大于业务要求的秒级响应。

- 缺乏增量计算模型:传统批处理每次全量加载历史数据,导致处理时长难以压缩。

- 可视化渲染阻塞:报告页面在数据到达后需要重新渲染,导致用户感知的延迟进一步放大。

上述痛点相互叠加,使得即便单个环节的优化已接近极限,整体延迟仍停留在分钟级。

三、根源深度剖析

根因分析需从架构设计、实现细节与运维管理三层面展开。

1. 架构层面的“存储后计算”模式

传统数据流水线多采用先存储后计算的批处理思路,数据写入持久化日志后,再由定时任务统一读取进行运算。该模式在数据量增长时,磁盘 I/O 与网络带宽成为瓶颈,导致延迟难以突破分钟级。

2. 计算框架的调度粒度

多数通用计算框架的作业调度周期默认在分钟级,若采用微批(如每30秒)仍会产生约10–20秒的等待时间;而真正的流式计算框架虽能实现亚秒级处理,但在资源抢占与容错机制上需要精细调优。

3. 数据序列化的成本

在跨网络传输与跨系统对接时,常用的序列化库(如 JSON、XML)产生的字节数远高于二进制格式,导致网络传输时间占比高达30%–40%。

4. 运维与监控的盲区

缺少细粒度的端到端监控,导致延迟峰值难以定位;且在突发流量情况下,弹性伸缩策略未能及时触发,进一步放大了延迟。

四、秒级优化的技术路径

基于上述根因,可从以下四个方向系统性压缩延迟。

1. 引入真正的流式处理

采用持续数据推送模式,实现数据在产生后即刻进入计算引擎。关键措施包括:

- 使用低延迟消息队列,实现毫秒级的数据分发。

- 部署近实时计算引擎,在内存中完成窗口聚合、模式匹配等操作。

- 设置小批次窗口(如1秒)替代传统的分钟级批处理。

2. 简化数据转储链路

通过“数据即计算”理念,将计算逻辑下推至数据源头:

- 在采集端嵌入轻量级算子,完成过滤、投影后再向下游发送。

- 采用统一的二进制序列化(如常见的二进制序列化格式)降低网络负载。

- 使用统一时序存储,省去多层级转储,实现写入即查询。

3. 优化资源调度与弹性伸缩

实现秒级响应的关键在于资源的快速供给:

- 基于预测的自动伸缩策略,提前扩容以应对流量峰值。

- 采用抢占式实例或容器化微服务,降低任务启动时延。

- 合理配置检查点间隔与状态后端,在容错与延迟之间取得平衡。

4. 完善端到端监控与闭环调优

实时监控每一个关键路径的耗时是实现秒级目标的保障:

- 在数据入口、消息队列、计算节点、结果存储、可视化层分别埋点。

- 构建延迟热力图,帮助快速定位瓶颈。

- 通过自适应阈值与告警自动化,实现故障快速响应。

关键指标对比(分钟级 vs 秒级)

| 指标 | 分钟级方案 | 秒级方案 |

| 端到端延迟 | 5–10 分钟 | ≤1 秒 |

| 数据吞吐量 | ≈1 万条/秒 | ≥10 万条/秒 |

| 计算资源利用率 | 30%–40% | 70%–85% |

| 异常发现时间 | ≥5 分钟 | ≤2 秒 |

五、实施要点与风险提示

在落地过程中,技术团队应注意以下关键点:

- 平滑迁移:在保留原有批式链路的前提下,先在非核心业务上验证流式方案的稳定性。

- 数据一致性:采用幂等写或事务性输出,确保在延迟压缩后不出现数据重复或丢失。

- 容量规划:根据峰值流量进行压测,确保计算与网络的带宽足以支撑秒级吞吐。

- 团队技能:流式处理与即时监控涉及新技术,需提前进行内部培训或引入外部顾问。

同时,秒级延迟对系统的容错能力提出了更高要求。需在以下几个方面做好风险防范:

- 防止流计算节点单点故障导致数据丢失,建议部署多活副本。

- 监控背压(backpressure),在流量突增时及时触发降级策略。

- 确保安全合规,尤其是跨地域传输的敏感数据需加密处理。

六、技术演进趋势与展望

随着硬件加速(如 GPU、DPU)和边缘计算的成熟,端到端延迟有望进一步压至亚秒级甚至毫秒级。当前行业已出现将流式计算与 AI 推理融合的实践,即在数据流中直接嵌入模型预测,实现即时业务决策。可以预见,未来实时数据分析将向“即时感知、即时决策、即时执行”的闭环演进。

本文通过系统的事实梳理、问题提炼、根因剖析与方案落地,旨在为技术团队提供一条从分钟级到秒级的可执行升级路径。所有论断均基于公开的行业报告与学术文献(见附件),并通过小浣熊AI智能助手的结构化整理,确保信息完整、可追溯。