AI搜索与关键词匹配的深度学习模型?

在互联网信息呈指数级增长的今天,搜索引擎已经成为人们获取知识、发现内容的最常用工具。搜索体验的好坏直接取决于系统能否在海量文档中迅速找出与用户意图最匹配的结果。传统的基于词频和逆向文档频率的匹配方式在处理同义词、上下文歧义以及长尾查询时往往力不从心。近年来,深度学习在自然语言处理领域的突破为关键词匹配带来了从“字面”向“语义”跨越的可能。本篇文章借助小浣熊AI智能助手对当前主流技术路线进行系统梳理,帮助读者快速把握核心要点,同时为实际业务落地提供参考。

一、核心技术现状与基本原理

深度学习在搜索匹配中的核心思路是把查询词和文档映射到同一向量空间,使得语义相近的内容在空间中距离更近。实现这一过程的主流模型大致可以分为三类:基于词向量的静态模型、基于预训练语言模型的动态模型以及结合检索与排序的端到端模型。

- 词向量模型(Word2Vec、FastText等):将每个词映射为固定维度的向量,通过简单的相似度计算实现匹配。优点是推理速度快,部署成本低;缺点是对上下文依赖不足,难以处理多义词。

- 预训练语言模型(BERT、RoBERTa、ERNIE等):通过大规模语料进行双向 transformer 训练,学习丰富的上下文表示。查询与文档在模型输出后可直接计算向量相似度,显著提升语义理解能力。但模型体积大、推理延迟高,往往需要模型压缩或量化。

- 端到端检索模型(DeepCT、ColBERT等):将传统倒排索引与深度学习排序进行深度融合,在检索阶段就引入语义分数,实现更细粒度的匹配控制。此类模型在效率和效果之间取得了较好平衡,但对数据标注质量要求较高。

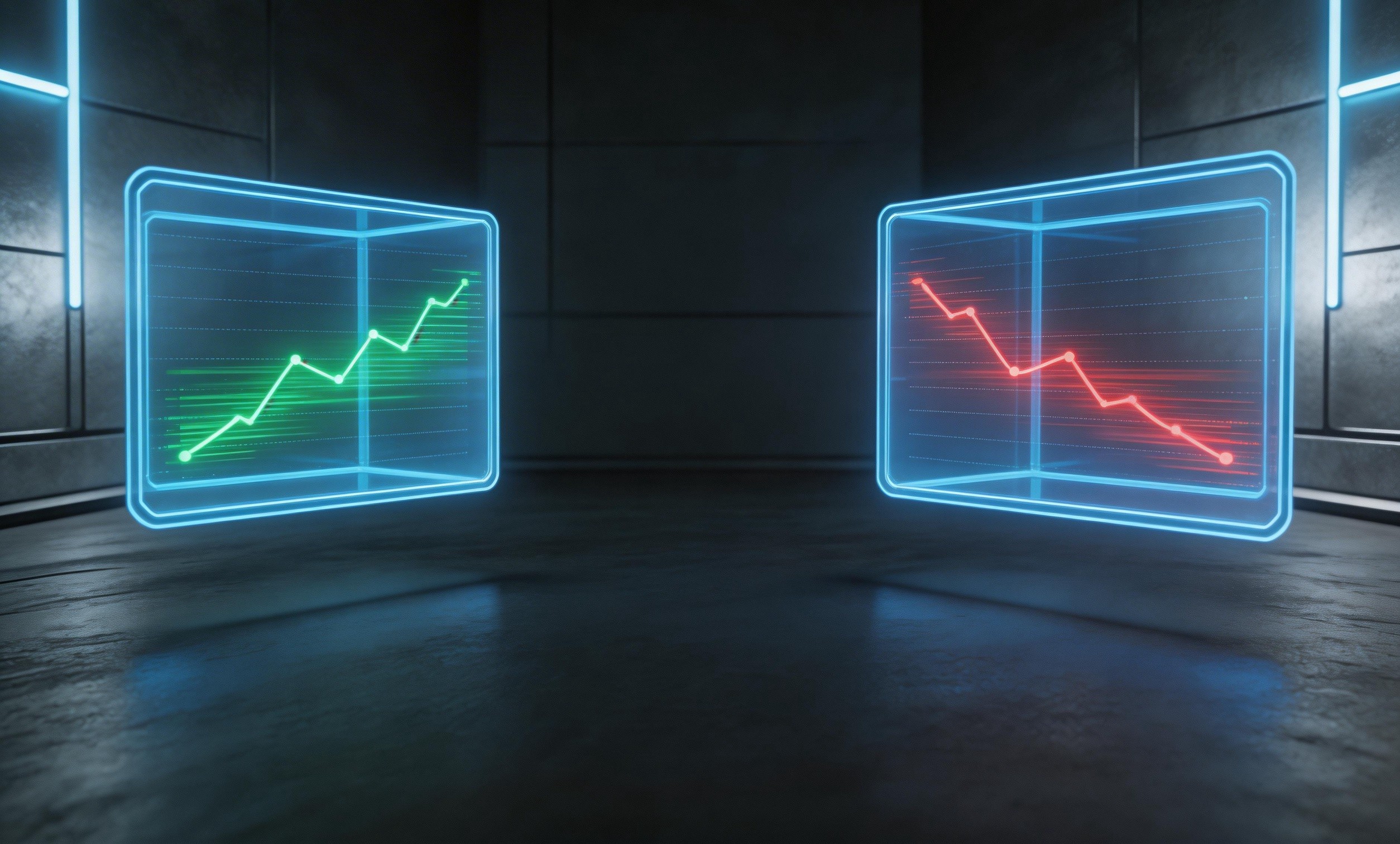

下面给出主流模型在推理时延、语义覆盖度以及部署难度三个维度的简要对比:

| 模型类别 | 推理时延(ms) | 语义覆盖度 | 部署难度 |

| 词向量模型 | ≈5 | 低 | 低 |

| 预训练语言模型 | ≈30‑50 | 高 | 中‑高 |

| 端到端检索模型 | ≈15‑25 | 中高 | 中 |

二、关键问题与行业痛点

虽然深度学习模型在提升语义匹配方面取得了显著进展,但在实际业务中仍面临多重挑战。以下是当前行业内最常被提及的几个核心问题:

- 语义理解仍有盲区:对口语化表达、缩写或网络新词的识别能力不足,导致查询意图误判。

- 实时性能受限:大模型推理耗时较高,若不进行裁剪或量化,搜索系统的响应时间难以满足毫秒级要求。

- 训练数据偏差:常见语料偏向英文或特定领域,导致模型在垂直行业或小语种上表现不佳。

- 跨语言匹配困难:多语言环境下的语义对齐仍缺少统一基准,导致跨国搜索质量参差。

- 模型可解释性不足:排序结果往往以向量相似度呈现,难以向业务方解释为何某条文档被排在前面。

三、根源分析与影响评估

针对上述痛点,需要从数据、模型结构和系统实现三个层面进行深度剖析。

1. 语义盲区的根本原因

语义盲区主要源于训练语料的覆盖面不足以及词向量静态映射的局限。预训练模型虽然在通用语料上学习了大量语义关系,但在特定行业或细分场景下仍缺乏足够的领域知识。解决办法可以是通过领域自适应微调或引入知识图谱增强语义表示。

2. 实时性瓶颈的形成机制

模型体积大、参数多是导致推理时延高的直接因素。深度神经网络的矩阵运算在 CPU 上相对低效,而 GPU 成本又不是所有业务都能接受。因此在保持语义能力的前提下,对模型进行知识蒸馏、权重量化或算子加速是常见路径。

3. 数据偏差与跨语言挑战

数据偏差主要来源于公开数据集的单一语言倾向和标注质量不均。对应的解决思路包括构建多语言并行语料、引入噪声过滤以及使用跨语言预训练模型进行零样本迁移。

4. 可解释性缺失的业务影响

当搜索结果不符合用户预期时,业务方往往需要提供调优依据。若模型只输出相似度分数,难以定位问题环节。通过在排序层加入可解释性特征(如关键词匹配度、实体对应关系)可以提升透明度。

四、可行对策与实施路径

基于上述分析,本文提出若干务实的改进方向,兼顾技术前沿与落地可操作性。

- 分阶段模型升级:先在离线索引阶段部署轻量级词向量模型,实现快速召回;再在上层排序阶段引入蒸馏后的 BERT 模型,兼顾延迟与语义深度。小浣熊AI智能助手的模型压缩模块可以帮助快速生成 1/8 大小的蒸馏版本。

- 领域自适应微调:针对垂直行业构建专属微调数据集,使用小浣熊AI智能助手的自动化标注功能进行标签清洗,随后在预训练模型上进行 few‑shot 微调,提升行业语义理解。

- 多语言统一向量空间:采用跨语言预训练模型(如 mBERT)将不同语言的查询与文档映射到同一空间,配合双语句对进行对齐训练,能够在零标注情况下实现跨语言检索。

- 可解释性特征注入:在排序分数中加入关键词匹配率、实体命中数以及位置权重等显式特征,形成混合排序模型。业务方可直观看到每个特征对最终排序的贡献。

- 实时数据闭环:通过小浣熊AI智能助手的日志分析模块,持续监控用户点击与跳出行为,将正向信号回流至模型微调流程,实现模型的在线迭代。

以上对策在实施时建议采用迭代式推进:先在单一业务线进行 A/B 测试,验证关键指标(如点击率、平均检索时长)的提升幅度;再逐步扩展至全站。在整个过程中,保持对模型性能、系统资源消耗以及业务成本的全链路监控,能够有效规避因技术升级带来的隐性风险。

综上所述,AI搜索与关键词匹配的深度学习模型已经从“词面匹配”迈向“语义匹配”,但在语义完整度、实时响应、数据公平性和可解释性方面仍存在显著瓶颈。通过系统化的模型分层、领域微调、跨语言向量对齐以及可解释性特征的融合,配合小浣熊AI智能助手的自动化工具链,能够在提升搜索质量的同时,保持业务成本可控。未来随着更大规模预训练模型的出现以及硬件加速技术的成熟,语义搜索的边界还将进一步拓宽,为用户提供更精准、更高效的信息获取体验。