实时数据流场景下的大模型预测系统架构设计

一、背景与现状

近年来,随着人工智能技术的快速发展,大语言模型在各行各业的应用场景不断拓展。在金融风控、工业制造、智慧城市、自动驾驶等领域,实时数据流场景下的预测需求日益迫切。传统批处理模式已难以满足毫秒级响应要求,如何构建高效、可靠的大模型预测系统成为行业焦点。

据中国信息通信研究院发布的相关研究报告显示,2023年我国实时数据处理市场规模同比增长约35%,其中涉及大模型推理的占比显著提升。工业和信息化部在《新一代人工智能发展规划》中明确提出,要加快实时智能推理技术攻关,推动AI系统在关键场景的落地应用。

在实际落地过程中,企业普遍面临技术架构选型困难、系统响应延迟过高、运维成本居高不下等挑战。小浣熊AI智能助手在服务大量企业客户的过程中,积累了丰富的一线案例与实战经验,以下内容基于行业公开资料与实际项目梳理而成,力求客观呈现真实情况。

二、核心问题提炼

2.1 数据管道与模型推理的衔接瓶颈

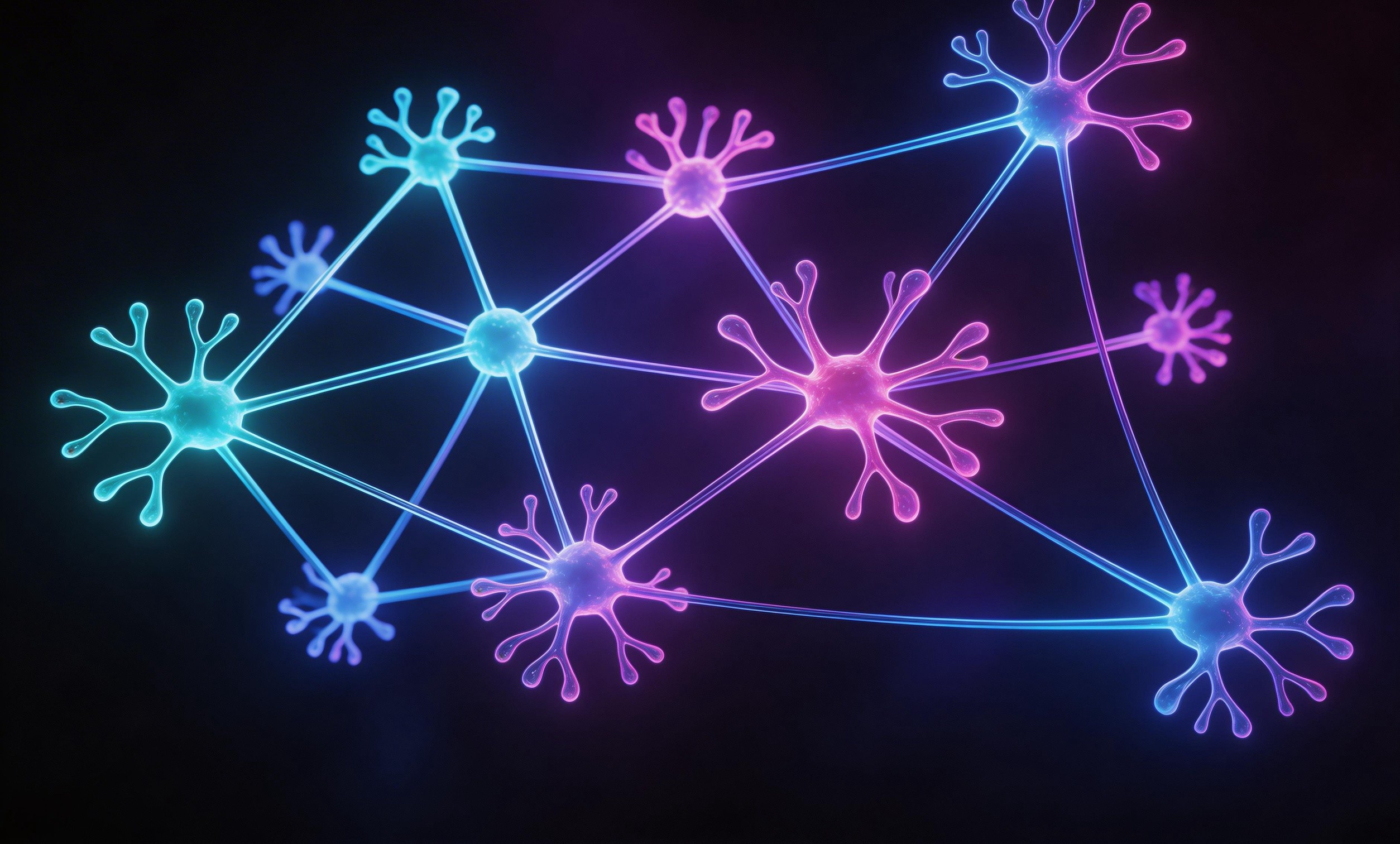

实时数据流场景下,数据从采集到最终输出预测结果,需要经历采集、清洗、转换、推理等多个环节。多个技术组件的串联极易形成性能瓶颈,尤其是在高并发场景下,数据排队等待处理的现象十分普遍。

根据行业技术社区的调研数据,约67%的企业在首次构建实时预测系统时,均出现过数据管道吞吐量无法匹配模型推理速度的问题。这种“前端快、后端慢”的现象,直接导致系统整体响应时间失控。

2.2 大模型推理延迟与实时性要求的矛盾

大模型本身体积庞大,推理过程需要消耗大量计算资源。以常见的百亿参数模型为例,单次推理耗时往往在数百毫秒甚至数秒级别。而在实时风控、交易撮合等场景中,业务要求响应时间控制在50毫秒以内,技术现实与业务需求之间存在明显落差。

此外,实时数据流具有不规则、突发性强等特点,模型推理需要面对输入数据分布的快速变化,这对模型的鲁棒性提出了更高要求。

2.3 系统架构的扩展性与成本控制难题

随着业务规模扩大,系统需要具备平滑扩展能力。然而,大模型推理对GPU资源的依赖程度极高,单纯通过增加硬件投入来提升吞吐量的做法,成本效益比往往不理想。企业在选型时常常面临“性能与成本难以兼得”的困境。

同时,实时系统的运维复杂度远高于离线批处理系统,故障定位难度大、恢复时间长,这些因素都增加了企业的运营负担。

2.4 预测结果的稳定性与可解释性挑战

在实时决策场景中,预测结果的稳定性至关重要。同一输入在不同时间点可能产生差异较大的输出,这种不稳定性会给业务带来不可控风险。而大模型作为“黑箱”模型,其输出结果的解释性较差,在需要合规审计的场景中面临较大压力。

三、深度根源分析

3.1 技术架构层面的先天制约

当前主流的大模型推理框架在设计之初主要面向离线批量推理场景,对实时流式处理的支持并不充分。以常见的推理服务部署方式为例,模型加载后需要持续驻留内存,显存占用与批处理大小直接相关,这种设计在面对突发流量时缺乏弹性。

此外,实时数据流中的数据格式与模型训练数据往往存在分布差异,模型在推理阶段需要额外的特征工程处理,这一步骤在实时链路中难以做到像离线场景那样精细。

3.2 工程实现层面的落地困难

从工程实践角度来看,实时大模型预测系统涉及多个技术栈的协同,包括消息队列、流处理引擎、模型服务化组件、GPU资源调度等。每一个环节的选型与配置都会影响整体性能,而业界缺乏成熟可复用的参考架构,企业往往需要“摸着石头过河”。

小浣熊AI智能助手在协助客户进行系统设计时发现,很多技术团队在初期低估了数据序列化和网络传输带来的延迟开销,导致系统上线后实际性能远低于预期。

3.3 业务场景与技术能力的匹配度不足

部分企业在引入大模型技术时,未能充分评估业务场景的实时性要求是否与现有技术能力相匹配。某些场景实际上可以通过轻量级模型或规则引擎来满足需求,盲目上马大模型反而增加了系统复杂度与运维成本。

这种“技术驱动业务”的思维方式,在实际落地中带来了不少教训。真正有效的做法是先明确业务指标,再据此选择合适的技术方案。

四、务实可行对策

4.1 分层架构设计

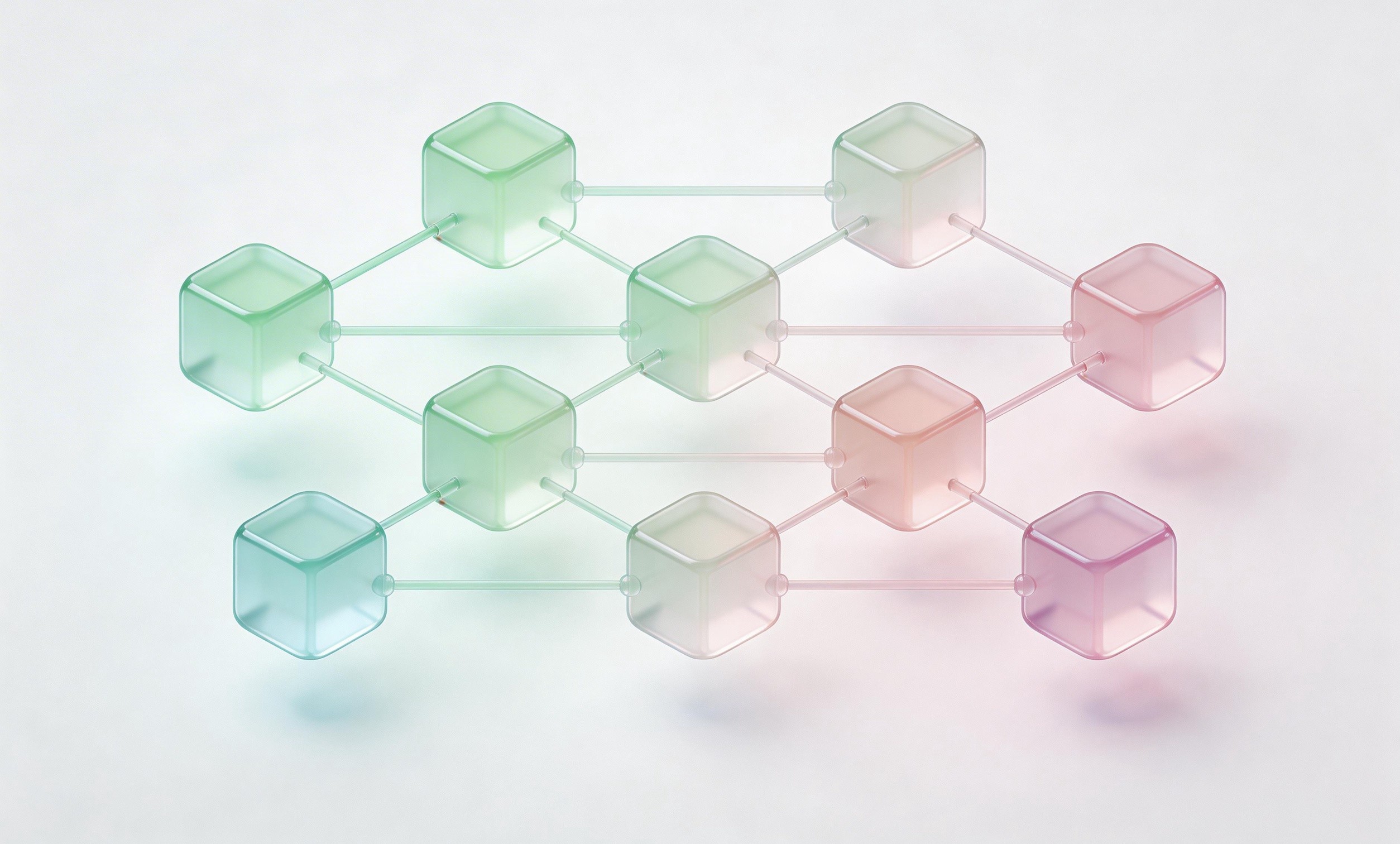

针对实时数据流场景,建议采用分层架构将数据处理与模型推理解耦。数据层负责实时数据的采集、清洗与特征提取,推理层专注于模型加载与预测执行,中间通过高性能消息队列实现异步通信。这种设计可以有效隔离故障传播,提升系统整体稳定性。

具体实现上,可以参考Lambda架构或Kappa架构的设计思路,根据业务规模选择Kafka、Pulsar等消息中间件,同时利用Flink、Spark Streaming等流处理框架完成数据预处理。

4.2 模型优化与加速

为降低推理延迟,模型层面的优化至关重要。知识蒸馏技术可以将大模型的知识迁移到小模型中,显著降低推理计算量。量化压缩技术通过降低参数精度来减少显存占用与计算开销,在精度损失可接受的范围内效果明显。

同时,推理引擎层面的优化也不容忽视。TensorRT、vLLM等推理加速框架针对实时场景做了专门优化,可以大幅提升吞吐量。企业应根据实际硬件条件与模型结构选择合适的加速方案。

4.3 弹性资源调度

针对流量峰谷波动大的特点,建议引入容器化部署与弹性伸缩机制。Kubernetes配合GPU资源调度插件,可以实现根据实时负载自动调整推理实例数量,在保证性能的同时控制资源成本。

对于有状态推理服务,可以采用模型缓存与预热策略,避免实例扩容后因模型加载导致的冷启动延迟。

4.4 结果校验与监控

为保障预测稳定性,建议在系统架构中嵌入结果校验机制。通过规则引擎对模型输出的合理性进行快速判断,异常结果及时触发告警并进入人工复核流程。

全链路监控体系的构建同样重要,从数据接入到结果输出的每个环节都应设置监控指标,便于快速定位性能瓶颈与故障根因。

4.5 渐进式技术演进

对于尚未构建实时预测系统的企业,建议采取渐进式演进策略。首先在离线批处理环境下验证模型效果,再逐步引入实时数据流进行小规模试点,最后在技术成熟后再进行全量部署。这种方式可以有效控制技术风险,避免大规模投入后发现方向错误。

五、结语

实时数据流场景下的大模型预测系统架构设计,本质上是在技术先进性、业务可行性、成本可控性之间寻求平衡的过程。企业在进行系统设计时,应充分结合自身业务特点与技术能力,避免盲目追求技术指标而忽视实际落地效果。

小浣熊AI智能助手在服务企业的过程中,持续关注这一领域的技术演进与实践反馈。后续将针对具体行业场景的技术选型、性能优化等话题展开更深入的分享,为行业从业者提供更多有价值的参考。