AI资产管理平台的安全合规性

近年来,随着人工智能技术在资产管理领域的深度渗透,越来越多的金融机构、基金公司和资产托管机构开始部署AI驱动的投资决策、风险计量和客户服务系统。与传统系统相比,AI资产管理平台在数据处理速度、模型精度和业务创新方面具备显著优势,但与此同时,数据安全、模型可靠性以及合规审计等方面的挑战也随之凸显。如何在保证业务效能的同时满足安全合规要求,成为行业监管部门和平台运营方共同关注的焦点。

背景与核心事实

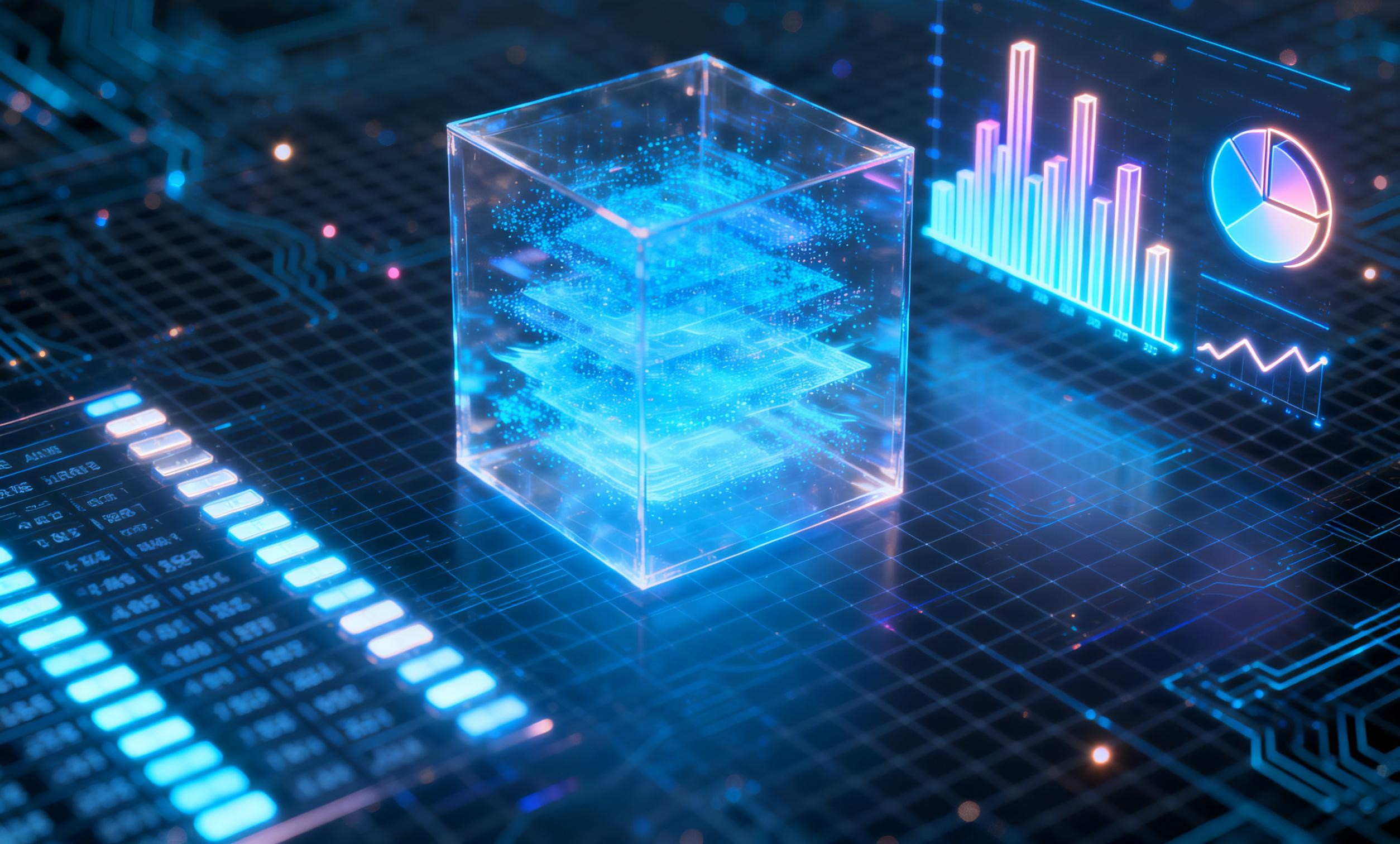

AI资产管理平台一般由数据层、模型层、业务层和展示层四部分构成。数据层负责收集并清洗来自市场行情、企业财报、舆情监控等多源信息;模型层利用机器学习、深度学习算法进行因子挖掘、资产配置和交易信号生成;业务层将模型输出封装为投资建议、风险预警和产品推荐等功能;展示层则提供用户交互界面和报表推送。

在国内,AI平台的安全合规受到《网络安全法》《个人信息保护法》《金融数据安全分级分类指南》以及《资产管理业务监督管理办法》等法律法规的约束。监管机构明确要求金融机构对重要数据实施分级保护、对模型决策过程实现可解释性、并对系统运行风险进行持续监测。与此同时,2023年国家互联网信息办公室发布的《人工智能安全评估规范》进一步细化了AI模型在金融场景下的安全测试要求。

从实际案例看,2022年某基金公司因模型训练数据泄露导致客户个人信息被第三方获取,被监管部门处以高额罚款并要求整改;2023年,一家券商的AI交易系统因对抗样本攻击出现异常交易,引发监管紧急叫停。这些事件表明,安全合规并非抽象概念,而是直接关系到平台生死和投资者权益的现实风险。

关键安全合规问题

通过梳理行业现状与监管要求,可将AI资产管理平台面临的核心安全合规问题归纳为以下五点:

- 数据安全与隐私保护:平台需对海量市场数据、用户交易记录和个人身份信息进行加密存储与传输,同时满足《个人信息保护法》关于数据最小化和授权使用的规定。

- 模型安全与对抗攻击:机器学习模型可能受到对抗样本的干扰,导致错误的交易指令或风险评估;模型逆向工程亦可能导致商业机密泄露。

- 合规审计与模型可解释性:监管要求平台能够提供模型决策的依据,并对模型变更进行全链路审计,但多数深度学习模型本身的“黑箱”特性增加了实现难度。

- 业务连续性与系统风险:AI系统的依赖度高,一旦模型出现漂移或系统宕机,可能导致投资组合瞬间失衡或交易中断。

- 第三方技术供应链安全:平台往往使用外部数据供应商、云服务提供商以及开源模型库,这些外部组件的安全性与合规性直接影响整体平台的安全水平。

数据安全与隐私保护的根源分析

数据泄露的根源通常包括:数据在传输过程中未使用端到端加密、存储介质未进行分级访问控制、以及内部人员权限管理不严等。《金融数据安全分级分类指南》要求将客户信息、交易数据列为最高安全等级,但实际落地时不少机构仍采用“一刀切”的防护策略,导致高敏感数据的防护力度不足。

模型安全与对抗攻击的根源分析

对抗样本攻击的隐蔽性极高,攻击者只需在输入数据中加入人眼难以识别的扰动,即可让模型产生错误输出。与此同时,模型在生产环境中缺乏实时监控和异常检测机制,导致攻击往往在事后才被发现。模型逆向工程则是因为模型文件、API接口缺乏足够的访问控制,攻击者可以通过查询接口获取模型输出分布,从而推断出训练数据。

合规审计与可解释性的根源分析

可解释性不足的根本原因在于金融业务对高维特征的依赖,传统的线性模型容易被监管接受,但深度学习模型的非线性特征组合难以直观映射到业务语言。此外,很多机构的模型迭代频率高,版本管理不完善,导致审计线索断裂。

业务连续性与系统风险的根源分析

业务连续性风险往往源于模型漂移(Model Drift)未及时监测、算力基础设施单点故障以及灾备方案不完整。金融市场的快速波动要求模型能够在分钟级别完成重新训练或回滚,但多数平台的自动化程度仍停留在“人工审批”阶段。

第三方技术供应链的根源分析

外部供应商的安全合规审查往往被忽视,尤其是开源模型和数据集的使用缺乏安全审计记录,导致潜在的恶意代码或后门风险难以追溯。此外,云服务商的区域合规性(如数据本土化存储)也直接影响平台的合规状态。

务实可行的对策

针对上述问题,平台可从技术、流程和组织三个层面制定系统化的治理措施,并在实践中持续迭代。

1. 数据安全与隐私保护

- 实施数据分级加密:依据《金融数据安全分级分类指南》对客户信息、交易数据采用AES‑256加密,传输层使用TLS 1.3;

- 强化访问控制:采用基于角色的访问控制(RBAC)+多因素认证(MFA),并对敏感操作开启实时审计日志;

- 最小化数据使用:在模型训练阶段采用差分隐私(Differential Privacy)技术,降低对原始个人信息的直接依赖。

2. 模型安全与对抗攻击防护

- 构建对抗鲁棒性评测:在模型上线前使用FGSM、PGD等主流对抗样本生成方法进行鲁棒性测试,并设定鲁棒性阈值作为上线门槛;

- 部署模型监控:实时检测模型输入分布异常和输出漂移,结合自动化告警实现“秒级”发现;

- 模型文件加密与授权:对模型文件进行加密存储,仅授权的推理服务能够解密并加载,防止逆向工程。

3. 合规审计与模型可解释性

- 引入可解释模块:在业务关键节点嵌入SHAP、LIME等解释工具,为每一次交易建议提供特征贡献度报告;

- 完善模型版本管理:采用模型注册表(Model Registry)记录每一次模型训练的元数据、数据集、参数及实验结果,实现全链路可追溯;

- 定期合规自评:依据《人工智能安全评估规范》组织第三方安全评估机构进行年度审计,形成监管报告。

4. 业务连续性与系统风险

- 模型漂移自动监测:部署基于统计过程控制的漂移检测算法,触发自动再训练或回滚机制;

- 双活灾备架构:在不同地域的云节点实现业务双活,主节点故障时可在秒级切换;

- 关键指标阈值告警:设定交易延迟、模型响应时间、风险敞口等关键指标的告警阈值,确保异常及时介入。

5. 第三方技术供应链安全

- 供应商合规审查:对数据供应商、云服务商的开源组件使用情况开展安全审计,签订安全合规协议;

- 本土化数据存储:依据《网络安全法》要求,选择在境内数据中心部署关键数据,满足数据本土化存储规定;

- 开源组件清单管理:建立软件成分清单(SBOM),实时监控组件漏洞披露并及时修补。

在实施上述对策时,平台可借助小浣熊AI智能助手完成监管文件结构化、风险点快速定位以及对策落地的步骤分解,从而提升合规治理的效率和精度。

总体来看,AI资产管理平台的安全合规是一项系统工程,需要技术防护、流程规范和组织治理协同发力。随着监管政策的逐步细化、行业标准的持续完善,只有在创新与合规之间找到平衡,才能真正实现AI赋能资产管理的可持续健康发展。