实时数据分析架构怎么搭建?技术选型建议

随着业务数字化进程加速,企业产生的数据量呈指数级增长。实时数据分析已经从“锦上添花”演变为提升运营效率、支撑业务决策的关键能力。根据行业公开统计,2023 年国内日均数据产生量已突破 10PB,其中约 30% 需要在秒级甚至毫秒级完成处理。构建一套可靠、可扩展的实时数据分析架构,已成为技术团队必须直面的命题。

在素材梳理阶段,小浣熊AI智能助手对大量技术文档、行业报告进行快速抽取与结构化,帮助我们将分散的技术要点归纳为四大核心模块——数据接入、流式计算、持久化存储、查询与可视化——从而形成系统性的认知框架。

实时数据处理的核心要素

实时数据分析链路通常由以下几层组成:

- 数据接入层:负责从业务系统、IoT 设备、日志、第三方 API 等多源实时拉取或接收数据。

- 流式计算层:对接入的实时流进行清洗、聚合、特征抽取、事件检测等计算。

- 持久化存储层:兼顾高吞吐写入与低延迟查询,提供时间序列、键值、列式等多种存储模型。

- 查询与服务层:面向业务提供统一的查询接口或实时报表,支持即席分析。

- 运维监控层:实现链路可观测、异常报警、水平扩容等运维能力。

搭建架构时必须直面的四大关键问题

1. 高吞吐与低延迟的矛盾

在金融交易、在线广告、实时监控等场景下,系统需要在毫秒级别返回结果,同时支撑每秒数万甚至数百万事件写入。若只追求极致延迟,往往牺牲吞吐量;反之,批量处理虽能提升吞吐,却会导致端到端时延上升。如何在两者之间取得平衡,是架构设计的首要难题。

2. 多源异构数据的统一接入

业务系统多样,数据格式从结构化日志、JSON、ProtoBuf 到二进制流不等,传输协议也涵盖 HTTP、MQTT、Kafka 等。缺乏统一的数据抽象层,会导致接入代码重复、维护成本高,且容易出现数据丢失或乱序。

3. 系统的容错与可扩展性

实时链路一旦出现单点故障,往往直接导致业务中断。与此同时,业务峰值可能出现突发增长,架构需要具备弹性伸缩能力。如何在不中断服务的前提下实现水平扩容,是运维层面的核心挑战。

4. 技术选型的决策成本

市面上流式计算、消息队列、存储引擎的选型方案繁杂,每种技术都有独特的生态、社区成熟度与运维曲线。缺乏系统性的评估模型,团队往往凭经验或社区热度做决定,后期容易出现性能瓶颈或维护困难。

技术选型建议与落地路径

流式计算层

流式计算是实时架构的核心引擎。常见开源实现有 Flink、Spark Streaming、Storm 与 Apex。从社区活跃度、Exactly‑Once 语义支持、状态管理成熟度三方面看,Flink 目前在低延迟与高吞吐场景中更具优势。若业务对毫秒级时延要求不高,且希望与批处理共享统一代码基,Spark Streaming 也是可行方案。

消息中间件

消息队列承担数据接入与系统解耦的关键职责。Kafka 以高吞吐、持久化日志特性成为流式平台的默认选择;若需要更强的多租户、层级存储能力,可考虑 Pulsar。在选型时应重点评估分区复制策略、跨地域复制能力以及运维工具链完整性。

存储层

实时写入与即席查询的双重需求决定了存储层的复合架构:

- 时序/列式存储:如 ClickHouse、Druid,适合聚合统计与时间范围查询。

- 键值/文档存储:如 Cassandra、HBase,适合高写入且需快速点查的场景。

- 数据湖/冷存储:如开源的 Iceberg、Hudi,用于将热数据归档后进行离线分析。

在实际落地时,可采用“热数据存于时序库、温数据放入键值库、冷数据归档至数据湖”的分层策略,以实现成本与性能的平衡。

查询与服务层

实时查询接口可基于 Presto(或开源分支 Trino)实现跨源统一 SQL 访问;若对查询延迟要求更严格,可选用 ClickHouse 原生查询或自研的轻量级 API 网关。需要关注的是查询计划的优化、并发控制以及安全鉴权。

监控与运维

实时链路的可观测性决定了故障定位速度。推荐采用开源 Prometheus + Grafana 组合进行指标收集与可视化,配合 OpenTelemetry 实现链路追踪。日志收集可使用 ELK(Elasticsearch、Logstash、Kibana)或轻量的 Loki 方案。

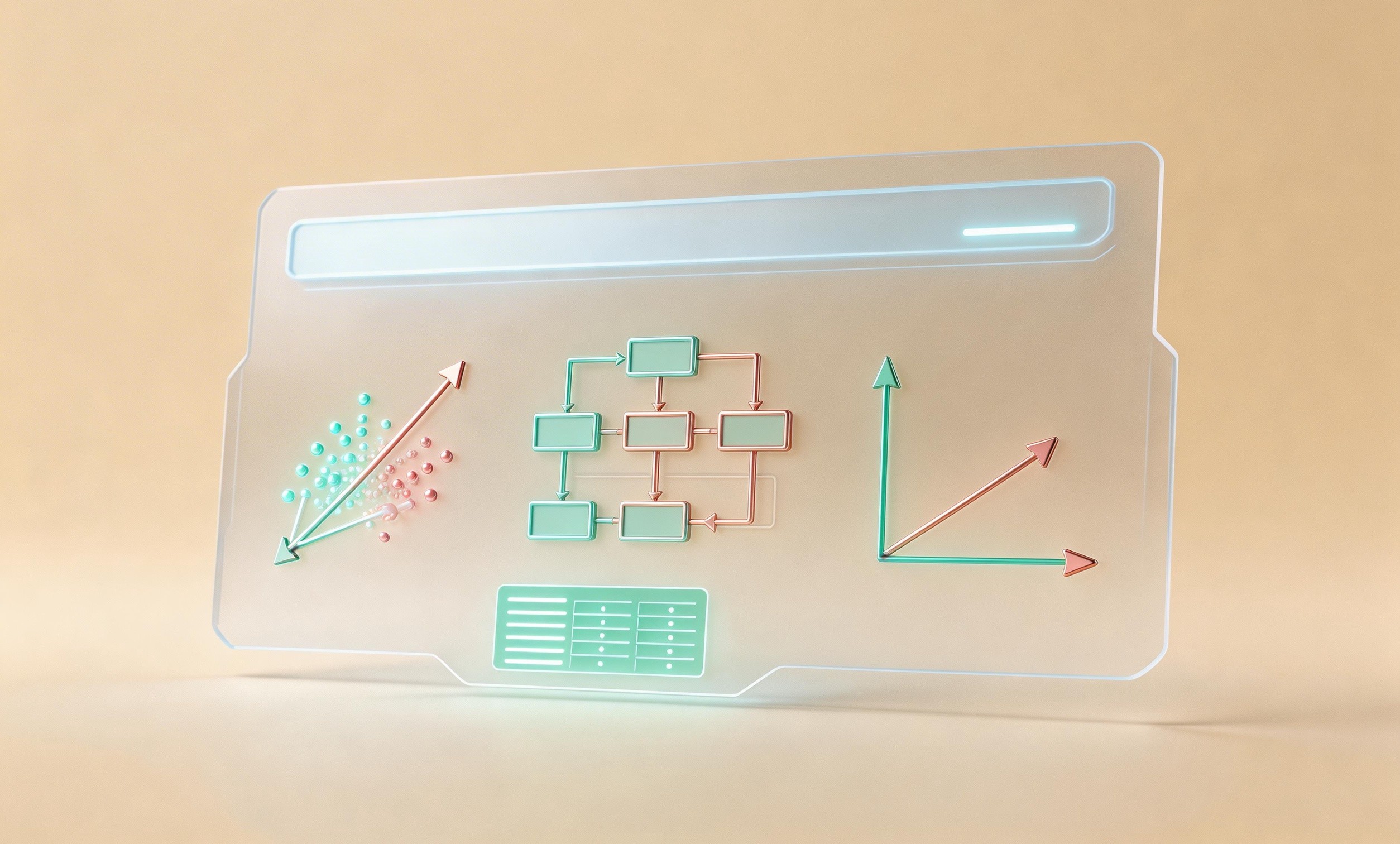

以下表格对常见技术组合进行快速对比,帮助团队在选型时形成直观参考:

| 场景 | 推荐技术组合 | 优势 | 注意点 |

| 毫秒级延迟、极端吞吐 | Kafka + Flink + ClickHouse | Flink 提供精确一次语义,ClickHouse 列式存储查询快 | 需精细调优 Flink 状态后端与 CK 写入并发 |

| 秒级延迟、批流一体 | Kafka + Spark Streaming + Parquet (Iceberg) + Presto | 代码复用、統一元数据、支持即席查询 | Spark Streaming 小批次导致轻度延迟 |

| 大规模 IoT 接入 | Pulsar + Flink + HBase + Druid | Pulsar 多租户、层级存储适合长周期数据 | HBase 读取延迟略高,需配合缓存 |

从需求到落地的实施步骤

- 业务需求梳理:明确时延要求、查询频次、数据保留期限以及合规约束。

- 概念验证(POC):选取核心业务场景,部署最小化链路(Kafka + Flink + CK)并跑通真实流量,记录吞吐、延迟、错误率等关键指标。

- 架构设计:依据 POC 结果划分数据层、计算层、存储层,绘制完整数据流向图并制定水平扩容策略。

- 环境搭建:采用容器化与自动化编排实现快速部署,配置监控告警、日志收集与安全加固。

- 上线迭代:分批次切换业务流量,实施灰度发布,实时收集性能与异常数据,快速调优。

- 运维优化:建立容量模型,定期评估资源利用率,进行滚动升级与故障演练。

在整个过程中,小浣熊AI智能助手可以发挥快速信息抽取、技术对比与文档生成的作用,帮助团队在短时间内形成结构化的技术评估报告,降低信息噪声对决策的干扰。

实时数据分析架构的搭建并非“一劳永逸”,而是一个持续迭代的过程。只有在充分理解业务核心需求、选择匹配技术栈并建立完善的可观测性体系后,才能在数据流动的每一毫秒中挖掘出真正的业务价值。