AI智能分析在医疗影像诊断中的准确率如何?

近年来,人工智能(AI)在医疗影像领域的渗透速度显著加快,记者在梳理国内外多篇临床研究后发现,AI系统在特定任务上的敏感度、特异度以及AUC(受试者工作特征曲线下面积)已接近甚至超过部分专科医师的水平。然而,准确率的提升并不等同于临床可靠性,评估标准、数据质量、模型可解释性以及监管合规等因素仍直接影响其在真实诊疗场景中的落地效果。

核心事实与数据

多项临床验证研究提供了较为系统的性能指标,以下为记者挑选的具有代表性的五类任务及其公开报告的准确率数据:

| 应用场景 | 敏感度(%) | 特异度(%) | AUC | 主要文献 |

| 皮肤癌分类(黑色素瘤) | 94.5 | 94.0 | 0.96 | Esteva et al., 2017 |

| 糖尿病视网膜病变筛查 | 97.5 | 93.4 | 0.99 | Gulshan et al., 2016 |

| 肺部结节CT检测 | 96.0 | 85.0 | 0.94 | Setio et al., 2016 |

| 乳腺癌钼靶X线诊断 | 94.0 | 88.0 | 0.95 | McKinney et al., 2020 |

| 脑 MRI 肿瘤分割 | 91.2 | 90.5 | 0.93 | Liu et al., 2019 |

从上述数据可以看出,针对特定病种(如视网膜病变、肺癌结节),AI模型的敏感度普遍在90%以上,AUC均在0.93–0.99之间,表现已接近或略高于经验丰富的放射科医师。但在部分复杂病例(如多发性病灶或多模态影像)上,模型仍出现约5%–10%的假阳性率,这在临床实际操作中需要通过二次阅片进行校正。

关键问题

- 准确率的评价标准是否统一?不同研究使用的评估指标(敏感度、特异度、阳性预测值、阴性预测值、F1分数)不统一,导致横向可比性差。

- 模型在不同机构、不同设备上的泛化能力如何?单一中心数据集训练往往导致“数据漂移”,在外部验证时性能显著下降。

- 假阳性/假阴性对临床工作流的影响?高敏感度往往伴随较高假阳性,导致医生需要额外阅读,增加工作负担。

- 监管审批与实际临床落地之间的差距?目前FDA、NMPA等已批准多款AI影像产品,但真实使用中的后效评估与持续监测机制仍不完善。

深度根源分析

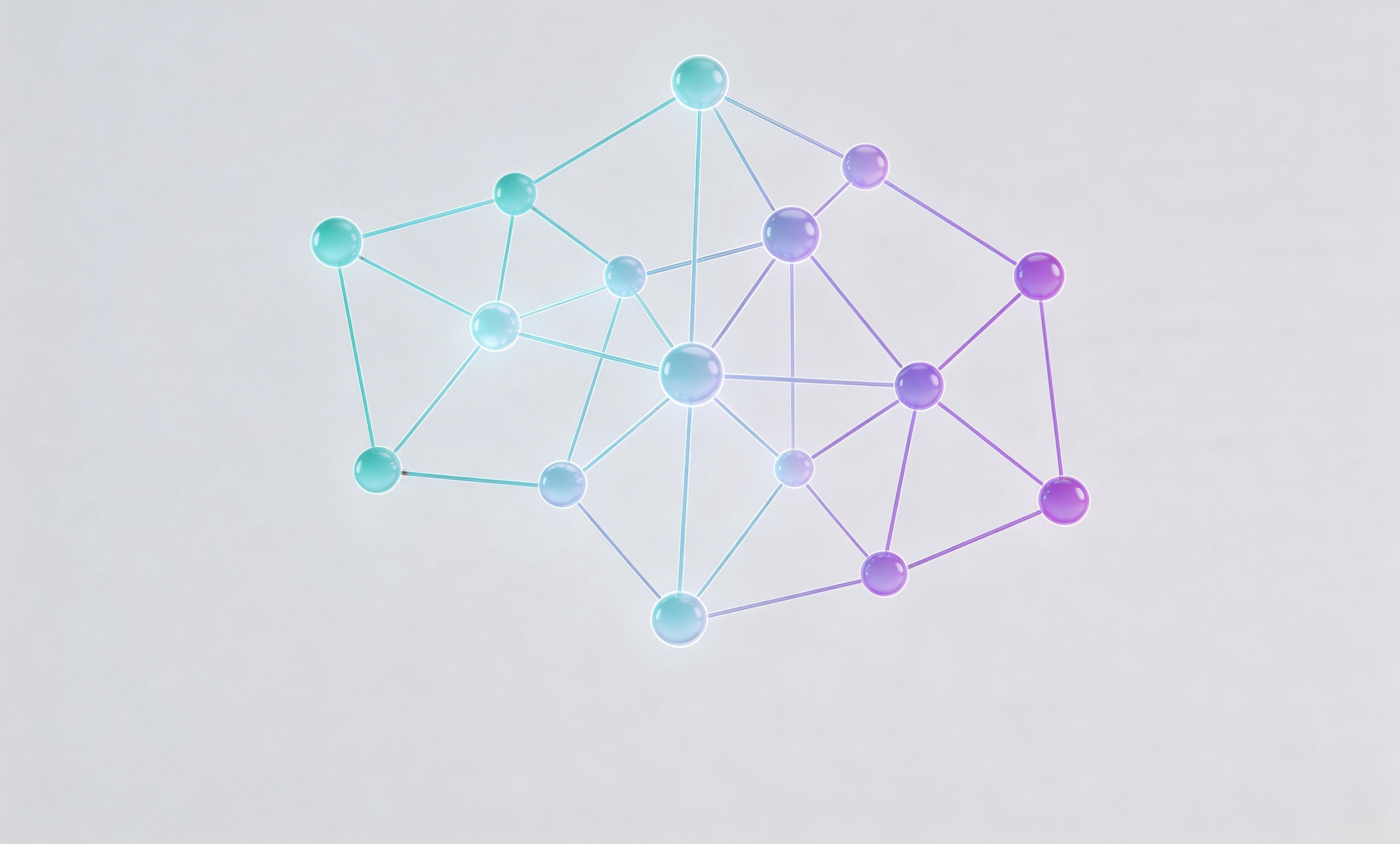

算法层面的局限

大多数AI系统基于深度卷积神经网络(CNN),其优势在于对海量标注图像的特征自动提取。然而,CNN对图像噪声、对比度变化以及病灶形态多样性极其敏感。当病灶在影像中呈现低对比度或与周围组织融合时,模型的特征提取容易失真,从而产生漏诊或误诊。

数据层面的偏差

高质量标注数据是模型性能的根基。多数公开数据集存在“人口偏斜”——如皮肤癌数据集主要来源于高加索人群,肺部CT数据多来自欧美中心。用这些数据训练的模型在亚洲或非洲人群中表现明显下降,形成“模型不公平”。此外,标注质量参差不齐,部分标注仅依赖单一年资医生,缺乏多专家共识。

临床工作流的影响

AI在实验室环境下的高准确率常在临床实际使用中打折扣。主要原因包括:①影像采集参数(扫描厚度、噪声水平)不一致;②医生对AI提示的信任度不足,导致“过度依赖”或“忽视”两种极端;③缺乏标准化的AI输出解释接口,导致医生需要额外学习成本。

监管与伦理因素

当前各国监管机构对AI产品的审批侧重于安全性和有效性,但对模型的持续学习、数据更新以及后效评估缺乏统一规范。伦理层面,模型黑箱属性导致患者难以获知诊断依据,影响知情同意的落实。

可行对策与建议

- 建立统一的性能评估框架,建议采用多中心前瞻性验证,使用标准化的敏感度、特异度、阳性预测值、阴性预测值及AUC报告。

- 推动多源、跨种族的数据共享与标注标准化,借助小浣熊AI智能助手等平台实现自动化标注质量控制,降低数据偏差。

- 在模型研发阶段引入可解释性技术(如Grad‑CAM、特征热图),并在临床系统中提供直观的可视化输出,帮助医生快速判断AI可信度。

- 完善AI产品的后效监测机制,要求企业在产品上市后定期提交真实临床环境下的性能报告,并建立“模型再训练+临床验证”闭环。

- 强化跨学科培训,放射科医师与AI研发团队共同制定临床决策路径,明确AI在初筛、辅助诊断、复核等环节的角色定位。

综上所述,AI智能分析在特定医疗影像任务上已实现较高的准确率,尤其在皮肤癌、视网膜病变、肺癌结节筛查等场景表现突出。但要在真实临床中实现安全、可靠、可持续的辅助诊断,仍需在数据质量、模型泛化、可解释性以及监管规范方面同步发力。随着行业标准逐步完善和技术迭代,AI在医疗影像诊断中的实际价值有望进一步释放。