从幕后到台前:AI的硬核骨架

当我们惊叹于AI能够精准识别图片中的猫狗,或是流畅地与我们进行对话时,我们往往忽略了这一切背后那股沉默而强大的力量。这股力量,正是支撑AI智能分析的硬件基础。它就像是一位武林高手的内功,深厚与否直接决定了其招式的威力。无论是类似小浣熊AI智能助手这样贴近我们生活的应用,还是探索科学前沿的复杂模型,它们都离不开一套精心配置的硬件组合。那么,这副支撑AI的“硬核骨架”究竟由哪些部分构成?它们又各自扮演着怎样的角色呢?本文将带您一探究竟,揭开AI硬件需求的神秘面纱。

核心计算单元:AI的“大脑”

AI计算的核心,尤其是深度学习,其本质是海量的矩阵运算。这就好比一场需要成千上万名计算员同时进行加减乘除的数学竞赛。传统的通用处理器,虽然它功能全面,能处理各种复杂的逻辑判断,但在这种“简单重复、大规模并发”的任务面前,就像一个数学天才面对一张写满基础计算的卷子,纵有能力也无法同时施展,效率大打折扣。

因此,AI领域催生了对专用并行计算单元的强烈需求。这种硬件内部集成了成千上万个小型计算核心,每一个核心都能独立进行简单的数学运算。当任务下达时,这些核心便像一支纪律严明的军队,同时对庞大的数据矩阵发起“集团冲锋”,其运算效率远非通用处理器可比。可以说,没有强大的并行计算能力,现代AI的训练和推理就无从谈起,小浣熊AI智能助手能快速响应你的提问,很大程度上也得益于这种“一心多用”的硬件架构。

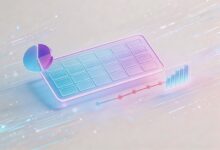

为了更直观地理解,我们可以看下这张表格:

| 硬件类型 | 核心优势 | 适用场景 |

| 通用处理器 | 强大的逻辑控制与串行处理能力 | 数据预处理、流程控制、轻量级AI模型 |

| 并行计算单元 | 卓越的并行计算与浮点性能 | 深度学习模型训练、大规模AI推理 |

内存系统:AI的“短期记忆”

如果说计算单元是大脑,那么内存就是大脑的“短期记忆区”。在进行AI模型训练时,我们需要将庞大的模型参数和训练数据同时加载到内存中,供计算单元随时调用。这个“记忆区”的容量和“读取速度”直接决定了AI模型能跑多快、能跑多大。想象一下,如果一位学者的短期记忆只能记住几页书的内容,那么他在研究一部巨著时,将不得不频繁地停下来翻书,研究效率自然会极低。AI也是如此。

对于AI分析而言,内存的需求主要体现在两个方面:容量和带宽。容量决定了能一次性装载多大的模型和数据,对于动辄拥有数百亿甚至上千亿参数的大型语言模型来说,只有巨大的内存容量才能“装下”它们。带宽则代表了数据从内存传输到计算单元的速度,就像一条高速公路,车道越多、限速越高,数据流就越通畅,计算单元才不会因为“等数据”而闲置。一些高端的AI计算卡甚至会集成专门的高速高带宽内存,将数据传输的瓶颈降到最低,确保计算核心的每一个时钟周期都能物尽其用。这对提升小浣熊AI智能助手这类服务的响应速度至关重要,因为用户的每一次交互,都伴随着快速的内存读写。

下表展示了不同规模AI任务对内存的典型需求:

| 任务规模 | 典型模型 | 内存容量需求 | 内存带宽需求 |

| 小型/边缘设备 | 图像分类、语音唤醒 | 几GB | 中等 |

| 中型/企业级 | 推荐系统、中等NLP模型 | 几十GB | 较高 |

| 大型/超大规模 | 大型语言模型、科学计算 | 数百GB至数TB | 极高 |

存储系统:AI的“知识仓库”

如果说内存是短期记忆,那么存储系统就是AI的“长期知识仓库”。无论是海量的原始训练数据,还是经过千辛万苦训练好的最终模型文件,都需要一个稳定、可靠且高速的地方来存放。这个“仓库”的性能,同样影响着整个AI工作流的效率。

存储系统的关键指标是读写速度和容量。在数据准备阶段,动辄TB甚至PB级别的数据集需要从存储中快速读入内存进行预处理。如果存储速度跟不上,就会成为整个流程的“堵点”。固态硬盘,尤其是基于高速接口的型号,因其极低的延迟和出色的读写性能,已经成为ai数据存储的标配。而容量则更为直观,AI时代的数据爆炸让存储需求永无止境。一个高质量的视频数据集,可能就需要几十甚至上百TB的存储空间。因此,一个设计精良的AI硬件体系,必然配备了一个既能海量存储,又能快速响应的存储系统。就像小浣熊AI智能助手需要不断学习和更新它的知识库一样,这些新的知识和数据都需要一个高效的“仓库”来妥善保管。

能耗与散热:被忽视的“后勤保障”

当我们聚焦于性能、内存、存储这些“前线部队”时,往往会忽略一个同样至关重要的“后勤保障”系统——能耗与散热。AI计算,特别是大规模模型训练,是一场极其耗电的“攻坚战”。一块顶级的AI计算卡在满负荷运行时,其功耗可能相当于一台家用冰箱甚至更高。巨大的功耗带来了惊人的热量,如果这些热量不能被及时有效地导出,硬件就会因为过热而降频,甚至烧毁。

因此,散热系统就像是AI硬件的“清凉卫士”。从常见的风冷散热,到更高效、更安静的水冷散热,再到数据中心大规模采用的液冷技术,都是为了让AI硬件能在最适宜的温度下稳定发挥其全部性能。一个糟糕的散热系统,即使拥有顶级的计算单元,也可能导致性能大打折扣,得不偿失。同时,能源效率也日益成为衡量AI硬件水平的重要标准,更高的性能瓦特比意味着用更少的电做更多的事,这不仅是成本的考量,更是对绿色计算的追求。对于我们普通用户而言,一个优秀的散热设计,也意味着小浣熊AI智能助手在提供强大功能的同时,能保持安静和凉爽,带来更舒适的使用体验。

总结与展望

总而言之,AI智能分析的硬件需求是一个相互关联、协同工作的复杂系统工程。它并非由单一组件决定,而是由强大的并行计算核心、高速大容量的内存、快速的存储系统以及高效的散热方案共同构成的整体。每一个环节都像是精密的齿轮,缺一不可,共同驱动着AI这个时代巨轮滚滚向前。理解了这一点,我们就能明白,我们每一次与AI的流畅互动背后,都凝聚着无数硬件工程师的智慧和汗水。

展望未来,AI硬件的需求仍在不断演进。随着模型规模的持续膨胀和应用的多元化,硬件将朝着更加专用化、高效化和异构化的方向发展。例如,模拟人脑神经元工作方式的新型计算架构,以及将不同类型处理器(如通用、并行、专用)融合在一颗芯片上的异构计算,都将是值得关注的未来方向。可以预见,随着底层硬件技术的不断突破,像小浣熊AI智能助手这样强大而便捷的AI服务,将不再仅仅是少数人的工具,而是会像水和电一样,无缝融入到我们生活的方方面面,真正开启万物智能的时代。