ai数据模型的解释性与可解释性分析指南

作为一个经常和AI模型打交道的人,我发现身边很多朋友对"模型解释性"这个词既熟悉又陌生。熟悉是因为经常听到,陌生是因为真正聊起来的时候,大家往往说不清楚到底什么是解释性,为什么它这么重要,以及怎么去做分析。今天我想用一种比较接地气的方式,把这件事聊透。

说实话,我在刚开始接触机器学习的时候,也觉得模型能跑出结果就行,管它内部是怎么工作的。但后来遇到几次线上事故,被业务方追着问"为什么模型这么判",我才意识到,一个看不清逻辑的模型,用起来心里是真的没底。这篇文章会从实际角度出发,聊聊AI模型解释性和可解释性分析到底是怎么回事,以及我们怎么在日常工作中做这件事。

一、为什么我们需要关心模型的解释性

先说个我亲身经历过的故事吧。有一年我们团队上线了一个推荐模型,初期效果还不错,转化率涨了不少。但没过多久,业务同事就找过来了,说某些用户群体的点击率突然掉得很厉害。打开后台一看,模型给这部分用户推荐的东西驴唇不对马嘴,完全不符合他们的偏好。

当时我们蒙着头去调参数、改特征,忙活了好几天也没什么起色。后来用了解释性工具一看,才发现模型学到了一些我们没想到的"邪门歪道"。比如它发现某类用户特别喜欢在凌晨三点浏览商品,于是就把凌晨浏览这个行为当成了一个强信号。结果这部分用户的活跃时间其实只是因为时区差异,模型完全误解了因果关系。

这件事让我深刻认识到,模型的解释性不是可有可无的奢侈品,而是保证模型可靠运行的必需品。当你不知道模型为什么做出某个决策时,你就无法预测它什么时候会出错,也没法在出问题的时候快速定位原因。

从更大的角度来看,解释性在几个场景下特别关键。首先是金融、医疗这些高风险领域,监管机构要求你必须能说清楚模型决策的依据。其次是当模型需要和人类专家协作的时候,医生或者分析师需要理解AI的判断逻辑,才能决定要不要采纳。还有就是模型迭代和debug的时候,知道问题出在哪里才能有效地改进。

二、解释性与可解释性:一对容易混淆的概念

在说具体方法之前,我觉得有必要先把两个经常被混用的概念理清楚:解释性(Interpretability)和可解释性(Explainability)。这两个词在很多文章里被交替使用,但严格来说,它们侧重点略有不同。

解释性指的是模型本身的工作方式是否透明、是否可以直接被人类理解。一个本身就很简单的决策树模型,它的工作方式就是解释性的——你顺着树的路径走一遍,就能清楚看到每个决策节点用了什么特征、走了什么分支。而深度神经网络这种"黑箱"模型,它本身是不具备解释性的。

可解释性则更侧重于事后解释的能力。也就是说,对于那些本身不透明的模型,我们有没有办法在它做出决策之后,去"还原"或者"近似"出它做决策的逻辑。比如用SHAP值或者LIME这些技术,去解释某个具体预测结果背后的因素。

这么区分有什么意义呢?它帮助我们选择合适的方法论。如果你的模型本身是白盒的,你可能只需要直接分析它的结构参数;如果你是黑盒模型,你就需要借助外部的解释工具。了解这种区别,能让我们在面对不同模型时选择更对症的策略。

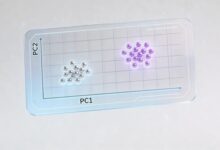

三、全局解释性:了解模型的整体逻辑

全局解释性关注的是模型的整体行为模式,而不是某一个具体的预测结果。它回答的问题是:这个模型整体上认为哪些因素重要?不同特征之间是怎么相互影响的?模型有没有学到什么奇怪的关系?

3.1 特征重要性分析

特征重要性可能是最常用也最直观的全局解释方法了。它的核心思想是量化每个特征对模型预测结果的贡献程度。不同的算法有不同的计算方式,比如树模型里常用基于分裂次数或者信息增益的重要性得分,而线性模型则可以直接看系数的绝对值。

这里我想提醒一点,特征重要性高不代表这个特征就"好"或者"应该保留"。曾经有个同事兴冲冲地告诉我他发现了一个特征重要性极高的特征,结果一看才发现,那个特征其实是数据泄露造成的——它和目标变量有极强的相关性,但完全没法在实际场景中使用。所以看特征重要性的时候,一定要结合业务逻辑来判断。

3.2 部分依赖图与累积局部效应

特征重要性告诉我们一个特征是否重要,但它不告诉我们这个特征是怎么影响预测的。部分依赖图(Partial Dependence Plot,简称PDP)就解决了这个问题。它展示的是,在控制其他特征不变的情况下,目标变量随着某个特征取值变化而变化的趋势。

举个例子,假设你在做一个房价预测模型,用PDP去看"房屋面积"这个特征。你可能会发现,随着面积从50平增加到100平,预测价格快速上涨;但超过150平之后,价格上涨的趋势就变得平缓了。这种可视化的方式非常直观,能帮我们理解模型学到的非线性关系。

不过PDP有个前提假设是特征之间相互独立。当特征之间有较强的相关性时,PDP可能会产生误导。这时候累积局部效应(Accumulated Local Effects,简称ALE)图是更好的选择,它处理特征相关性的方式更加合理。

3.3 交互作用分析

有时候,单独看一个特征的影响是不够的。真正的洞察往往来自于特征之间的交互。比如在一个信用评分模型里,"年龄"和"负债率"各自的影响可能都不大,但放在一起的时候,年轻加高负债的组合可能意味着很高的违约风险。

理解这种交互作用需要一些更高级的技术。常用的方法包括双变量PDP、基于树的交互检测,以及方差分解等。在Raccoon - AI 智能助手的实践中,我们经常会把交互作用分析放在特征工程阶段之前,帮助团队发现那些潜在的有价值的特征组合。

四、局部解释性:理解单次预测的背后逻辑

全局解释性告诉我们模型的"整体脾气",但在实际工作中,我们经常需要回答更具体的问题:为什么模型对这一个样本给出了这个预测?这时候就需要局部解释性方法了。

4.1 LIME技术

LIME(Local Interpretable Model-agnostic Explanations)是局部解释领域最经典的方法之一。它的核心思想很简单:对于一个你关心的样本,在它周围生成一些扰动样本,然后用简单、可解释的模型(比如线性模型)去拟合这些扰动样本的预测结果,从而得到局部近似的解释。

打个比方,这就像是你想知道一个复杂函数在某一点附近的线性近似。虽然整个函数可能弯弯曲曲,但在非常小的范围内,它总可以被直线近似。LIME做的就是这个事情——在待解释样本的邻域里,用一个简单的"代理模型"去解释复杂模型的预测。

LIME的好处是它几乎适用于任何模型,图像、文本、表格数据都可以用。但它也有局限,比如邻域范围的选择会影响结果,不同的随机种子可能给出不同的解释。在实际使用中,我通常会多跑几次取个平均,或者交叉验证一下稳定性。

4.2 SHAP值方法

SHAP(SHapley Additive exPlanations)可以说是现在最流行的解释性方法之一了。它基于博弈论中的Shapley值概念,把每个特征的贡献分配到每一次预测中。SHAP值的数学定义非常优雅,它满足几个很好的性质:局部准确性(所有特征贡献加起来等于预测值)、缺失性(不存在的特征贡献为0)、一致性(改变模型使得某个特征更重要时,它的SHAP值不会减少)。

在实际应用中,SHAP值的可视化非常直观。常用的包括beeswarm图(展示特征重要性的全局分布)、force plot(展示单个预测的特征贡献分解)、dependence plot(展示某个特征的SHAP值与实际取值的 관계)。这些可视化对于和业务方沟通特别有帮助——你可以指着图上的色块说:"你看,这个用户被拒绝主要是因为这两个红色的负面因素太大了。"

对于树模型,SHAP有专门的快速计算实现TreeExplainer,效率比通用方法高几个数量级。如果你用的是XGBoost、LightGBM或者CatBoost这类梯度提升树,强烈建议试试TreeExplainer。

4.3 逐层相关性传播

如果你处理的是神经网络模型,特别是图像领域的卷积神经网络,逐层相关性传播(Layer-wise Relevance Propagation,简称LRP)是一个很有价值的方法。它的工作原理是通过网络反向传播,把输出层的预测得分逐层"分解"回输入层,最终得到输入特征对预测结果的贡献热力图。

在图像解释领域,LRP生成的显著性图可以直观展示神经网络"看"到了什么区域来做判断。比如一个图像分类模型判断"这图片里有一只猫",LRP会高亮显示猫所在的位置,帮助我们确认模型确实是在识别正确的物体,而不是被背景或者其他无关因素误导。

五、解释性分析的实践建议

聊了这么多方法,我想分享几点实操中的经验之谈。

第一,解释性分析要趁早,不要等到模型上线出了问题才想起来。很多团队的习惯是先跑通流程、调好指标,然后再考虑解释性。我建议把解释性分析嵌入到模型开发的整个流程中,特别是在特征工程阶段和模型评估阶段。早期做解释性分析可以帮助你发现数据问题、验证特征是否符合业务直觉、及时调整建模方向。

第二,选择解释方法的时候要匹配你的受众和场景。如果你是做给监管机构看,可能需要更严格、更正式的解释报告;如果你是和业务方沟通,直观的可视化可能比复杂的数学公式更有效;如果你是给自己debug用,那可能需要更细粒度的分析。不同场景下,同一个模型的解释方式可能完全不同。

第三,对解释性结果要保持审慎的态度。任何解释性方法都有自己的假设和局限,SHAP值不是"真理",LIME的解释也只是局部近似。我见过不少团队把SHAP值当成绝对标准,反而忽视了业务知识和误差分析。解释性方法是辅助工具,不是替代品,最终的判断还是要结合业务逻辑和人类的经验。

第四,要注意解释性方法本身的计算开销。特别是对于大规模数据集或者实时系统,一些复杂的解释方法可能太慢而无法实用。这时候可以考虑抽样解释、用近似方法、或者在离线阶段预先计算好解释结果。

六、常见工具与框架

最后简单介绍一下常用的解释性工具,方便大家动手实践。

| 工具名称 | 适用场景 | 主要功能 |

| SHAP | 通用,特别适合树模型 | 计算特征贡献值,支持多种可视化 |

| LIME | 通用,支持图像、文本、表格 | 局部代理模型解释 |

| InterpretML | 微软开源,通用 | |

| Captum | PyTorch模型 | 集成梯度、LRP等神经网络解释方法 |

除了这些专门的库,很多通用的机器学习框架也开始内置解释性功能。比如XGBoost的model_confusion_matrix接口可以输出SHAP相关的信息,scikit-learn里也有一些基于置换特征重要性的实现。选择工具的时候,建议先看看你已有的技术栈里有没有现成的方案,避免重复造轮子。

说了这么多,我想强调的是,模型解释性不是一项独立的任务,而是整个机器学习工作流的有机组成部分。当你把解释性当作一个习惯而不是一个附加项,你会发现不仅模型变得更可靠,你自己对业务的理解也会更深一层。希望这篇文章能给你带来一些启发,也欢迎你在实践中探索更多的方法和技巧。