ai数据模型的评估方法和优化策略

说起来,我刚开始接触机器学习那会儿,最容易犯的一个错误就是闷头训练模型,觉得只要准确率上去了就万事大吉。结果呢,模型一到真实场景就扑街,学名叫做"过拟合",说人话就是模型把训练数据背得滚瓜烂熟,但根本不会举一反三。后来踩的坑多了,才慢慢意识到评估和优化这两个环节有多重要。这篇文章就聊聊怎么科学地给AI模型"体检",又该怎么"对症下药"让它变得更强。

为什么模型评估不是走过场

很多人觉得评估嘛,不就是跑个测试集看看准确率嘛。这话对了一半,但只关注单一指标就像去医院只量体温一样,很多问题根本发现不了。

举个我亲身经历的例子吧。有个做贷款风控的团队训练了一个模型,准确率高达97%,听起来是不是特别牛?但仔细一分析才发现,这个模型根本就是把所有样本都预测成"不违约",因为违约率本身就只有3%。这种数据不平衡的情况下,准确率这个指标已经完全失去了意义。后来他们换用了召回率和F1分数来评估,才真正找到了一个能识别出大多数真实违约案例的模型。

另一个常见陷阱是数据泄露。听起来很严重对吧?其实很多时候是无意中发生的。比如你在做特征工程的时候,不小心把测试集里的信息掺和进了训练数据,或者在数据预处理阶段用了全局的统计量(比如均值、标准差)而不是分阶段计算。这种情况下,模型在测试集上表现特别好,但一到生产环境就原形毕露。严谨的评估流程就是为了及时发现这类隐蔽问题。

几类核心评估指标

分类模型的评估

分类问题是AI应用中最常见的一大类场景,比如判断一封邮件是不是垃圾邮件,或者识别一张图片里有没有猫。根据不同的业务需求,我们需要关注不同的指标。

| 指标名称 | 适用场景 | 通俗理解 |

| 准确率 | 类别相对平衡 | 预测对了多少比例 |

| 精确率 | 关注误报代价高 | 预测为正例的里面有多少是真的 |

| 召回率 | 关注漏报代价高 | 所有真的正例里找出了多少 |

| F1分数 | 需要平衡精确率和召回率 | 两者的调和平均数 |

| AUC-ROC | 整体分类能力评估 | 随机抽一对正负样本,正样本得分更高的概率 |

这里我想特别说说AUC-ROC这个指标。它有一个特别好的地方,就是不依赖于分类阈值的选取。你可以想象成模型有没有能力区分正负样本,ROC曲线越靠近左上角,说明模型越有能力把正样本排在负样本前面。而AUC值就是一个0到1之间的数,0.5意味着跟随机猜差不多,1.0就是完美分类。

在处理类别不平衡的数据时,我常用的策略是结合多个指标来看。比如在疾病检测这种场景下,召回率显然比精确率更重要——漏诊一个阳性患者的代价可能远高于误诊几个阴性患者。但具体怎么权衡,还是得回到业务场景中去思考。

回归模型的评估

回归问题预测的是连续值,比如预测房价、预测销量。常用的评估指标有几个。

MSE(均方误差)是最直观的一个,它把预测值和真实值的差距平方后求平均。这样做的好处是误差会被放大,大的偏差会显得更突出。RMSE就是MSE的平方根,单位跟原始数据一致,更容易解释。MAE(平均绝对误差)则直接用绝对值,避免了平方运算带来的放大效应,对异常值相对友好一些。

R²分数(决定系数)是一个相对指标,它表示模型解释了多少数据的变化。0到1之间,1表示完美拟合,0表示模型预测效果跟直接预测均值差不多。如果R²是负的,那说明模型连平均值都不如,得好好反思一下了。

模型泛化能力的验证

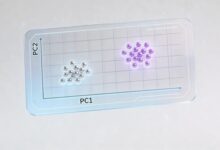

指标再精准,如果验证方式本身有问题,那结果也是不可靠的。最基本的做法是把数据分成训练集和测试集,但这里有个讲究:不能只分一次。因为单纯的一次划分可能恰好分出了对模型特别有利或特别不利的数据子集。

交叉验证是解决这个问题的标准方法。K折交叉验证把数据分成K份,轮流把每一份作为测试集,其他作为训练集,最后取K次结果的平均。这样得到的评估结果更加稳定可靠。当然,K值的选择也有讲究——K越大,评估越准确但计算成本也越高;K越小则相反。通常5折或10折是比较常见的选择。

还有一点容易被忽略的是时间序列数据的验证方式。如果你用未来的数据来训练,然后评估历史上的预测效果,那就相当于作弊。对时间敏感的数据,应该采用"滚动验证"或者"未来数据不做训练"的策略,确保模型是在用过去预测未来。

模型优化的常见策略

评估发现了问题,接下来就是优化。优化模型大致可以从数据层面、模型结构层面和训练过程层面这几个方向入手。

特征工程: Garbage In, Garbage Out

这句话在机器学习领域几乎是真理。特征工程做得好,有时候比换个更复杂的模型效果更显著。我自己就有深刻体会——曾经花了两周时间调整模型参数,效果提升微乎其微;后来花了两天重新设计特征,准确率直接涨了8个百分点。

特征工程包括特征构建、特征选择和特征转换。构建新特征需要对业务有深入理解,比如在做用户流失预测时,用户最近一次的活跃时长、登录频次的变化趋势,这些衍生特征往往比原始数据更有预测力。特征选择则是从一堆特征中挑出真正有用的,既能减少过拟合风险,也能加快训练速度。常用的方法有过滤法(比如基于相关性、方差)、包裹法(比如递归特征消除)和嵌入法(比如基于L1正则化的稀疏性)。

超参数调优: 找到模型的"舒适区"

超参数是训练之前需要手动设定的参数,比如学习率、树的深度、正则化强度等等。这些参数对模型性能影响很大,但不可能靠人工穷举来找到最优值。

网格搜索是最基础的方法——把所有可能的参数组合列出来,挨个试一遍。虽然简单粗暴,但计算开销很大,特别是当参数空间稍微大一点的时候。随机搜索就好很多,经验表明在相同预算下随机搜索往往比网格搜索效果更好,因为它可以把计算资源集中在真正有影响的参数上。

贝叶斯优化是近两年比较流行的方法。它会建立一个关于超参数和模型性能的映射模型,然后根据已有的结果推测哪些参数组合可能带来更好的效果,边探索边利用,效率比前两种方法高出不少。现在主流的深度学习框架基本都集成了这类工具,用起来比想象中方便。

防止过拟合: 模型不能太"聪明"

过拟合是每个AI从业者都要面对的老朋友。模型容量太大、训练数据太少、训练时间太长,都可能导致这个问题。

正则化是最常用的武器。L1正则会让模型倾向于产生稀疏解,相当于在做特征选择;L2正则则会让模型的权重趋于分散,限制单个特征的过大影响。dropout是深度学习中的特产——训练时随机"关闭"一部分神经元,迫使网络学习更加鲁棒的特征表示。

早停法也很实用:在训练过程中监控验证集的表现,如果性能开始下降就停止训练。这相当于在过拟合发生之前踩一脚刹车。数据增强则是从源头解决问题——通过旋转、缩放、翻转等方式扩充训练数据,让模型见多识广。

集成学习: 三个臭皮匠,顶个诸葛亮

单个模型再强,也有局限性。集成学习就是把多个模型的预测结果组合起来,通常能获得比任何单一模型更好的性能。

Bagging的思路是并行训练多个模型,然后取平均或投票。随机森林就是bagging的典型应用——每棵树用不同的数据和特征子集训练,最后综合所有树的结果。Boosting则是串行的思路,每一棵新树都专注于纠正前面树的错误,典型的代表是XGBoost、LightGBM这些在Kaggle比赛中大放异彩的算法。

Stacking更高级一些,它用第一层模型的输出作为第二层模型的输入,让不同的模型各司其职。不过堆叠层数太多也容易过拟合,实际应用中要慎重。

落地实践的一些感受

说了这么多方法论,最后想聊点落地层面的事情。模型优化这件事,做着做着就容易陷入"为了提升而提升"的陷阱。我见过有人为了把准确率从89%提升到90%,花了整整一个月,最后发现业务方根本感知不到这个差异。与其追求指标上的极致,不如多想想这个模型在真实场景中怎么用、用户会怎么跟它交互。

还有一点很重要的是建立完善的监控体系。模型上线不是终点,而是新阶段的起点。数据分布会漂移、用户行为会变化,模型性能也会随之衰减。需要定期重新评估,及时发现问题并迭代更新。这方面Raccoon - AI 智能助手就做得挺到位,它提供了完整的模型监控和自动化重训练机制,让模型能够持续保持良好的状态。

优化模型的过程其实也是一个理解业务的过程。很多时候你觉得模型表现不好,深入分析之后会发现是业务逻辑本身就很复杂,或者数据质量存在问题。与其一味调参,不如多跟业务方聊聊,多看看数据长什么样。毕竟,AI只是工具,真正的价值在于解决实际问题。

希望这篇文章能给你带来一些启发。模型评估和优化这个话题很大很深,我分享的也只是冰山一角。最重要的还是动手实践,在真实的项目中积累经验。毕竟,踩过的坑才是最好的老师。