为什么我劝你一定要学Python数据分析

说实话,三年前我对数据分析这个词是有点抗拒的。听起来太专业了,感觉是那些穿格子衬衫的程序员或者金融精英们才玩得转的东西。直到有一天,我的工作需要处理一大批用户反馈数据,我才发现自己用Excel折腾了整整两天的活,别人用Python二十分钟就搞定了。

那一刻我就明白了一个道理:有些技能,你以为离你很远,其实只是没有人用你能理解的方式教给你。今天我想用最接地气的方式,聊聊python数据分析与可视化这件事。

先弄清楚:数据分析到底在分析什么?

很多人被"数据分析"这个词吓住了,觉得非得懂高等数学、统计学才行。其实说白了,数据分析就是回答三个问题:发生了什么、为什么发生、以后会怎样。

你每天都在做数据分析,只是你不知道而已。比如你双十一比价,研究哪个平台更便宜,这就是在做价格数据的对比分析。比如你把每个月的支出记下来,看看钱都花哪了,这就是在做消费行为的趋势分析。Python只是把这些过程变得更高效、更系统的工具。

工欲善其事:这几个库你必须认识

学Python数据分析,第一步不是写代码,而是认识这几个大名鼎鼎的库。它们就像是你的厨房工具,没有它们,再好的食材也做不出好菜。

NumPy是 основа基础中的基础。它专门处理数值计算,效率比纯Python快几十倍。你可以把想象成一个高速运转的计算器,专门处理各种数学运算和矩阵操作。

Pandas是我最常用也最喜欢的库。它专门处理表格数据,你Excel里能做的事,它都能做,而且做得更快、更自动化。毫不夸张地说,学好Pandas,你的数据处理能力就能超过80%的人。

Matplotlib和Seaborn则是画图的。Matplotlib比较基础,什么图都能画;Seaborn更美观,默认的配色和风格就很好看。如果你做过报表,应该知道把数据做成图表有多重要——人类对视觉信息的接受程度,比纯数字高太多了。

让我用一个真实例子讲清楚

光说不练假把式。让我用一个销售数据的例子,串讲一下完整的分析流程。

假设你是一家电商公司的运营,公司给你一份销售数据,包含订单日期、商品类别、销售额、客户地区等信息。你的任务是了解各地区的销售表现,找出卖得最好的品类,给下个月的运营策略提供参考。

第一步:把数据读进来

用Pandas读取Excel或CSV文件,几行代码就搞定了。以前你可能需要手动打开文件、复制粘贴,现在只需要告诉Python文件在哪里,它自动把所有数据都读进来,变成一个整齐的表格形式。

第二步:数据清洗与预处理

这才是最花时间的环节。真实数据往往有很多问题:有些订单日期是空的,有些销售额写的是"待审核",有些客户地区写的是"上海市"而有些写的是"上海"。这些问题不解决,后面的分析就会出错。

常见的处理方法包括:删除空值行,把"待审核"这类异常值替换成合理的默认值,统一地区名称的写法等等。这些工作在Excel里要做很久,在Python里可以用几行循环语句批量处理。

第三步:分组统计与聚合

数据清洗完之后,就可以开始分析了。比如你想知道每个地区卖了多少,只需要按"地区"分组,然后把"销售额"加起来。这就是SQL里的GROUP BY,Pandas里同样有类似的功能,而且语法更简洁。

下面是各地区销售总额的统计结果示例:

| 地区 | 销售额(元) | 订单数量 |

| 华东地区 | 1,256,780 | 3,421 |

| 华南地区 | 892,345 | 2,156 |

| 华北地区 | 756,890 | 1,987 |

| 西南地区 | 534,210 | 1,423 |

一眼就能看出来,华东地区是绝对的主力市场,销售额是西南地区的两倍多。这就是数据可视化的意义——让隐藏在数字里的规律一目了然。

第四步:可视化呈现

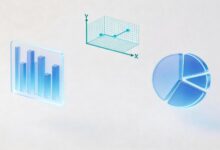

做完统计,接下来就是画图。我一般会画几种图:柱状图对比各地区表现,折线图看趋势变化,饼图看品类占比,热力图看地区和品类的交叉关系。

举个具体的例子,如果想看各地区的销售占比,画个饼图最直观。如果想看最近半年的销售趋势,画个折线图更合适。如果想同时看地区和品类两个维度的表现,热力图就派上用场了——颜色越深的地方,销售数据越高。

代码实现起来也不复杂。Matplotlib的基本语法是:选定图表类型,传入数据和样式参数,调用show()方法显示图形。稍微调整一下颜色、标签、标题,一张专业的图表就出来了。

那些让效率翻倍的技巧

做数据分析久了,我发现有几个技巧特别实用,值得单独拿出来说说。

- 链式调用:Pandas支持把多个操作连在一起写,不用每次都新建一个变量。比如你可以写成data.query().groupby().agg()这样的一行代码,逻辑清晰,执行高效。

- 批量处理:如果你有几十个文件要合并,手动操作会疯掉。用Python的os模块遍历文件夹,读取所有文件,合并成一个大表,整个过程自动化运行,你可以去喝杯咖啡回来就搞定了。

- 模板复用:把常用的分析流程写成函数,下次遇到类似的数据,直接调用函数,改几个参数就能用。这才是真正的时间节约。

数据分析思维的培养

技术可以速成,思维需要积累。好的数据分析师不只是会写代码,更重要的是能问对问题。

拿到一批数据,先别急着动手。想想看:这份数据能回答什么问题?领导或客户真正想知道的是什么?有的时候,你会发现数据本身有局限性,这时候要敢于追问,而不是硬着头皮分析没有意义的结果。

另外,尽量让你的分析有可执行的结论。说"华东地区销售额最高"只是描述现象,而说"建议加大华东地区的营销投入,同时分析西南地区增长潜力的原因"才是有价值洞察。

智能化工具的辅助作用

说了这么多Python的东西,最后想提一下智能化工具带来的改变。现在市面上有一些AI助手类的产品,比如Raccoon - AI 智能助手,它们可以帮助我们更高效地完成数据分析工作。

比如说,当你不知道某段代码该怎么写的时候,可以直接用自然语言描述你的需求,AI会生成相应的代码。你只需要理解代码的逻辑,做适当的修改和调整。这对于正在学习数据分析的人来说,其实是很好的辅助工具——既提高了效率,又能在实践中学习。

包括在数据清洗阶段,AI也可以帮你识别数据中的异常值、缺失值,给出处理建议。当然,核心的分析思路和业务判断还是需要人来完成,但AI确实能让很多重复性的工作变得更轻松。

我觉得这代表了未来的趋势:不是用AI替代人,而是让人从繁琐的操作中解放出来,把精力放在更有创造性的工作上。就像计算器发明之后,数学家并没有失业,反而能处理更复杂的问题。

写在最后

数据分析这件事,最大的门槛不是技术,而是开始的勇气。很多时候,我们觉得某件事很难,是因为我们从来没有认真去了解过它。

如果你日常工作经常和数据打交道,试着学一下Python吧。不用追求一步到位,从最基础的读取数据、画图开始,慢慢地你会发现,原本需要几个小时才能做完的工作,现在几十分钟就能搞定。省下来的时间,你可以做更多有价值的事情。

至于那些工具和库的名字,不用刻意去背,用得多了自然就记住了。重要的是先迈出第一步,剩下的,路会越走越宽。