ai数据模型如何进行模型的性能测试和优化

说起AI模型的性能测试和优化,这事儿其实没有想象中那么玄乎。我刚开始接触这块的时候,也是头大得很,觉得那些指标啊、参数啊、看不懂的术语啊,简直能让人劝退。但真正做进去之后发现,这就是一个"发现问题-解决问题"的循环过程,只是我们需要一套系统的方法论来指导这个循环。今天我就把这些年踩坑总结出来的经验,分享给大家,希望能给正在做AI模型优化的朋友一点参考。

在开始之前,我想先明确一个观点:性能优化不是玄学,它是可以通过科学的方法论来指导实践的。很多时候我们觉得调参像在摸彩票,其实是因为没有建立起系统的测试和评估框架。一旦框架搭起来了,优化工作就会变得有章可循。

一、性能测试到底测的是什么

很多人一提到性能测试,第一反应就是"跑个分看看",但AI模型的性能测试远比这复杂得多。简单来说,我们需要关注三个层面的指标:模型本身的性能、系统运行的效率、以及在实际场景中的表现。

模型层面的指标包括准确率、精确率、召回率、F1分数这些大家比较熟悉的。但仅仅这些是不够的,我们还需要关注推理延迟——模型处理一个请求需要多长时间;吞吐量——单位时间内能处理多少请求;还有资源占用情况,CPU、GPU、内存的使用率都是关键指标。

这里我想强调一个容易被人忽视的点:不同场景下,这些指标的优先级是不一样的。比如在实时对话系统中,延迟可能就是最关键的指标,牺牲一点准确率来换取更快的响应往往是值得的。而在医疗诊断辅助场景中,准确率可能就是第一位的,延迟稍微高一点也能接受。所以在开始测试之前,一定要想清楚你的业务场景到底看重什么。

二、建立科学的测试框架

说完了测什么,接下来聊聊怎么测。一个好的测试框架应该具备几个特点:可重复性、可对比性、覆盖面广。

首先说可重复性。同一个模型在同样的环境下测试,结果应该是一致的。这就需要我们严格控制测试环境,包括硬件配置、软件版本、数据集划分等。我见过很多团队测试结果忽高忽低,后来发现是环境没统一导致的。所以建议大家在做性能测试之前,先把环境配置文档化,甚至用Docker之类的容器技术来保证环境一致性。

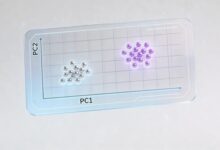

然后是可对比性。我们做优化的时候,需要知道这次改动的效果是变好了还是变差了,这就要求我们能够进行前后对比。最好的做法是建立基准测试集,每次改动都在这个基准集上跑一遍,把结果记录下来。可以用表格来追踪不同版本的表现:

| 测试版本 | 准确率 | 推理延迟(ms) | 吞吐量(req/s) | GPU占用 |

| V1.0 (基准版) | 92.3% | 45 | 1200 | 65% |

| V1.1 (优化后) | 92.1% | 32 | 1580 | 58% |

| V1.2 (再优化) | 91.8% | 28 | 1850 | 52% |

从这个表格可以清晰看到,每次优化带来了什么样的变化。有意思的是,V1.2的准确率略有下降,但延迟和吞吐量的提升是很明显的。这时候就要权衡业务取舍了。

至于覆盖面,我建议从几个维度去考虑:不同数据类型的测试集、不同输入长度的测试、边界条件的测试、并发压力测试等等。很多问题只有在特定条件下才会暴露出来,所以我们要把各种边界情况都考虑到。

三、性能优化的几个常用策略

讲完了测试,接下来聊聊优化。优化策略可以从模型层面、推理引擎层面、系统架构层面来考虑。

模型层面的优化

模型层面的优化最常见的就是模型压缩技术。这里包括剪枝、量化、知识蒸馏等方法。剪枝就是去掉模型中不重要的连接或神经元;量化是把浮点模型转换成定点模型,比如从32位降到8位;知识蒸馏则是用大模型来指导小模型学习,让小模型能接近大模型的效果。

具体选择哪种方法,要看你的实际情况。如果你的模型是在端侧设备上运行,量化可能是最直接有效的手段。如果你需要保持模型精度,同时减少计算量,知识蒸馏可能更适合。我个人的经验是,量化通常能带来2-4倍的推理加速,精度损失在1-3个点之间,是性价比很高的优化手段。

推理引擎层面的优化

除了改模型,我们还可以通过优化推理引擎来提升性能。现在主流的推理框架都做了很多优化工作,比如算子融合、内存优化、并行计算等。以算子融合为例,神经网络中有大量的逐元素操作和归一化操作,如果这些操作分开执行,会导致大量的内存读写开销。把它们融合成一个算子,就能减少很多不必要的内存访问。

选择推理框架的时候,也要根据自己的场景来定。如果是TensorFlow模型,TensorRT可能是更好的选择;PyTorch模型可以考虑TorchScript或者ONNX Runtime。如果你的模型需要在多种硬件上运行,ONNX格式可能是比较灵活的选择。

系统架构层面的优化

再往上一层,就是系统架构的优化。这里面涉及到模型服务的部署方式、负载均衡策略、缓存策略等。比如,我们可以把模型加载到内存中常驻,避免每次请求都去加载模型;可以使用异步处理来提高并发能力;还可以根据请求的类型分发给不同的模型实例,实现更精细的资源利用。

这里我想特别提一下批处理优化。批处理的核心思想是,把多个请求合并在一起处理,这样可以利用GPU的并行计算能力,显著提升吞吐量。当然,批处理会带来延迟的增加,因为要等一批请求都到了才能开始处理。这就是一个经典的吞吐量和延迟的权衡问题,需要根据业务场景来调优批处理的大小。

四、实战中的那些坑

说了这么多理论,最后我想聊聊实战中容易踩的坑,这些都是我或者身边同事亲身经历过的血泪教训。

- 只关注指标,忽视真实场景:很多团队在测试集上取得了很好的指标,但一到真实环境就傻眼了。原因很可能是测试集和真实数据分布有差异。所以除了标准测试集,一定要用真实业务数据做一下验证。

- 优化的方向搞错了:我见过有人花了很大力气优化模型推理时间,结果发现瓶颈在数据预处理上。这就提醒我们,在优化之前一定要先做 profiling,找到真正的瓶颈在哪里,别在不重要的地方花冤枉时间。

- 忽视硬件特性:不同的硬件有不同的优化策略。比如NVIDIA的GPU对Tensor Core有很好的支持,如果模型架构能利用上Tensor Core,性能提升会非常明显。所以优化工作要结合具体硬件来做。

- 版本管理混乱:模型、代码、配置、测试脚本这些最好都有版本管理。很多团队优化着优化着,就忘了之前改了什么,回滚都困难。建议用Git来管理代码,用模型仓库来管理模型版本。

五、写在最后

回顾这些年的工作经历,我觉得AI模型的性能测试和优化工作,其实是一个不断迭代、持续改进的过程。没有一步到位的完美方案,只有不断发现问题、解决问题的循环。

重要的是建立起科学的测试体系,让每一次改动都有据可依。然后在实践中积累经验,对常见的性能问题形成直觉判断。这样当问题出现时,你能快速定位原因,找到合适的解决方案。

如果你正在做相关的优化工作,不妨先从建立基准测试开始,把现状搞清楚,然后再一步步推进优化。性能优化这件事,急不得,但只要方向对,坚持做下去,效果自然会显现出来。

希望这篇文章能给你带来一点启发。如果你也在做AI模型的性能优化工作,欢迎一起交流心得。在这个领域,永远有学不完的东西,也永远有值得探索的空间。