ai数据库的性能优化和索引设置方法

说实话,我第一次接触ai数据库的时候,完全是一头雾水。那时候我觉得数据库嘛,不就是存数据的地方,能有多复杂?但现实狠狠给了我一巴掌——同样的查询语句,在传统数据库里跑得飞快,到了AI数据库里却慢得像蜗牛。后来踩的坑多了,我才慢慢摸清这里面的门道。

如果你也正在为AI数据库的性能发愁,或者正打算搭建自己的AI系统,那这篇文章可能会对你有点帮助。我不会给你讲那些玄之又玄的理论,咱们就聊聊实际干活的时候到底该怎么办。文章里提到的这些方法,都是我在实际项目中一个个试错试出来的,有的东西甚至付出了惨痛的代价才学会。

为什么AI数据库的性能优化这么特殊?

你可能会想,数据库优化嘛,不就是加索引、调参数,这些套路我熟。但AI数据库和传统数据库真的很不一样。传统数据库处理的主要是结构化的、规规矩矩的数据,而AI数据库要面对的,往往是向量、高维数据,还有那些不太规整的文本、图像特征。

举个简单的例子。传统数据库里你要找"年龄大于30的用户",建个B树索引就行,简单直接。但AI数据库里你要找"和这张图片最相似的100张图片",这该怎么索引?总不能把每张图片的像素都存进索引里吧?这就是AI数据库面临的独特挑战。

另外,AI工作负载本身也有特点。训练阶段可能要反复读取大量数据,推理阶段又要保证低延迟。不同阶段的需求完全不一样,这就要求数据库既能扛住高吞吐的批量处理,又能应付毫秒级的实时查询。这种"既要又要"的需求,让AI数据库的优化变得格外复杂。

理解你的数据访问模式

在动手优化之前,我觉得最重要的事情是搞清楚你的数据到底是怎么被访问的。这事儿看起来简单,但很多人根本不去做,或者做得很粗糙。

你得问自己几个问题:首先,你的查询是主要以读为主还是写为主?其次,你是经常查询小范围的高精度数据,还是偶尔需要扫描大量数据?第三,你的AI模型是一次性查询多条记录,还是主要做单条记录的检索?

这些问题的答案会直接影响你的优化方向。比如,如果你的系统主要是读操作,而且经常做相似性搜索,那向量索引就是你首先要考虑的事情。但如果你的工作负载是大量的批量写入,那写性能的优化可能更紧迫。

我在一个项目里曾经吃过亏。一开始我们把所有数据都往向量数据库里塞,结果发现很多查询其实根本用不上向量检索,纯属浪费资源。后来我们把数据分开存储,该用关系数据库的用关系数据库,该用向量数据库的用向量数据库,整体性能提升了不止一倍。所以你看,了解数据访问模式是第一步,这步走错了,后面再努力也是白搭。

索引设置:AI数据库的核心技术

向量索引的那些门道

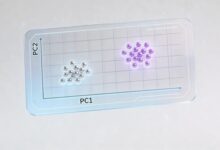

说到AI数据库的索引,不得不先聊聊向量索引。这东西和传统数据库的B树索引完全是两个世界的东西。你可能听说过IVF、HNSW、PQ这些名词,它们都是向量索引的常见类型,各有各的特点。

IVF索引的核心思想是先把向量空间分成若干个簇,查询的时候先找到相关的簇,再在簇里面细查。这种方式构建速度快,内存占用也相对合理,适合数据量大但对精度要求不是特别高的场景。HNSW呢,则是用图的结构来组织数据,查询速度更快,但内存占用也更大。如果你对延迟特别敏感,HNSW通常是更好的选择。

这里有个小经验分享给你。HNSW的参数设置对性能影响很大,尤其是efConstruction和M这两个参数。efConstruction控制的是建索引时的搜索广度,值越大索引质量越好,但建索引也越慢。M控制的是每个节点连接数,太大的话内存压力大,太小又影响查询精度。我的建议是,先用默认值跑起来,然后根据实际效果慢慢调,别一开始就追求完美。

还有一点很多人会忽略:向量归一化。很多相似性计算方法对向量的模长是敏感的,如果你的向量没有归一化,计算出来的相似度可能就不准。在建索引之前检查一下数据预处理流程,这一步看似简单,但能避免很多后续的麻烦。

传统索引也不是完全没用

可别以为AI数据库里向量索引是万能的,传统索引在很多场景下依然很有价值。比如你经常要根据某个字段做精确匹配,或者做范围查询,这时候B树索引依然是最优解。

在一个推荐系统的项目里,我们一开始完全依赖向量索引来做用户画像匹配。结果发现,很多查询其实带有明确的时间范围或者其他过滤条件,单纯的向量索引没法高效处理这些条件。后来我们把向量索引和传统索引结合起来用,先用传统索引过滤掉不符合条件的数据,再在结果集上做向量检索,效果就好了很多。

还有一种混合索引的方式也值得关注。有些数据库支持把向量和结构化数据放在一起建索引,这样你可以同时利用两者的优势。具体要不要用,怎么用,还是得回到最开始说的——搞清楚你的查询模式。

查询优化:让每一分资源都花在刀刃上

索引建好了,查询优化同样重要。很多时候,查询写得太烂,再好的索引也救不回来。这不是危言耸听,我见过太多因为一条烂查询把整个系统拖垮的例子。

首先是查询重写。你要学会识别那些低效的写法。比如,如果你要查询某个范围内的大部分数据,直接扫描可能比用索引更快。数据库的查询优化器不一定是万能的,它有时候也会做出错误的选择。这时候你可以试试强制使用索引,或者反过来,强制不使用索引,看看效果有没有变化。

其次是分页查询的优化。很多人在做分页的时候喜欢用limit offset的方式,这在数据量大的时候会有问题。因为数据库得先把所有数据读出来,然后跳过offset条,再返回后面的数据。更好的做法是记住上一页最后一条记录的位置,用"where id > last_id"这样的方式来分页,效率会高很多。

还有一点要提醒:尽量减少返回的数据量。很多人的查询习惯是把所有字段都查出来,哪怕根本用不上。你要是只需要几个字段,就只查这几个字段,数据库能少做很多工作。尤其是对于向量字段,动辄就是几百几千维,能不查就别查。

存储结构与内存管理

存储结构对性能的影响可能比你想象的要大。列式存储和行式存储怎么选?这事儿得看你主要是做什么操作。

如果你经常需要对某一列做聚合计算,比如求平均值、求和,那列式存储的优势就太大了。因为它把所有相同类型的数据放在一起,CPU缓存的利用率更高,压缩率也更好。但如果你经常需要一次性读取一整条记录的所有字段,那行式存储更适合你。

AI数据库的数据量通常不小,压缩是个大问题。好的压缩算法能省下大量存储空间和IO时间。常用的压缩算法包括Delta编码、Run-Length编码、LF编码等等。选择哪种压缩算法,要看你的数据特点。有些数据库支持自动选择压缩算法,有些则需要你手动配置。我的建议是,如果不确定,先让数据库自动选择,大部分情况下效果都还不错。

内存管理方面,最重要的原则是尽可能让热数据待在内存里。这听起来像是废话,但实际做起来有很多讲究。首先你要监控内存使用情况,知道哪些数据是热的。然后你可以配置数据库的缓存大小,或者手动把常用的数据提前加载到内存里。

有个技巧可能不是所有人都知道:很多数据库支持内存预分配。如果你知道大概会有多少数据,提前分配好内存能避免运行时的内存分配开销。当然,这需要对业务量有比较准确的预估。

并发与分布式:应对大规模数据

当数据量上升到一定规模,单机肯定扛不住了。这时候你就需要考虑并发和分布式的问题。

连接池是并发的基础。数据库连接是个很重的操作,每次新建连接都有开销。如果你的应用需要频繁和数据库交互,一定要用连接池。但连接池的大小也不是越大越好,太大了反而会增加数据库的压力,还可能导致连接被长时间占用。一般来说,连接池大小可以设为核心线程数的两到三倍,然后根据实际监控数据慢慢调整。

如果单机确实不够用,那就得分片了。分片就是把你的数据分散到多台机器上,每台机器只负责一部分数据。分片Key的选择非常关键,选不好的话会导致数据分布不均匀,某些机器成为瓶颈。常见的分片方式有哈希分片和范围分片,各有优缺点。哈希分片数据分布均匀,但不利于范围查询;范围分片对范围查询友好,但可能导致热点。

还有一种方案是读写分离。主库负责写操作,从库负责读操作。这样可以分散读请求的压力,但要注意主从同步会有延迟,如果业务对实时性要求很高,这种方案就不太适合。

监控与调优:持续优化的闭环

说了这么多优化方法,最后我想强调的是监控。没有监控,你根本不知道系统运行得怎么样,也不知道优化有没有效果。

首先你需要一个完善的监控系统,能够实时展示数据库的关键指标,包括CPU使用率、内存使用率、IO吞吐、查询延迟、连接数等等。这些指标要长期保存,这样你才能发现趋势性的问题。

然后是慢查询日志。这个一定要开,而且要定期分析。很多性能问题都是由几条烂查询引起的,把这些查询找出来优化掉,往往能带来巨大的提升。你可以用explain命令来分析查询计划,看看索引有没有被正确使用,有没有全表扫描之类的低级错误。

我觉得监控和调优应该是一个持续的过程,而不是一次性的工作。你的业务在变化,数据量在增长,查询模式也可能改变。今天的优化方案,过几个月可能就不再适用了。定期 review 你的数据库性能,及时发现和解决问题,这才是长久之计。

常见问题与解决思路

在结束之前,我整理了几个大家经常遇到的问题和解决思路,供你参考。

| 问题现象 | 可能原因 | 解决方向 |

| 查询突然变慢 | 数据量增长、索引失效、锁竞争 | 检查索引状态、分析锁等待、优化查询语句 |

| 内存占用过高 | 缓存配置不当、内存泄漏、查询返回数据过多 | 调整缓存大小、检查应用代码、限制返回字段 |

| 写入性能下降 | 磁盘IO瓶颈、日志写入阻塞、索引过多 | 升级存储、调整日志配置、减少索引数量 |

| 连接数不够用 | 连接未释放、连接池配置不当、并发过高 | 检查连接释放逻辑、调整连接池大小、优化并发策略 |

这些问题只是一个参考,具体情况还得具体分析。遇到问题的时候不要慌,一步步排查,总能找到原因。

好了,关于AI数据库性能优化和索引设置的话题,我就聊到这里。希望这些内容对你有帮助。优化这事儿急不来,得慢慢摸索。有什么问题的话,随时可以交流。