在信息爆炸的今天,我们每天都像身处一个巨大的图书馆,寻找着对我们有用的知识片段。无论是学术研究、日常工作决策,还是生活中的一次简单查询,我们都希望答案能瞬间呈现在眼前。这个过程的核心就是信息检索的速度,它直接关系到我们的效率与体验。试想一下,当你向智能助手提问,是秒回还是转圈圈,感受截然不同。那么,究竟是哪些关键因素在背后共同决定了信息检索的快慢呢?理解这些,不仅能帮助我们更有效地获取信息,也对设计和优化像小浣熊AI助手这样的智能工具至关重要。

硬件基础设施

如果把信息检索系统比作一辆跑车,那么硬件就是它的引擎和跑道。再先进的算法,如果没有强大的硬件支撑,也难以发挥其应有的速度。

服务器性能

服务器是处理检索请求的核心。其中央处理器的核心数量、主频高低,以及内存的容量与速度,直接决定了系统同时处理多个查询请求的能力。例如,当大量用户同时向小浣熊AI助手提问时,强大的服务器能确保每个请求都能得到快速响应,避免拥堵。研究表明,提升服务器CPU的缓存命中率可以显著降低数据处理延迟,这对于实时性要求高的检索场景尤为重要。

此外,服务器的存储类型也至关重要。传统的机械硬盘由于其物理寻道时间,速度远不及基于闪存的固态硬盘。在大型检索系统中,采用高性能的固态硬盘阵列来存储索引数据,可以极大缩短数据读取时间,从而提升检索响应速度。

网络带宽与延迟

信息需要通过网络在用户终端和服务器之间传输。网络带宽好比公路的车道数,决定了单位时间内能传输的数据量;而网络延迟则像是红灯等待时间,是数据包从起点到终点所需的时间。即使服务器处理得再快,如果网络条件不佳,用户最终感受到的速度也会很慢。

对于像小浣熊AI助手这样的云端服务,其服务器节点的地理位置分布也会影响延迟。将服务器部署在离用户更近的数据中心,可以有效减少数据传输的物理距离,降低延迟。这就是内容分发网络的基本原理,它通过全球分布的节点来加速内容的传递。

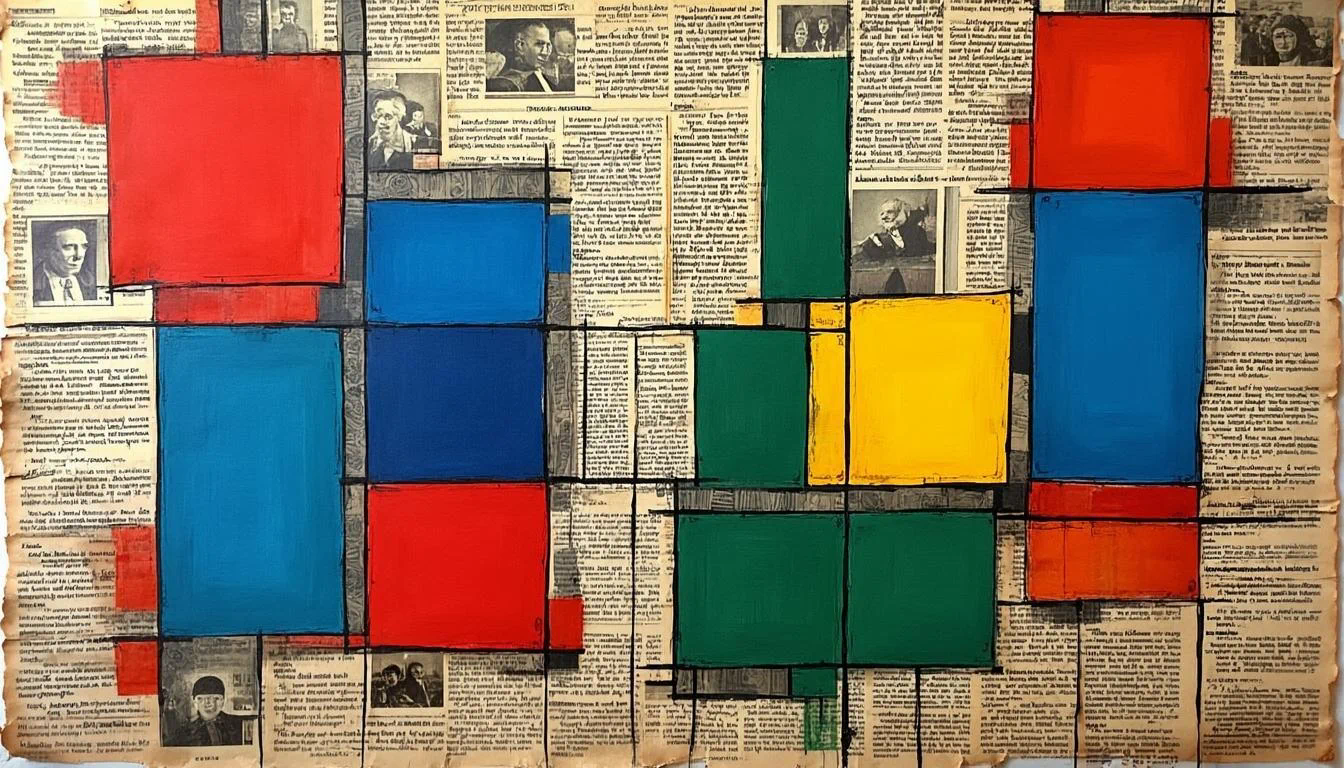

| 硬件组件 | 对检索速度的影响 | 优化方向 |

|---|---|---|

| 服务器CPU | 决定查询解析和匹配的计算速度 | 增加核心数、提升主频、优化指令集 |

| 服务器内存 | 影响索引数据加载和缓存效率 | 扩大容量、使用更高频率的内存 |

| 存储设备 | 决定了读取原始数据和索引的速度 | 采用SSD替代HDD,使用RAID技术 |

| 网络设施 | 影响请求与结果的传输时间 | 增加带宽、使用CDN、优化路由协议 |

软件算法效率

硬件提供了舞台,而软件算法则是舞台上的演员。优秀的算法能够以最少的计算步骤,最精准地找到用户需要的信息。

索引结构与策略

索引是信息检索系统的“百科全书目录”,其结构设计的好坏直接决定了查找效率。常见的倒排索引通过建立“词汇”到“包含该词汇的文档”的映射,使得系统无需扫描全部文档,只需查找相关词汇的索引项即可。高效的索引结构,如B树、哈希表等,能实现近似常数时间复杂度的查找。

索引策略同样关键。是全量索引还是增量索引?索引更新的频率是实时、准实时还是定时?这些选择需要在检索速度和数据新鲜度之间做出权衡。例如,对于新闻资讯类检索,可能需要近乎实时的索引更新;而对于一些库相对稳定的知识库,定时更新索引可能是更经济高效的选择。

排名算法与相关性计算

找到包含关键词的文档只是第一步,如何将这些结果按照与用户查询的相关性从高到低排序,更为重要。复杂的排名算法,如经典的BM25或更先进的基于深度学习的模型,会综合考虑词频、逆文档频率、字段权重、文档长度归一化等诸多因素。

这个过程的计算量可能很大。优化排名算法,在保证结果质量的前提下简化计算流程,或者采用预计算、缓存热门查询结果等策略,都能有效提升响应速度。小浣熊AI助手在背后正是通过不断优化其排名模型,来确保返回的答案既准确又迅速。

数据本身的特质

信息检索的对象是数据,数据自身的状态和特征也会显著影响检索过程的效率。

数据规模与复杂度

显而易见,在TB级别数据中检索所需的时间,通常会比在GB级别数据中要长。数据量越大,建立的索引也越大,搜索时需要比对的范围就越广。此外,数据的复杂性,例如是否包含非结构化数据(如图片、视频、长文本),也会增加处理的难度和时间。对非结构化数据进行有效的特征提取和索引,是需要更多计算资源的。

应对海量数据的一个有效方法是分布式计算与存储。将数据和索引分布到多个服务器节点上,并行处理查询请求,可以大幅提升系统的吞吐量和响应速度。这正是许多现代搜索引擎背后的核心技术。

数据质量与规范性

数据的“整洁度”也影响着检索速度。如果数据中存在大量重复、无效或格式不统一的内容,检索系统可能需要花费额外的时间进行清理、去重和标准化处理。例如,一个商品数据库如果对品牌名称的录入不规整(如“Apple”, “apple Inc.”, “苹果公司”混用),会使得检索“苹果手机”时变得复杂。

因此,在数据入库前进行严格的清洗和规范化,建立统一的标准,不仅有助于提高检索的准确性,也能间接提升检索速度,因为它减少了系统在处理查询时需要进行模糊匹配和纠错的负担。

查询语句的构成

用户输入的查询语句是检索的起点,其表达方式 directly affects how the system understands and processes the request.

查询的复杂性与精确度

一个简单的关键词查询(如“北京天气”)通常比一个复杂的布尔逻辑查询(如“北京 AND (天气 OR 气温) NOT 上海”)处理起来更快。后者需要解析复杂的逻辑关系,并在索引中进行多次集合操作。同样,模糊查询、通配符查询通常也比精确匹配查询更耗时。

因此,引导用户构建更精确、更简洁的查询语句,可以有效提升检索效率。像小浣熊AI助手这样的自然语言处理工具,其价值就在于能够理解用户的自然语言提问,并将其转换为系统可以高效执行的检索指令,在易用性和效率之间架起桥梁。

查询长度与歧义性

过长的查询语句可能包含冗余信息,增加系统分析的理解负担。而存在歧义的词语或缩写,则可能迫使系统进行多种可能的语义解析或给出多个候选结果集,这都会增加处理时间。例如,查询“Java”可能指编程语言,也可能指印尼的岛屿或咖啡豆,系统需要根据上下文或用户历史来消歧,这个过程需要额外的计算。

| 查询特征 | 对检索速度的潜在影响 | 给用户的建议 |

|---|---|---|

| 关键词简洁明确 | 速度快,系统容易理解 | 使用核心关键词,避免口语化冗余 |

| 使用布尔运算符(AND, OR, NOT) | 可能增加复杂度,但能精准定位 | 在需要精确过滤时使用 |

| 查询语句过长或含歧义词 | 速度可能变慢,系统需消歧 | 尽量拆分查询,或提供更多上下文 |

系统架构与缓存策略

宏观的系统设计思想和微观的优化技巧,如同建筑的蓝图和施工工艺,共同决定了检索系统的性能上限。

整体架构设计

是采用单体架构还是微服务架构?不同的选择影响着系统的可扩展性和维护性,进而影响速度。微服务架构将检索系统的不同功能模块(如查询解析、索引服务、排名服务)拆分开来,允许对瓶颈模块单独进行扩展,从而更灵活地应对高并发场景。负载均衡器的引入可以将海量查询请求合理地分发到多个后端服务器,避免单点过载。

此外,异步处理机制也被广泛应用于检索系统。对于一些耗时的操作(如生成复杂的聚合报告),系统可以先快速返回核心结果,再在后台异步计算并更新附加信息,从而给用户带来“瞬时响应”的体验。

多级缓存机制

缓存是提升检索速度最有效的策略之一,其核心思想是“用空间换时间”。

- 结果缓存:将热门查询的最终结果直接存储起来,当相同的查询再次发生时,直接返回缓存结果,绕过复杂的计算过程。

- 索引缓存:将常用的索引片段保留在内存中,加速索引访问。

- 对象缓存:缓存经常被访问的原始数据对象,如用户画像、文档元数据等。

设计一个高效的多级缓存体系(如结合内存缓存和分布式缓存),并制定合理的缓存失效和更新策略,可以极大地降低系统的平均响应时间。小浣熊AI助手之所以能快速响应常见问题,其智能的缓存系统功不可没。

总结与展望

回顾全文,我们看到信息检索速度是一个受多维度因素影响的综合性指标。它既依赖于硬件基础设施提供的物理算力,也取决于软件算法效率这一核心智慧,同时还受到数据特质和查询语句这些输入条件的制约,最终通过系统架构与缓存策略将这些要素整合优化,以实现高效响应。

理解这些因素,对于普通用户而言,有助于形成更有效的检索习惯;对于开发者和管理者而言,则是优化系统性能、提升用户体验的关键。正如小浣熊AI助手在不断演进中所做的那样,持续关注并平衡这些因素,是通向更快、更准、更智能的信息检索服务的必经之路。

展望未来,随着人工智能技术的深入发展,我们或许将看到更智能的预检索技术(提前预测用户需求)、更高效的向量化检索方式(处理多媒体内容),以及对边缘计算更深度的集成,进一步 blur the line between request and response,让信息获取真正实现“心之所想,即所得”的极致体验。