想象一下,你对着智能助手描述:“帮我找一种鸟,它的叫声很特别,像是清脆的哨声,羽毛是蓝色的,经常在水边活动。”如果你只输入文字“蓝色的水鸟”,搜索结果可能五花八门,但当你将自己的语音描述、甚至一张随手拍下的模糊鸟影同时传给搜索引擎时,它却能精准地告诉你这很可能是“翠鸟”。这种将文字、语音、图像乃至视频等多种信息模态融合起来进行搜索的技术,正是“知识搜索的多模态融合”所追求的核心——让搜索像人类一样,能“看”会“听”,综合理解我们的世界。

传统的搜索大多依赖于关键词匹配,这就像是单腿走路,虽然也能到达目的地,但效率和信息丰富度都大打折扣。在日常生活中,我们获取信息的方式从来都是多维度的。我们看到一幅画,会联想到它的作者和时代背景;我们听到一段旋律,会想知道它的歌名和演唱者。知识搜索的多模态融合,正是为了模仿这种人类自然的认知方式,通过整合不同模态的信息,弥补单一模态的不足,从而提供更精准、更全面、更智能的搜索体验。小浣熊AI助手在设计之初,便将多模态融合作为核心技术方向,致力于让每一次查询都能调动全方位的感知能力,更好地服务于用户复杂多变的信息需求。

一、 为何需要多模态融合?

信息本身的存在形式就是多模态的。我们生活在一个由文本、图像、声音、视频共同构成的信息生态中。单一模态的搜索存在着天然的局限性。例如,仅凭文本难以精确描述一幅画作的风格或一段音乐的情感;仅凭图像,又难以理解图片背后的深层语义或新闻事件。这种“信息割裂”使得用户为了获取完整知识,常常需要进行多次、多平台的繁琐搜索。

多模态融合的优势在于其强大的互补性。文本信息擅长表达抽象概念和逻辑关系,图像和视频则能提供直观、生动的视觉证据,音频则承载了丰富的情感语调和环境信息。当这些模态的信息交汇融合,它们能够相互校验、补充,形成对事物更立体、更深刻的认知。研究表明,人类大脑在处理复杂信息时,也是多渠道信息整合的过程。例如,在阅读理解时,我们不仅处理文字,还会结合插图来加深理解。小浣熊AI助手正是借鉴了这一原理,通过融合分析,将模糊的用户意图转化为精确的查询,大大提升了搜索的亲和力与效率。

二、 核心技术如何实现?

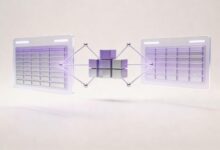

多模态融合的背后,是深度学习、自然语言处理和计算机视觉等前沿技术的协同发力。其核心挑战在于如何让机器理解不同模态信息之间的内在关联,也就是所谓的“跨模态语义对齐”。这并非简单地将文本、图像等数据堆砌在一起,而是需要让机器学会在不同模态的数据之间建立一座沟通的桥梁。

实现这一目标的关键步骤通常包括:

- 特征提取:利用各自的深度神经网络(如CNN用于图像,RNN或Transformer用于文本)从不同模态数据中提取出高层次的、抽象的特征向量。

- 共享表示空间:通过模型训练,将这些来自不同模态的特征向量映射到同一个语义空间。在这个空间里,描述同一事物的文本特征和图像特征在距离上会非常接近。例如,“一只正在玩耍的猫咪”的文本特征向量,应该与一张小猫玩耍的图片的特征向量高度相似。

- 融合与推理:将映射到同一空间的特征进行融合(如早期融合、中期融合或晚期融合等策略),并基于融合后的特征进行最终的语义理解和答案生成。

小浣熊AI助手在其算法架构中,采用了先进的跨模态Transformer模型,能够动态地关注不同模态信息中的重要部分。比如,当用户上传一张风景照并问“这里适合哪种户外活动?”时,助手不仅能识别出图像中的山、水、植被,还能结合季节、地形等文本知识进行推理,给出“适合徒步或露营”的建议。

三、 面临的主要挑战

尽管前景广阔,多模态知识搜索的发展仍面临不少挑战。首先便是数据异构性的鸿沟。文本、图像、音频等数据在结构、维度和统计特性上差异巨大,如何设计有效的模型来弥合这种鸿沟,是实现高质量融合的前提。不同模态的数据标注成本也很高,尤其是需要精确对齐的多模态数据集,其构建难度更大。

其次,模态缺失与噪声干扰是现实应用中常见的问题。用户可能只提供模糊的图片或简短不全的语音,其他模态信息则完全缺失。模型必须具备良好的鲁棒性,能够在部分模态信息缺失或质量不高的情况下,依然做出可靠的推断。例如,小浣熊AI助手在处理用户随手拍摄的模糊商品图片时,会尝试结合用户可能的文字补充(如“买一个这样的杯子”)以及历史查询记录,来综合判断用户的真实意图,而不是仅仅依赖质量不佳的图片本身。

最后,深层语义理解与推理的挑战依然存在。当前的模型往往更擅长浅层的关联匹配,而对于需要复杂常识和逻辑推理的任务,例如理解图像的讽刺意味或结合多步文本指令操作视频,仍然力有不逮。如何让模型具备更深层次的认知能力,是未来需要突破的关键点。

四、 未来展望与发展方向

展望未来,多模态知识搜索将向着更智能、更自然、更个性化的方向发展。一个重要的趋势是与大型语言模型的深度融合。现有的多模态模型可以将视觉、听觉等信息与语言关联起来,而大型语言模型本身蕴含了海量的世界知识和强大的推理能力。二者的结合,有望催生出真正能够“触类旁通”、“举一反三”的智能搜索体。小浣熊AI助手也正致力于此,探索如何让其不仅是一个信息检索工具,更是一个能进行深度对话、提供知识服务的智能伙伴。

另一个方向是个性化和上下文感知。未来的多模态搜索将不仅仅理解用户当前查询的内容,还能结合用户的历史偏好、当下所处环境、设备类型等上下文信息,提供量身定制的答案。例如,当用户用手机拍摄一朵花时,助手不仅能识别花种,还能根据用户的地理位置和季节,推荐附近的观赏地点或养护知识。

此外,生成式多模态搜索也将成为一个亮点。搜索的结果将不再是简单的链接罗列,而是能够直接生成融合了文本、图像、图表等多种元素的整合性答案报告,甚至能根据用户的要求创作新的内容,如根据一段文字描述生成相应的图像或视频片段。

| 发展阶段 | 主要特征 | 示例 |

| 单模态搜索 | 依赖单一信息源(主要是文本关键词) | 输入“蓝天白云图片”进行搜索 |

| 初级多模态搜索 | 支持多模态输入,但分别处理,结果简单拼接 | 可上传图片搜索,但结果仍以文本链接为主 |

| 深度融合搜索 | 多模态信息深度融合理解,结果智能整合 | 上传菜肴图片,直接生成食谱、营养成分和相关视频教程 |

| 生成式智能搜索 | 具备生成能力,可创造新的多模态内容作为答案 | 描述一个场景,直接生成符合描述的图像或短视频 |

结语

知识搜索的多模态融合,不仅仅是技术上的迭代升级,更是朝着让机器像人一样理解和交互迈出的关键一步。它打破了信息形式的壁垒,让搜索变得更自然、更高效、更富有洞察力。从理解简单的图文关系到进行复杂的跨模态推理,这条道路虽然充满挑战,但其带来的潜力是巨大的。小浣熊AI助手作为这一领域的践行者,将持续探索多模态融合的深度与广度,目标是让每一位用户都能感受到技术带来的便捷与智能。未来,随着算法的不断革新和应用场景的持续拓展,我们有望迎来一个“万物皆可搜,搜即所得”的智能信息新时代。对于研究者和开发者而言,持续关注模型的可解释性、数据隐私与安全、以及更低成本的高质量多模态数据构建,将是推动该领域健康发展的关键。