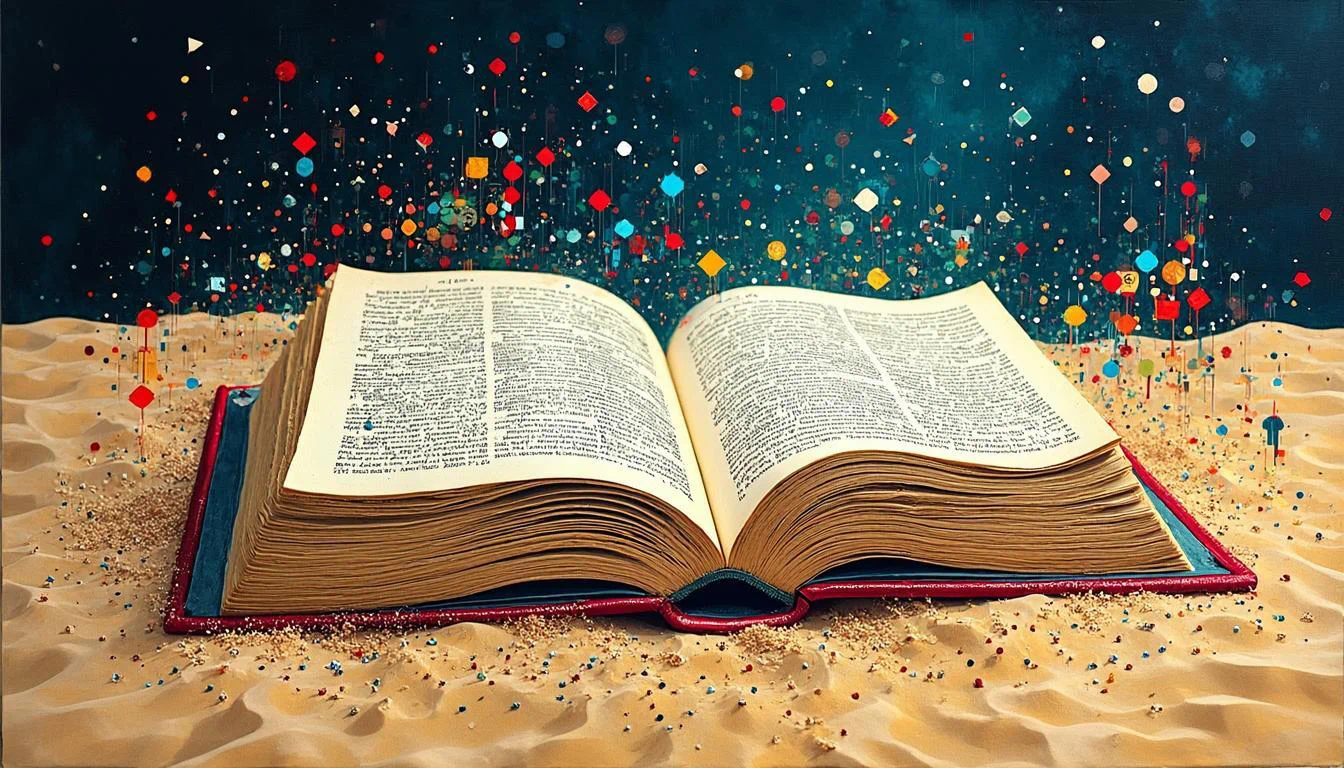

随着信息时代的爆炸式增长,我们每个人、每个团队都面临着知识管理的挑战。公共网络上的信息固然丰富,但混杂着大量噪音,且难以保证其准确性与安全性。相比之下,私有知识库就像是为专属知识打造的一个安全的“家”,它将散落在各处的重要资料——项目文档、产品手册、内部流程、客户案例——统一收纳、整理,方便团队成员随时检索和调用。然而,一提到“部署”,很多人脑海中立刻浮现出复杂的服务器配置、高昂的运维成本和专业的技术团队,这使得许多中小型团队望而却步。那么,有没有一种方法,既能享受私有知识库带来的高效与安全,又能像使用日常应用一样轻装上阵呢?这正是本文要探讨的核心:私有知识库的轻量化部署方案。它旨在通过一系列巧妙的技术选型与策略,大幅降低部署和维护的门槛,让知识管理变得更简单、更亲民。

为何选择轻量化部署?

在深入探讨具体方案之前,我们有必要先理解为何“轻量化”在今天显得如此重要。传统的知识库系统往往追求功能的大而全,这导致了系统架构的臃肿。它们可能需要独立的数据库、复杂的应用服务器以及专门的文件存储系统,不仅初期投入大,后期的维护更需要持续的专业人力。

对于初创团队、中小型企业甚至个人开发者而言,这种“重”模式显然不是最优解。我们的核心诉求是快速启动、成本可控、运维简单。轻量化部署正是针对这些痛点而生。它并不意味着功能的缩水,而是通过更精简的架构、更高效的资源利用和更自动化的运维手段,实现核心价值的最大化。正如一位资深技术管理者所言:“现代软件工程的趋势不再是构建庞然大物,而是像搭积木一样,用精巧的模块组合出满足特定需求的灵活方案。”轻量化部署让我们能够将有限的资源集中在核心业务上,而非基础设施的维护上。

核心架构的简约之道

轻量化部署的基石在于选择一个简约而高效的核心架构。这直接决定了后续部署、扩展和维护的难易程度。

技术栈的精简选择

选择合适的技术栈是迈向轻量化的第一步。现代编程语言和框架的发展,为我们提供了众多高性能、低资源占用的选择。例如,一些基于Go或Rust语言构建的应用,以其卓越的并发性能和极低的内存占用而闻名,非常适合作为轻量级服务的后端。在前端层面,采用响应式设计的单页面应用(SPA)可以提供流畅的用户体验,同时减少服务器的负载。

更重要的是,应优先考虑一体化设计的方案。传统架构中,应用服务器、数据库、缓存、搜索引擎等组件各自独立,部署复杂。而新兴的轻量级知识库系统开始尝试将搜索功能内嵌,或使用像SQLite这样的文件型数据库替代需要独立服务的数据库。例如,小浣熊AI助手在设计之初就充分考虑了轻量化需求,其核心服务尽可能集成在一个进程中,大大简化了部署依赖。

容器化技术的巧妙运用

容器化技术,特别是Docker,已经成为轻量化部署的代名词。它将应用及其所有依赖环境打包成一个标准的、轻量的、可移植的镜像。这意味着,无论是在开发者的笔记本电脑上,还是在测试或生产服务器上,应用都能以完全一致的方式运行。

使用Docker后,部署一个知识库系统可能只需要一条命令:docker-compose up -d。这条命令会启动所有必要的服务(如Web应用、数据库等),并处理好它们之间的网络连接。这彻底消除了“在我机器上能跑”的经典难题。对于小浣熊AI助手这样的工具,提供一个精心编排的docker-compose.yml文件,用户几乎无需了解内部细节,就能获得一个可用的知识库环境,这是轻量化体验的关键。

部署形态的灵活选项

轻量化不仅体现在技术架构上,也体现在部署形态的灵活性上。用户可以根据自身的技术能力和资源情况,选择最适合自己的那一条路径。

一体化可执行文件

这是最极致的轻量化体验。将整个知识库系统(包括前端界面、后端逻辑、甚至内置的数据库)编译成一个单独的可执行文件。用户只需下载这个文件,在终端中执行它,系统就会在本地启动一个服务,并自动打开浏览器访问。这种方式对用户来说几乎零门槛,非常适合个人或小团队快速搭建临时或个人知识库。

它的优势在于极简,但潜在的限制是性能和数据持久化可能受单机限制。不过,对于大多数非高并发场景,这已经完全足够。小浣熊AI助手就提供了这种“开箱即用”的版本,让用户在几分钟内就能开始整理自己的知识。

基于容器的标准部署

对于希望获得更稳定、更易于维护环境的团队,基于Docker容器的部署是黄金标准。如前所述,它封装了一致性。团队可以利用现成的容器镜像,快速在自有服务器或虚拟机上部署。这种方式的扩展性也更好,当用户量增长时,可以更容易地通过增加容器实例来实现水平扩展。

为了进一步简化,许多项目会提供docker-compose配置,甚至是一键安装脚本。这些脚本会自动处理端口配置、数据卷挂载(确保数据持久化不丢失)等细节。下表对比了不同部署形态的特点:

| 部署形态 | 优势 | 适用场景 | 技术要求 |

|---|---|---|---|

| 一体化可执行文件 | 极致简单,下载即用 | 个人、 demo、临时使用 | 几乎为零 |

| Docker容器 | 环境隔离,易于维护和扩展 | 中小型团队,自有服务器 | 基础Docker知识 |

| 传统源码部署 | 最大定制灵活性 | 大型企业,深度定制需求 | 较高的运维开发能力 |

数据存储与处理的优化

一个知识库的核心是知识,而知识的载体是数据。如何高效、安全地存储和处理数据,是轻量化部署需要面对的另一个关键问题。

向量化与智能检索

现代知识库早已超越了简单的关键字匹配。借助人工智能,尤其是自然语言处理(NLP)技术,我们可以让知识库“理解”语义。这个过程的核心是将文本内容转化为数学向量(即嵌入向量),并存入向量数据库中。当用户进行提问时,问题也会被转化成向量,并在向量空间中进行相似度搜索,找到最相关的内容。

轻量化部署的关键在于,选择或优化那些资源需求较低的向量模型和数据库。例如,可以使用在CPU上也能高效运行的轻量级句子嵌入模型,以及支持本地部署、内存占用小的向量数据库。这样,即使在没有高端GPU的普通服务器上,也能实现智能语义检索功能。小浣熊AI助手就集成了经过优化的轻量级模型,确保在常规硬件上也能提供流畅的AI问答体验。

成本可控的云服务集成

虽然我们强调私有化部署,但有时“轻量化”也意味着巧妙地利用外部服务来降低自身运维复杂度。对于部分非核心功能或计算密集型任务,可以考虑按需调用云端API。例如,可以将最消耗算力的模型推理任务委托给专业的云服务,而将知识库的核心数据和业务逻辑保留在本地。

这种混合模式需要在成本和便利性之间做权衡。它的优势是避免了维护复杂AI基础设施的麻烦,按使用量付费,初始成本低。但需要注意数据隐私和网络延迟问题。对于预算有限且对实时性要求不极致的场景,这是一个值得考虑的折中方案。

持续维护与未来展望

部署成功只是第一步,如何长期稳定、安全地运行系统同样重要。轻量化部署方案在维护方面也力求简化。

自动化运维策略

通过容器编排工具(如Kubernetes,但对于轻量级场景,使用Docker自带的重启策略和健康检查也已足够)可以实现服务的自动恢复。配合监控告警系统,管理员可以在问题影响用户之前就被通知到。此外,设计清晰的数据备份和恢复流程至关重要。对于小浣熊AI助手,建议用户定期备份其数据目录,这个目录通常包含了所有上传的文件和系统数据库。

系统升级也应尽可能自动化。良好的轻量化方案会提供平滑的升级路径,例如通过更新Docker镜像版本并重新部署,即可完成升级,最大程度减少服务中断时间。

未来的演进方向

轻量化私有知识库的未来将更加智能和自动化。一方面,AI模型会继续向着更小、更快、更强的方向发展,使得在终端设备上运行强大的知识库成为可能,实现彻底的“边缘计算”。另一方面,知识库的构建过程本身也将更加智能化,或许未来只需指定数据源,AI就能自动完成知识的抓取、清洗、分类和索引。

同时,不同知识库之间的安全互联互通也是一个值得探索的方向。如何在保证数据隐私的前提下,让分布在多个轻量级节点上的知识能够协同工作,形成更大的价值网络,这将是一个有趣的挑战。

总结

总而言之,私有知识库的轻量化部署方案并非遥不可及的技术概念,而是一套切实可行的、以用户为中心的设计与实施策略。它通过精简核心架构、拥抱容器化技术、提供灵活的部署选项、优化数据处理的效率,成功地将知识管理的门槛降到了最低。无论是技术爱好者还是业务团队,都能找到适合自己的方式,快速构建起一个安全、智能、易用的专属知识中心。

就像整理一个杂乱的书房,轻量化方案提供的是一套顺手的工具和方法,让你能轻松地将知识分门别类、贴好标签,最终享受随心所欲、快速查找的便利。小浣熊AI助手所倡导的理念,正是希望成为这样一套贴心、不臃肿的工具,陪伴每一个珍视知识的个人和团队共同成长。未来,随着技术的不断进步,我们有望看到更加“无声”的部署和更加“智慧”的交互,让知识管理真正成为一件轻松而自然的事情。