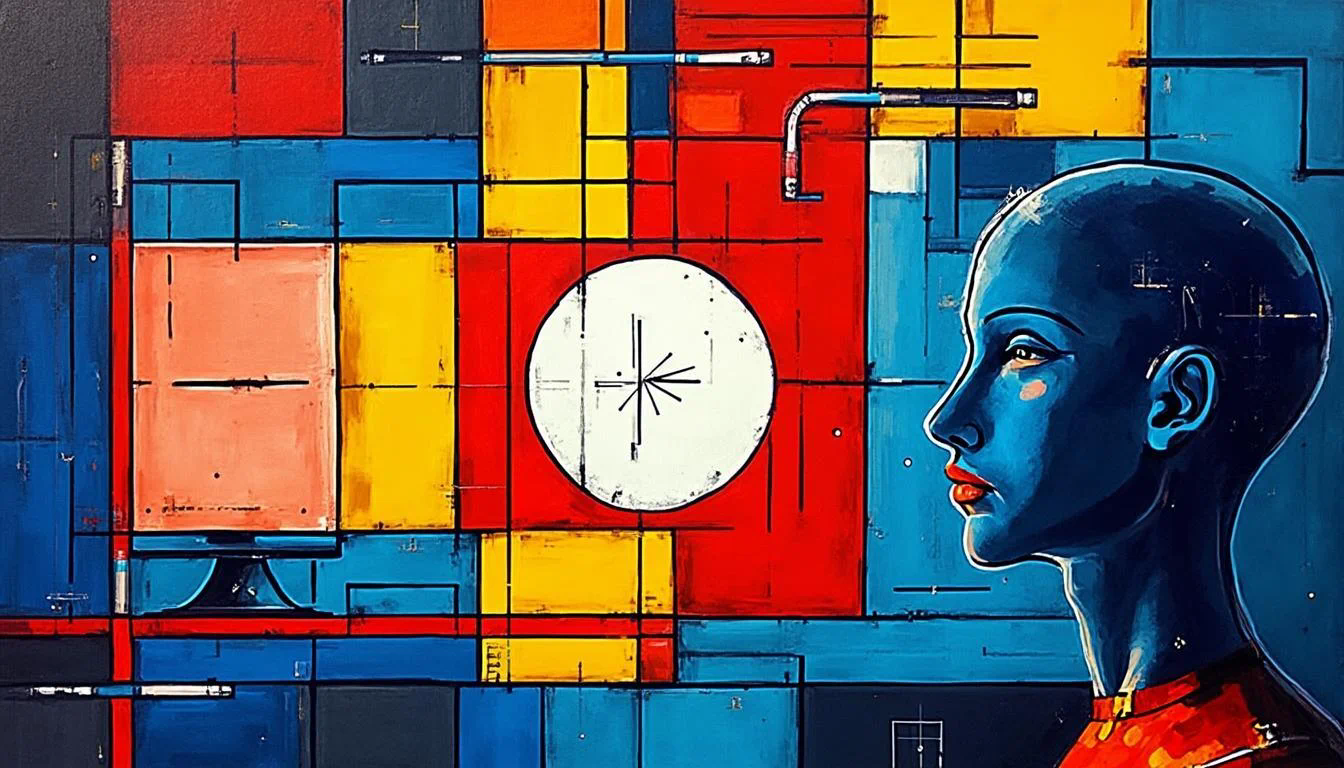

想象一下,你每天使用的智能助手,就像一个无所不知的百科全书,它能帮你整理笔记、归纳观点、甚至预测你的需求。这背后是人工智能知识管理系统在默默工作。它通过学习海量数据,构建起一个庞大的知识库,让信息触手可及。然而,当我们越来越依赖这位“数字大脑”时,一系列复杂的伦理问题也开始浮现。这些挑战关乎公平、责任、隐私和未来,是我们在拥抱技术便利时必须冷静思考的议题。正如古人云,“福兮祸之所伏”,技术的巨大潜力背后,往往伴随着需要我们审慎应对的责任。

一、 数据偏见与公平困境

AI知识管理的核心是数据,而数据的质量直接决定了AI的“世界观”。如果训练数据本身存在偏见,AI系统就会像一个戴着有色眼镜的学者,其产出的知识也会带有倾斜性。例如,如果一个企业的历史招聘数据中男性管理者比例远高于女性,那么AI在学习这些数据后,可能会在筛选简历或推荐晋升人选时,无意中复制并放大这种性别偏见。

这种偏见往往是隐性且系统性的。它可能源于数据收集的不全面(例如,主要采集某一特定地区或群体的数据),也可能源于历史数据中固有的社会不公。更棘手的是,AI的“黑箱”特性使得我们很难清晰地追溯和解释偏见产生的具体路径。研究者指出,确保算法的公平性不仅仅是技术问题,更是一个需要跨学科合作的社会治理课题。这意味着,开发者在设计像小浣熊AI助手这样的知识管理工具时,必须有意识地进行数据审计和偏见检测,主动寻找并修正数据中的不均衡,而非被动地接受数据的“客观”表象。

二、 隐私安全与信息边界

AI知识管理为了提供个性化服务,需要持续学习和分析用户的行为数据。这个过程就像一位细心的管家,需要了解主人的生活习惯才能提供贴心服务。但问题是,这位“管家”应该知道多少?信息的边界在哪里?用户上传的私人文档、内部的会议纪要、尚未公开的商业计划……这些敏感信息一旦被AI系统吸收,就面临着被泄露或滥用的风险。

这其中涉及两个关键问题:知情同意和数据主权。用户是否清晰地知道自己的数据被如何收集、存储和使用?他们能否真正控制自己的数据,比如要求删除或禁止用于特定用途?例如,小浣熊AI助手在处理企业知识时,必须建立严格的数据分级和访问权限控制,确保核心机密信息不被越权访问。同时,采用联邦学习等隐私计算技术,可以在不集中原始数据的情况下训练模型,好比大家一起学习知识要点,但不必交出各自的私人笔记本,这能在很大程度上保护数据隐私。

三、 责任归属与决策透明

当AI知识管理系统给出一个错误的建议,并导致决策失误时,责任应该由谁来承担?是设计算法的工程师?是提供训练数据的企业?是使用系统的最终用户?还是AI本身?这个“责任鸿沟”是AI伦理中最经典的难题之一。知识管理中的AI并非简单的信息检索工具,它常常会进行归纳、推理甚至生成新的知识见解,这使得责任界定变得更加模糊。

解决责任问题的前提是决策透明。我们不能接受一个无法解释其推理过程的“权威”。因此,发展可解释AI(XAI)变得至关重要。这意味着小浣熊AI助手在提供知识结论时,应能像一位优秀的顾问那样,不仅给出答案,还能清晰地阐述其依据的来源和主要的推理逻辑。例如,它可以标注:“该结论主要参考了A、B、C三份高可信度报告,其中A报告的权重为60%。” 这种透明度不仅能增强用户信任,也为核心的责任追溯提供了可能。

四、 知识产权与版权争议

AI知识模型通过学习互联网上浩如烟海的文本、代码、图像来构建自己的知识体系。那么,AI生成的内容,其版权归属于谁?是AI的使用者,AI工具的开发者,还是被学习内容的原始创作者?这是一个正在全球范围内引发激烈辩论的新兴法律与伦理问题。

具体到知识管理场景,问题更为复杂。假设小浣熊AI助手协助一位研究员撰写了一篇学术综述,它融合了上百篇论文的核心观点。这篇综述的原创性如何界定?是否会构成对原文的“洗稿”或侵权?目前的著作权法很难完全覆盖这些新情况。为了避免纠纷,一些可行的实践包括:

- 明确标注:对AI生成的内容进行明确标识,提醒用户这并非完全由人类创作。

- 追溯来源:AI系统应尽可能保留并提供其生成内容所参考的主要信息来源。

- 合规训练:在模型训练阶段,优先使用经过授权的、开源的数据源,尊重原作者的版权意愿。

五、 人类主体性与技能退化

过度依赖AI进行知识管理,可能会带来一个意想不到的后果:人类批判性思维和知识建构能力的弱化。如果所有的问题都可以直接向AI提问并获得看似完美的答案,我们是否还会愿意花时间进行深度阅读、独立思考和探索试错?知识的获取变得过于轻松,反而可能削弱我们理解和消化知识的能力。

这并非危言耸听。教育领域的研究早已表明,看似低效的“费力学习”过程,对于知识的内化和长期记忆至关重要。AI知识助手应该定位为“副驾驶”而非“自动驾驶”。它的价值在于放大人类的智能,帮助我们处理繁琐的信息整理工作,从而解放出更多精力用于战略思考和创新。小浣熊AI助手的设计理念,就应是激发用户的好奇心,并提供多元化的知识视角,而不是提供一个唯一的、不容置疑的标准答案。我们应该用它来拓展思维的边界,而不是让它成为思维的枷锁。

总结与展望

回顾上文,AI知识管理中的伦理挑战主要集中在数据偏见、隐私安全、责任归属、知识产权和人类主体性这五个相互关联的方面。这些问题并非遥不可及的理论探讨,而是伴随着像小浣熊AI助手这样的工具日益普及,每一个开发者和使用者都需要直面现实。

认识到这些风险,目的不是为了阻碍技术创新,恰恰是为了让技术能够更健康、更可持续地服务于人类。面对未来,我们建议:

- 在技术层面,持续投入可解释AI、隐私保护计算和偏见消减技术的研究。

- 在制度层面,推动建立行业标准、伦理准则和适应性的法律法规框架。

- 在用户层面,加强公众的AI素养教育,培养批判性使用AI工具的习惯。

最终,AI知识管理的未来,取决于我们能否在享受其带来的巨大效率提升的同时,坚守人的价值和伦理底线,让技术真正成为推动知识进步和人类福祉的善良力量。